1.環境部署 | 安裝軟體 | 主機名 |IP地址|記憶體需求| | | | | | | Elasticsearch | mes |192.168.13.142|至少3G| |Logstash|log|192.168.13.143|至少2G| |head,Kibana|head kib|192.168 ...

1.環境部署

| 安裝軟體 | 主機名 | IP地址 | 記憶體需求 |

|---|---|---|---|

| Elasticsearch | mes | 192.168.13.142 | 至少3G |

| Logstash | log | 192.168.13.143 | 至少2G |

| head,Kibana | head-kib | 192.168.13.139 | 至少2G |

地址與版本

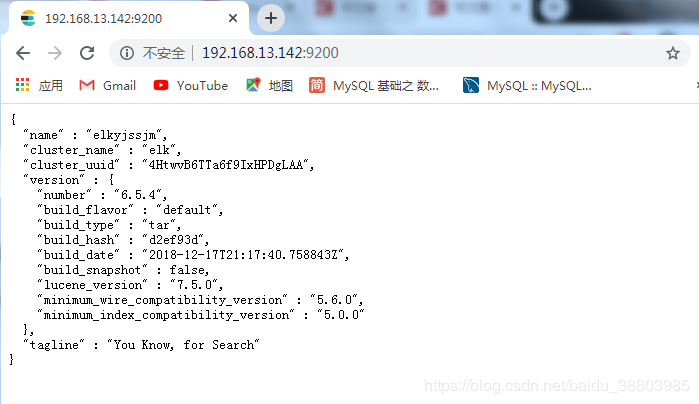

Elasticsearch: 6.5.4 #https://artifacts.elastic.co/downloads/elasticsearch/elasticsearch-6.5.4.tar.gz

Logstash: 6.5.4 #https://artifacts.elastic.co/downloads/logstash/logstash-6.5.4.tar.gz

Kibana: 6.5.4 #https://artifacts.elastic.co/downloads/kibana/kibana-6.5.4-linux-x86_64.tar.gz

Kafka: 2.11-2.1 #https://archive.apache.org/dist/kafka/2.1.0/kafka_2.11-2.1.0.tgz

Filebeat: 6.5.4

相應的版本最好下載對應的插件

相關地址:

官網地址

2.Elasticsearch部署

系統類型:Centos7.5

節點IP:172.16.13.142

軟體版本:jdk-8u211-linux-x64.tar.gz、elasticsearch-6.5.4.tar.gz

1.安裝配置jdk

[root@mes ~]# tar xzf jdk-8u211-linux-x64.tar.gz -C /usr/local/ #解壓

[root@mes ~]# cd /usr/local/

[root@mes local]# mv jdk1.8.0_211/ java

[root@mes local]# echo '

JAVA_HOME=/usr/local/java

PATH=$JAVA_HOME/bin:$PATH

export JAVA_HOME PATH

' >>/etc/profile

[root@mes local]# source /etc/profile

[root@mes local]# java -version #出現版本號就代表jdk配置成功

java version "1.8.0_211"

Java(TM) SE Runtime Environment (build 1.8.0_211-b12)

Java HotSpot(TM) 64-Bit Server VM (build 25.211-b12, mixed mode)

2.安裝配置ES

[root@mes ~]# useradd elsearch #創建運行用戶

[root@mes ~]# echo "123456" | passwd --stdin "elsearch" #設置密碼

[root@mes ~]# tar xzf elasticsearch-6.5.4.tar.gz -C /usr/local/

[root@mes ~]# cd /usr/local/elasticsearch-6.5.4/config/

[root@mes config]# cp elasticsearch.yml elasticsearch.yml.bak #備份

[root@mes config]# vim elasticsearch.yml

# 在最後一行添加如下內容

cluster.name: elk

node.name: elkyjssjm

node.master: true

node.data: true

path.data: /data/elasticsearch/data

path.logs: /data/elasticsearch/logs

bootstrap.memory_lock: false

bootstrap.system_call_filter: false

network.host: 0.0.0.0

http.port: 9200

http.cors.enabled: true

http.cors.allow-origin: "*"

#discovery.zen.ping.unicast.hosts: ["192.168.246.234", "192.168.246.231","192.168.246.235"]

#discovery.zen.minimum_master_nodes: 2

#discovery.zen.ping_timeout: 150s

#discovery.zen.fd.ping_retries: 10

#client.transport.ping_timeout: 60s

參數詳解

cluster.name 集群名稱,各節點配成相同的集群名稱。

node.name 節點名稱,各節點配置不同。

node.master 指示某個節點是否符合成為主節點的條件。

node.data 指示節點是否為數據節點。數據節點包含並管理索引的一部分。

path.data 數據存儲目錄。

path.logs 日誌存儲目錄。

bootstrap.memory_lock 記憶體鎖定,是否禁用交換。

bootstrap.system_call_filter 系統調用過濾器。

network.host 綁定節點IP。

http.port 埠。

discovery.zen.ping.unicast.hosts 提供其他 Elasticsearch 服務節點的單點廣播發現功能。

discovery.zen.minimum_master_nodes 集群中可工作的具有Master節點資格的最小數量,官方的推薦值是(N/2)+1,其中N是具有master資格的節點的數量。

discovery.zen.ping_timeout 節點在發現過程中的等待時間。

discovery.zen.fd.ping_retries 節點發現重試次數。

http.cors.enabled 是否允許跨源 REST 請求,表示支持所有功能變數名稱,用於允許head插件訪問ES。

http.cors.allow-origin 允許的源地址。

設置JVM堆大小,一般設置為記憶體的一半,但最少2G

[root@mes ~]# sed -i 's/-Xms1g/-Xms2g/' /usr/local/elasticsearch-6.5.4/config/jvm.options

[root@mes ~]# sed -i 's/-Xmx1g/-Xmx2g/' /usr/local/elasticsearch-6.5.4/config/jvm.options

創建ES數據及日誌存儲目錄並修改屬主和屬組,與上面配置文件中的路徑一一對應

[root@mes ~]# mkdir -p /data/elasticsearch/data

[root@mes ~]# mkdir -p /data/elasticsearch/logs

[root@mes ~]# chown -R elsearch:elsearch /data/elasticsearch #給剛剛創建的目錄修改屬主和屬組

[root@mes ~]# chown -R elsearch:elsearch /usr/local/elasticsearch-6.5.4

系統優化:

1.增加最大進程數

[root@mes ~]# vim /etc/security/limits.conf

#在文件最後面添加如下內容

* soft nofile 65536

* hard nofile 131072

* soft nproc 2048

* hard nproc 4096

================================================================

解釋:

soft xxx : 代表警告的設定,可以超過這個設定值,但是超過後會有警告。

hard xxx : 代表嚴格的設定,不允許超過這個設定的值。

nofile : 是每個進程可以打開的文件數的限制

nproc : 是操作系統級別對每個用戶創建的進程數的限制

================================================================

2.增加最大記憶體映射數

[root@mes ~]# vim /etc/sysctl.conf

#添加如下

vm.max_map_count=262144 #elasticsearch用戶擁有的記憶體許可權太小,至少需要262144;

vm.swappiness=0 #表示最大限度使用物理記憶體,在記憶體不足的情況下,然後才是swap空間

[root@mes ~]# su - elsearch

Last login: Sat Aug 3 19:48:59 CST 2019 on pts/0

[root@mes ~]$ cd /usr/local/elasticsearch-6.5.4/

[root@mes elasticsearch-6.5.4]$ ./bin/elasticsearch #先啟動看看報錯不,需要多等一會

終止之後(等cpu降下來再終止)

[root@mes elasticsearch-6.5.4]$ nohup ./bin/elasticsearch & #放後臺啟動

[1] 11462

nohup: ignoring input and appending output to ‘nohup.out’

[root@mes elasticsearch-6.5.4]$ tail -f nohup.out #看一下是否啟動

或者:

su - elsearch -c "cd /usr/local/elasticsearch-6.5.4 && nohup bin/elasticsearch &"

測試:訪問http://192.168.13.142:9200/ 記得加埠9200

3.head,Kibana安裝配置

系統類型:Centos7.5

節點IP:172.16.13.139

軟體版本:node-v4.4.7-linux-x64.tar.gz、elasticsearch-head-master.zip、phantomjs-2.1.1-linux-x86_64.tar.bz2、kibana-6.5.4-linux-x86_64.tar.gz

1.head及其插件的安裝配置

1.安裝node

[root@head-kib ~]# wget https://npm.taobao.org/mirrors/node/latest-v4.x/node-v4.4.7-linux-x64.tar.gz

[root@head-kib ~]# tar -zxf node-v4.4.7-linux-x64.tar.gz –C /usr/local

[root@head-kib ~]# vim /etc/profile

#在最後添加如下變數

NODE_HOME=/usr/local/node-v4.4.7-linux-x64

PATH=$NODE_HOME/bin:$PATH

export NODE_HOME PATH

[root@head-kib ~]# source /etc/profile

[root@head-kib ~]# node --version #檢查node版本號

v4.4.7

2.下載head插件grunt

[root@head-kib ~]# wget https://github.com/mobz/elasticsearch-head/archive/master.zip

[root@head-kib ~]# cp elasticsearch-head-master.zip /usr/local/

[root@head-kib ~]# yum -y install unzip

[root@head-kib local]# cd /usr/local

[root@head-kib local]# unzip elasticsearch-head-master.zip

[root@head-kib local]# cd elasticsearch-head-master/

[root@head-kib elasticsearch-head-master]# npm config set registry https://registry.npm.taobao.org #改源地址,要不然下麵的安裝時間會特別長

[root@head-kib elasticsearch-head-master]# npm install -g grunt-cli #安裝grunt

[root@head-kib elasticsearch-head-master]# grunt --version #檢查grunt版本號

grunt-cli v1.3.2

[root@head-kib elasticsearch-head-master]# vim /usr/local/elasticsearch-head-master/Gruntfile.js

#在95行左右

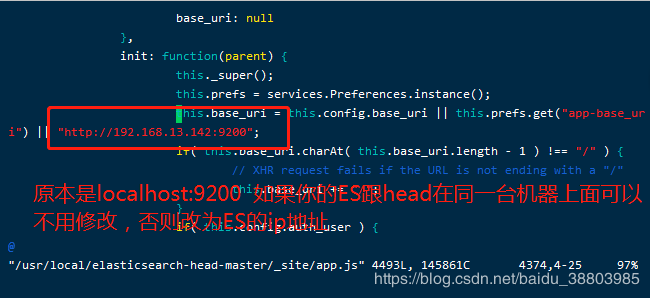

[root@head-kib elasticsearch-head-master]# vim /usr/local/elasticsearch-head-master/_site/app.js

#在4374行左右

3.下載head必要的文件

[root@head-kib ~]# wget https://github.com/Medium/phantomjs/releases/download/v2.1.1/phantomjs-2.1.1-linux-x86_64.tar.bz2

[root@head-kib ~]# yum -y install bzip2

[root@head-kib ~]# tar -jxf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /tmp/ #解壓

4.運行head

[root@head-kib ~]# cd /usr/local/elasticsearch-head-master/

[root@head-kib elasticsearch-head-master]# npm config set registry https://registry.npm.taobao.org

[root@head-kib elasticsearch-head-master]# npm install

...

[email protected] node_modules/grunt-contrib-jasmine

├── [email protected]

├── [email protected]

├── [email protected]

├── [email protected] ([email protected], [email protected], [email protected], [email protected], [email protected])

├── [email protected]

├── [email protected] ([email protected])

└── [email protected] ([email protected], [email protected], [email protected], phan

[root@head-kib elasticsearch-head-master]# nohup grunt server &

[root@head-kib elasticsearch-head-master]# tail -f nohup.out

Running "connect:server" (connect) task

Waiting forever...

Started connect web server on http://localhost:9100

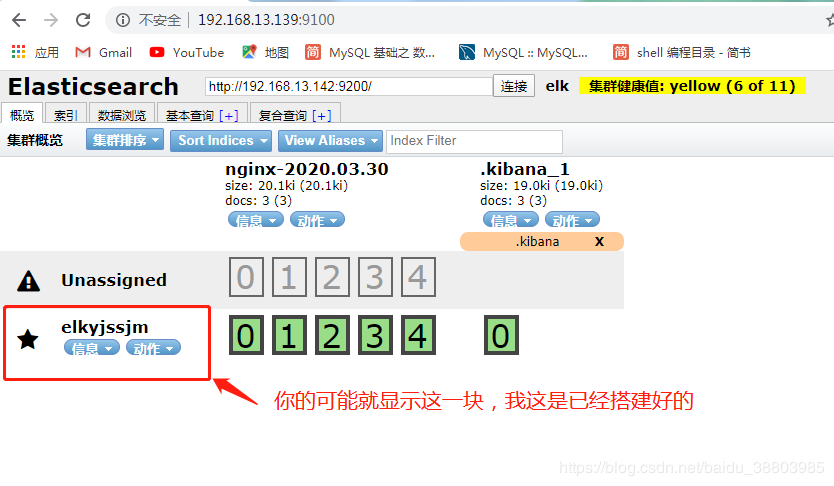

測試:訪問http://192.168.13.139:9100/

2.Kibana部署

1.安裝和配置

[root@head-kib ~]# tar zvxf kibana-6.5.4-linux-x86_64.tar.gz -C /usr/local/

[root@head-kib ~]# cd /usr/local/kibana-6.5.4-linux-x86_64/config/

[root@head-kib config]# vim kibana.yml

#在末尾添加以下內容

server.port: 5601

server.host: "192.168.13.139" #本機

elasticsearch.url: "http://192.168.13.142:9200" #ES節點

kibana.index: ".kibana"

====================================================================================

server.port kibana 服務埠,預設5601

server.host kibana 主機IP地址,預設localhost

elasticsearch.url 用來做查詢的ES節點的URL,預設http://localhost:9200

kibana.index kibana在Elasticsearch中使用索引來存儲保存的searches, visualizations和dashboards,預設.kibana

=====================================================================================

2.啟動

[root@head-kib config]# cd ..

[root@head-kib kibana-6.5.4-linux-x86_64]# nohup ./bin/kibana &

[1] 12054

[root@head-kib kibana-6.5.4-linux-x86_64]# nohup: ignoring input and appending output to ‘nohup.out’

我們可以用nginx進行反向代理,不至於顯示出我們真正的IP和埠號

我是在這一臺上面部署了nginx,在任意一臺部署都可以

[root@head-kib ~]# rpm -ivh http://nginx.org/packages/centos/7/noarch/RPMS/nginx-release-centos-7-0.el7.ngx.noarch.rpm #下載源

[root@head-kib ~]# yum -y install nginx #安裝

[root@head-kib ~]# cd /etc/nginx/conf.d/

[root@head-kib conf.d]# cp default.conf default.conf.bak #備份

[root@head-kib conf.d]# vim default.conf

#清空並添加以下內容

server {

listen 80;

server_name 192.168.13.139; #你的nginx所在的機器

#charset koi8-r;

# access_log /var/log/nginx/host.access.log main;

# access_log off;

location / {

proxy_pass http://192.168.13.139:5601; #kibana所在的機器

proxy_set_header Host $host:5601;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header Via "nginx";

}

location /status {

stub_status on; #開啟網站監控狀態

access_log /var/log/nginx/kibana_status.log; #監控日誌

auth_basic "NginxStatus"; }

location /head/{

proxy_pass http://192.168.246.13.139:9100; #head所在的機器

proxy_set_header Host $host:9100;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header Via "nginx";

}

}

root@head-kib ~]# systemctl start nginx #啟動nginx

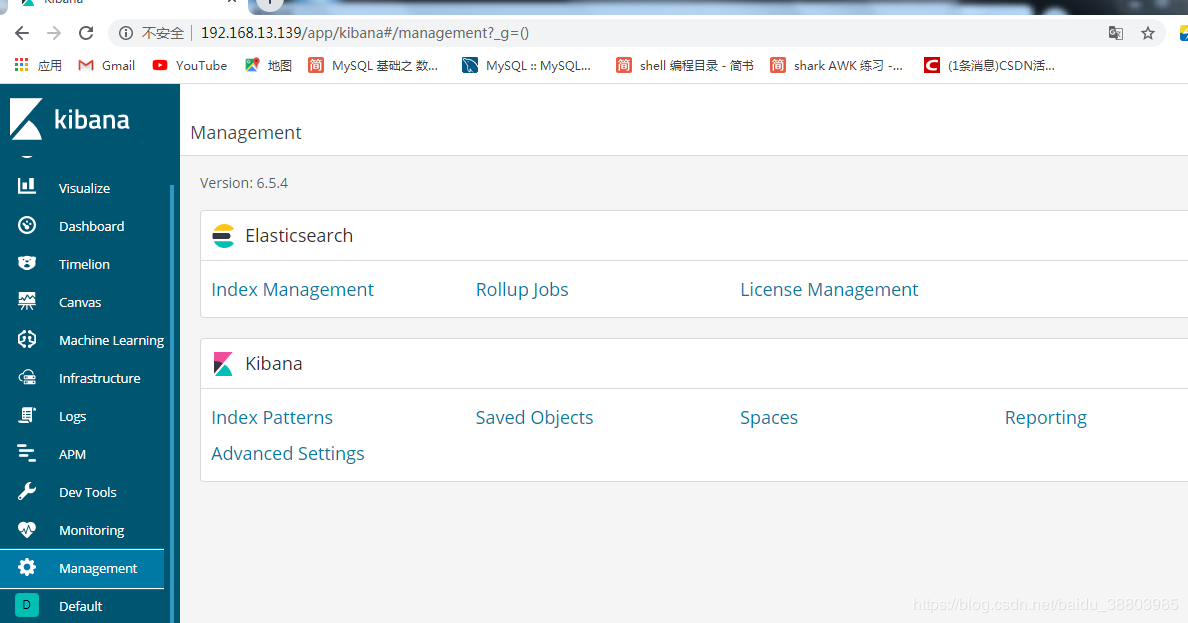

測試:訪問 http://192.168.13.139/

剛開始沒數據,會提示你創建新的數據

4.Logstash部署

系統類型:Centos7.5

節點IP:192.168.13.143

軟體版本:jdk-8u121-linux-x64.tar.gz、logstash-6.5.4.tar.gz

Logstash運行同樣依賴jdk,本次為節省資源,故將Logstash安裝在了kafka244.231節點。

你想收集哪台機器上的信息就將Logstash安裝到哪臺上。

1.安裝配置jdk

[root@log ~]# tar xzf jdk-8u211-linux-x64.tar.gz -C /usr/local/ #解壓

[root@log ~]# cd /usr/local/

[root@log local]# mv jdk1.8.0_211/ java

[root@log local]# echo '

JAVA_HOME=/usr/local/java

PATH=$JAVA_HOME/bin:$PATH

export JAVA_HOME PATH

' >>/etc/profile

[root@log local]# source /etc/profile

[root@log local]# java -version #出現版本號就代表jdk配置成功

java version "1.8.0_211"

Java(TM) SE Runtime Environment (build 1.8.0_211-b12)

Java HotSpot(TM) 64-Bit Server VM (build 25.211-b12, mixed mode)

2.安裝配置Logstash

[root@log ~]# tar xvzf logstash-6.5.4.tar.gz -C /usr/local/ #安裝

創建目錄,將輸入輸出都放在該目錄裡面

[root@log ~]# mkdir -p /usr/local/logstash-6.5.4/etc/conf.d

[root@log ~]# cd /usr/local/logstash-6.5.4/etc/conf.d/

[root@log conf.d]# vim input.conf

#在下麵添加

input{ #讓logstash可以讀取特定的事件源。

file{ #從文件讀取

path => ["/var/log/nginx/access_json.log"] #要輸入的文件路徑

# code => "json" #定義編碼,用什麼格式輸入和輸出,由於日誌就是json格式,這裡不用再寫

type => "nginx" #定義一個類型,通用選項. 用於激活過濾器

}

}

output{ #輸出插件,將事件發送到特定目標

elasticsearch { #輸出到es

hosts => ["192.168.13.142:9200"] #指定es服務的ip加埠

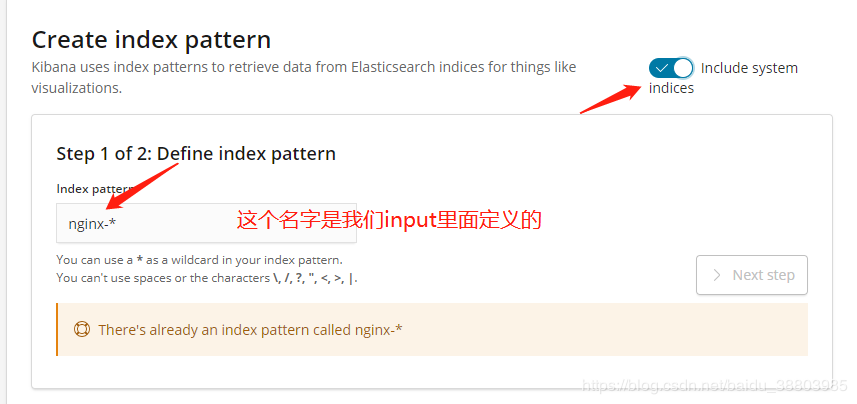

index => ["%{type}-%{+YYYY.MM.dd}"] #引用input中的type名稱,定義輸出的格式

}

}

我們這裡以nginx的日誌為例

[root@log ~]# cd

[root@log ~]# rpm -ivh http://nginx.org/packages/centos/7/noarch/RPMS/nginx-release-centos-7-0.el7.ngx.noarch.rpm

[root@log ~]# yum install -y nginx

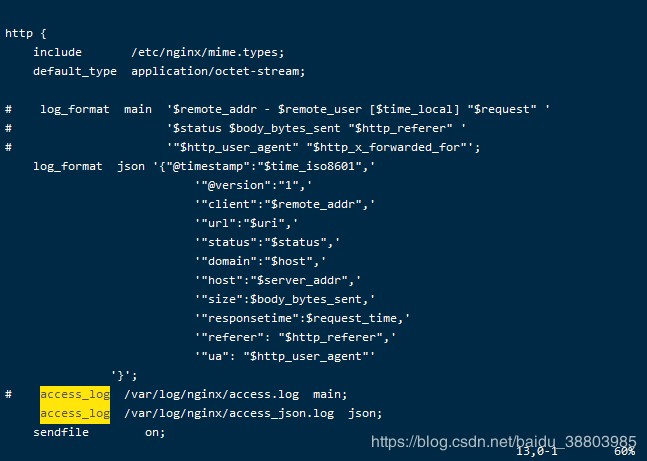

將原來的日誌格式註釋掉定義成json格式:

[root@log conf.d]# vim /etc/nginx/nginx.conf

# 在http模塊裡面添加

log_format json '{"@timestamp":"$time_iso8601",'

'"@version":"1",'

'"client":"$remote_addr",'

'"url":"$uri",'

'"status":"$status",'

'"domain":"$host",'

'"host":"$server_addr",'

'"size":$body_bytes_sent,'

'"responsetime":$request_time,'

'"referer": "$http_referer",'

'"ua": "$http_user_agent"'

'}';

access_log /var/log/nginx/access_json.log json; #引用定義的json格式的日誌:

啟動nginx

[root@log ~]# systemctl start nginx

[root@log ~]# systemctl enable nginx

啟動logstash

[root@log ~]# cd /usr/local/logstash-6.5.4/

[root@log logstash-6.5.4]# nohup bin/logstash -f etc/conf.d/ --config.reload.automatic &

訪問http://192.168.13.143/ 多刷新幾次效果更明顯

然後去head插件頁面查看是否有nginx索引出現 http://192.168.13.139:9100/

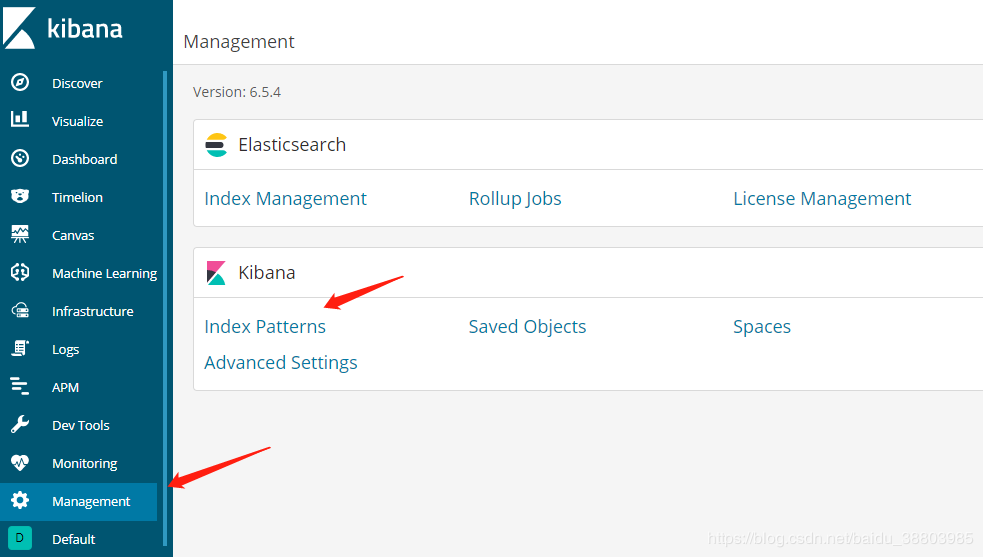

發現之後,去配置kibanna添加索引

然後你就能看見nginx日誌的可視化界面了。

你們的評論和點贊是我寫文章的最大動力,蟹蟹。