[TOC] 歷時兩天,踩了無數坑最後搭建成功。。。 準備 兩台伺服器都安裝jdk1.8(最好裝在相同路徑)。 "hadoop 下載" "hbase 下載" 這裡使用hadoop 2.7.3和hbase1.2.4 伺服器配置 以下1 3步驟中兩台伺服器都要配置 1、修改hostname 主節點修改成m ...

目錄

歷時兩天,踩了無數坑最後搭建成功。。。

準備

伺服器配置

以下1-3步驟中兩台伺服器都要配置

1、修改hostname

主節點修改成master

從節點修改成slave1

使用命令:vim /etc/hostname

master

# or slave1重啟伺服器:reboot

2、修改伺服器hosts

假如主節點是阿裡雲。則在阿裡配置

命令: vi /etc/hosts

ip master

ip1 slave1其中 ip=阿裡的內網ip;ip1=騰訊的外網ip

在騰訊配置

ip master

ip1 slave1其中 ip=阿裡的外網ip;ip1=騰訊的內網ip。

3、安裝jdk1.8,並配置環境變數

4、ssh配置(master主機)

輸入命令生成密匙對

ssh-keygen -t rsa一路回車

上述命令將在/root/.ssh目錄下生成公鑰文件id_rsa.pub。將此文件拷貝到.ssh目錄下的authorized_keys:

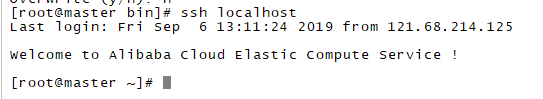

cat /root/.ssh/id_rsa.pub >> /root/.ssh/authorized_keys使用ssh登錄本機

將公鑰複製到從節點

ssh-copy-id -i ~/.ssh/id_rsa.pub root@slave1可能需要輸入從節點密碼。

完成後確保從master免密碼登錄到slave1

對服務的配置就完成了,接下了配置hadoop。

hadoop

在master構建好hadoop,然後利用ssh分發到slave。所以下麵配置在master進行

在home創建hadoop目錄和配置文件路徑

cd /home/

mkdir hadoop

cd hadoop

mkdir hadoop_data

cd hadoop_data

mkdir tmp

mkdir hdfs

cd hdfs

mkdir data

mkdir name1、下載並解壓:

可以使用wget下載或者上傳都可以。

tar zxvf hadoop-2.7.3.tar.gz -C /home/hadoop/2、 配置hadoop

hadoop配置文件路徑 /home/hadoop/hadoop-2.7.3/etc/hadoop

hadoop-env.sh

修改JAVA_HOME。jdk路徑

vi /home/hadoop/hadoop-2.7.3/etc/hadoop/hadoop-env.xmlexport JAVA_HOME=/usr/local/jdk1.8.0_171core-site.xml

vi /home/hadoop/hadoop-2.7.3/etc/hadoop/core-site.xml<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>io.file.buffer.size</name>

<value>131072</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/home/hadoop/hadoop_data/tmp</value>

<description>Abasefor other temporary directories.</description>

</property>

</configuration>hdfs-site.xml

vi /home/hadoop/hadoop-2.7.3/etc/hadoop/hdfs-site.xml<property>

<name>dfs.namenode.secondary.http-address</name>

<value>master:9001</value>

<description>備份namenode的http地址</description>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/home/hjh/hadoop_data/hdfs/name</value>

<description>namenode的目錄位置</description>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/home/hjh/hadoop_data/hdfs/data</value>

<description>datanode's address</description>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

<description>hdfs系統的副本數量</description>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>yarn-site.xml

vi /home/hadoop/hadoop-2.7.3/etc/hadoop/yarn-site.xml<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>master:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>master:8030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>master:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>master:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>master:8088</value>

</property>

</configuration>mapred-site.xml

vi /home/hadoop/hadoop-2.7.3/etc/hadoop/mapred-site.xml

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

<description>指明mapreduce的調度框架為yarn</description>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>master:10020</value>

<description>指明mapreduce的作業歷史地址</description>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>master:19888</value>

<description>指明mapreduce的作業歷史web地址</description>

</property>salve

vi /home/hadoop/hadoop-2.7.3/etc/hadoop/salve

master

slave1該文件指定datanode從節點所在的伺服器ip,這裡只有兩台伺服器,所以將主節點master也加上去)

配置環境變數(方便後續操作)

vim /etc/profile

export HADOOP_HOME=/home/hadoop/hadoop-2.7.3

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin . source /etc/profile最後copy這個hadoop給slave1

scp -r /home/hadoop/hadoop-2.7.3 root@slave1:/home/hadoop/啟動hadoop

以下在master進行

1、先格式化namenode

hadoop namenode -format2、啟動hadoop

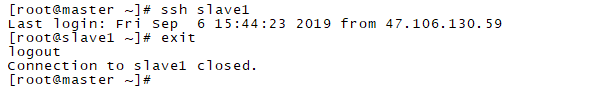

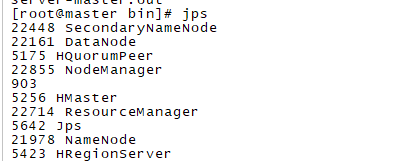

./start-all.sh執行:jps,查看相關進程

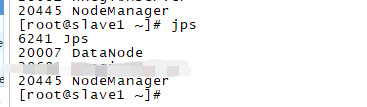

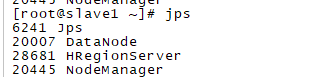

在slave1執行jps,

如果相關進程沒有啟動則去查看logs對應的模塊的日誌。準備埋坑。

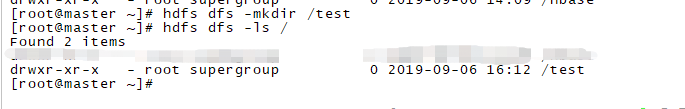

在hdfs創建目錄試試:

在master

hdfs dfs -ls /hdfs是空的沒有返回任何東西。

創建目錄test

hdfs dfs -mkdir /test

hdfs dfs -ls /

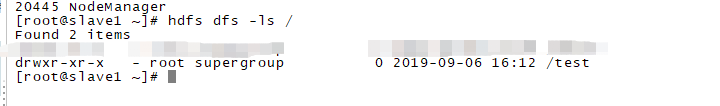

在slave1中同樣可以看到test

至此hadoop搭建完成。

hbase

在master構建,然後分發到slave

1、下載並解壓:

可以使用wget下載或者上傳都可以。

tar zxvf hbase-1.2.4.tar.gz -C /home/hadoop/2、 配置hbase

hbase配置文件路徑 /home/hadoop/hbase-1.2.4/conf

複製hadoop的hdfs-site.xml和core-site.xml到conf

cp -u /home/hadoop/hadoop-2.7.3/etc/hadoop/hdfs-site.xml /home/hadoop/hbase-1.2.4/conf

cp -u /home/hadoop/hadoop-2.7.3/etc/hadoop/core-site.xml /home/hadoop/hbase-1.2.4/conf

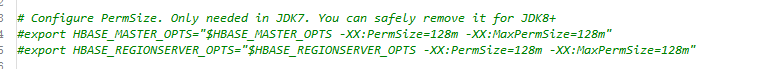

hbase-env.sh

vi /home/hadoop/hbase-1.2.4/conf/hbase-env.sh由於使用jdk1.8 將如下註釋

#配置jdk環境

export JAVA_HOME=/usr/local/jdk1.8.0_171

#配置zookeeper,true則說明使用hbase內置的zookeeper,false則說明使用單獨的zookeeper集群

export HBASE_MANAGES_ZK=truehbase-site.xml

vi /home/hadoop/hbase-1.2.4/conf/hbase-site.xml<!--這是regionServer的共用目錄,用來持久化hbase的,埠預設9000-->

<property>

<name>hbase.rootdir</name>

<value>hdfs://master:9000/hbase</value>

</property>

<!--hbase的運行模式,false是單機模式,true是分散式模式;

若設置為false,hbase和zookeeper會運行在同一個JVM裡面-->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!--hbase主節點的埠,預設60000-->

<property>

<name>hbase.master</name>

<value>master:60000</value>

</property>

<!--zookeeper集群的地址列表,用逗號分割,預設localhost,這裡的機器太少所以只用了一個zookeeper。否則會出錯-->

<property>

<name>hbase.zookeeper.quorum</name>

<value>master</value>

</property>regionservers

vi /home/hadoop/hbase-1.2.4/conf/regionserversmaster

slave1最後分發個slave1

scp -r /home/hadoop/hbase-1.2.4 root@slave1:/home/hadoop/在master 啟動hbase

在hbase/bin 下啟動hbase

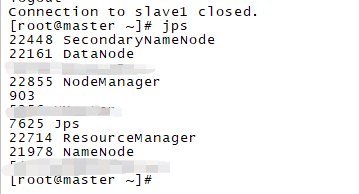

./start-hbase.shmaster運行jps查看相關進程

slave1

出錯看logs查看那個模塊出問題。

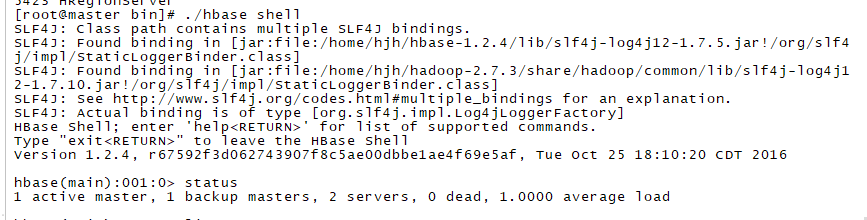

運行hbase shell

整個hadoop + hbase 就搭建好了

JAVA測試

/**

* @Description:

* @Author: HJH

* @Date: 2019-09-04 17:06

*/

public class HBaseConn {

private static final HBaseConn INSTANCE = new HBaseConn();

private static Configuration configuration;

private static Connection connection;

private HBaseConn() {

try {

if (configuration == null) {

configuration = HBaseConfiguration.create();

configuration.set("hbase.zookeeper.quorum", "ip"); //master ip

System.setProperty("hadoop.home.dir", "E:\\hadoop-2.7.3");

configuration.set("hbase.zookeeper.property.clientPort","2181"); //埠號

}

} catch (Exception e) {

e.printStackTrace();

}

}

private Connection getConnection() {

if (connection == null || connection.isClosed()) {

try {

connection = ConnectionFactory.createConnection(configuration);

} catch (Exception e) {

e.printStackTrace();

}

}

return connection;

}

public static Connection getHBaseConn() {

return INSTANCE.getConnection();

}

public static Table getTable(String tableName) throws IOException {

return INSTANCE.getConnection().getTable(TableName.valueOf(tableName));

}

public static void closeConn() {

if (connection != null) {

try {

connection.close();

} catch (IOException ioe) {

ioe.printStackTrace();

}

}

}

}public class HBaseUtil {

public static void main(String[] args) {

createTable("FileTable", new String[]{"fileInfo", "saveInfo"});

}

/**

* 創建TABLE

* @param tableName 表名

* @param cfs 列族

* @return 是否創建成功

*/

public static boolean createTable(String tableName, String[] cfs) {

try (HBaseAdmin admin = (HBaseAdmin) HBaseConn.getHBaseConn().getAdmin()) {

if (admin.tableExists(tableName)) {

return false;

}

HTableDescriptor tableDescriptor = new HTableDescriptor(TableName.valueOf(tableName));

Arrays.stream(cfs).forEach(cf -> {

HColumnDescriptor columnDescriptor = new HColumnDescriptor(cf);

columnDescriptor.setMaxVersions(1);

tableDescriptor.addFamily(columnDescriptor);

});

admin.createTable(tableDescriptor);

} catch (Exception e) {

e.printStackTrace();

}

return true;

}創建成功