1. 通常防止爬蟲被反主要有以下幾個策略 (1)動態設置User Agent(隨機切換User Agent,模擬不同的瀏覽器) 方法1: 修改setting.py中的User Agent 方法2: 修改setting中的 DEFAULT_REQUEST_HEADERS 方法3 : 在代碼中修改 (2 ...

1. 通常防止爬蟲被反主要有以下幾個策略

(1)動態設置User-Agent(隨機切換User-Agent,模擬不同的瀏覽器)

方法1: 修改setting.py中的User-Agent

# Crawl responsibly by identifying yourself (and your website) on the user-agent

USER_AGENT = 'Hello World' #User-Agent方法2: 修改setting中的 DEFAULT_REQUEST_HEADERS

# Override the default request headers:

DEFAULT_REQUEST_HEADERS = {

'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8',

'Accept-Language': 'en',

'User-Agent':'Hello World'

}方法3 : 在代碼中修改

class HeadervalidationSpider(scrapy.Spider):

name = 'headervalidation'

allowed_domains = ['helloacm.com']

def start_requests(self):

header={'User-Agent':'Hello World'}

yield scrapy.Request(url='http://helloacm.com/api/user-agent/',headers=header,callback=self.parse)

def parse(self, response):

print ('*'*20)

print response.body(2)禁用Cookies

就是不啟用cookies middleware,不向Server發送cookies,有些網站通過cookie的使用發現爬蟲行為

可以通過settings.py中的

COOKIES_ENABLED, 控制 CookiesMiddleware 開啟或關閉設置延遲下載(防止訪問過於頻繁,設置為 2秒 或更高)

DOWNLOAD_DELAYGoogle Cache 和 Baidu Cache:如果可能的話,使用谷歌/百度等搜索引擎伺服器頁面緩存獲取頁面數據。

使用IP地址池:VPN和代理IP,現在大部分網站都是根據IP來ban的

使用Crawlera(專用於爬蟲的代理組件),正確配置和設置下載中間件後,項目所有的request都是通過crawlera發出。在settings中打開下載中間件

DOWNLOADER_MIDDLEWARES = { 'scrapy_crawlera.CrawleraMiddleware': 600 } CRAWLERA_ENABLED = True CRAWLERA_USER = '註冊/購買的UserKey' CRAWLERA_PASS = '註冊/購買的Password'

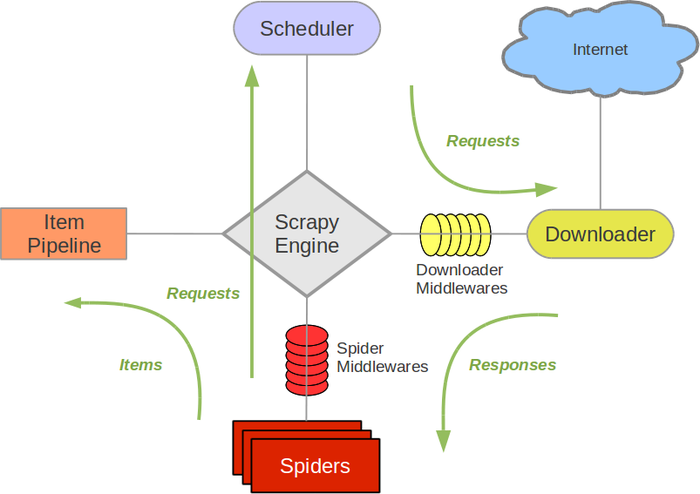

2.設置下載中間件(Downloader Middlewares)

下載中間件是處於引擎(crawler.engine)和下載器(crawler.engine.download())之間的一層組件,可以有多個下載中間件被載入運行。

- 當引擎傳遞請求給下載器過程中,下載中間件可以對請求進行處理 (增加http header信息 proxy信息等);

- 在下載器完成http請求,傳遞響應給引擎過程中,下載中間件可以對響應進行處理(例如進行gzip的解壓等)

要激活下載器中間件組件,將其加入到 DOWNLOADER_MIDDLEWARES 設置中。 該設置是一個字典(dict),鍵為中間件類的路徑,值為其中間件的順序(order)。

#開放下載中間件

DOWNLOADER_MIDDLEWARES = {

'mySpider.middlewares.MyDownloaderMiddleware': 543,

}

一般下載中間件可以定義一下一個或多個方法:

process_request(self, request, spider)

- 當每個request通過下載中間件時,該方法被調用。

- process_request() 返回其中之一:None 、 Response 對象、 Request 對象或 raise IgnoreRequest:

- 如果其返回 None ,Scrapy將繼續處理該request,執行其他的中間件的相應方法,直到合適的下載器處理函數(download handler)被調用, 該request被執行(其response被下載)。

- 如果返回 Response 對象,Scrapy將不會調用 任何 其他的 process_request() 或 process_exception() 方法。 已安裝的中間件的 process_response() 方法則會在每個response返回時被調用。

- 如果其返回 Request 對象,Scrapy則停止調用 process_request方法並重新調度返回的request。當新返回的request被執行後, 相應地中間件鏈將會根據下載的response被調用。

- 如果其raise一個 IgnoreRequest 異常,則安裝的下載中間件的 process_exception() 方法會被調用。如果沒有任何一個方法處理該異常, 則request的errback(Request.errback)方法會被調用。如果沒有代碼處理拋出的異常, 則該異常被忽略且不記錄(不同於其他異常那樣)。

- 參數:

request (Request 對象)– 處理的requestspider (Spider 對象)– 該request對應的spider

process_response(self, request, response, spider)

當下載器完成http請求,傳遞響應給引擎的時候調用

- process_response() 必須返回以下其中之一: 返回一個 Response 對象、 返回一個 Request 對象或raise一個 IgnoreRequest 異常。

- 如果其返回一個 Response (可以與傳入的response相同,也可以是全新的對象), 該response會被在鏈中的其他中間件的 process_response() 方法處理。

- 如果其返回一個 Request 對象,則中間件鏈停止, 返回的request會被重新調度下載。處理類似於 process_request() 返回request所做的那樣。

- 如果其拋出一個 IgnoreRequest 異常,則調用request的errback(Request.errback)。 如果沒有代碼處理拋出的異常,則該異常被忽略且不記錄(不同於其他異常那樣)。

- 參數:

request (Request 對象)– response所對應的requestresponse (Response 對象)– 被處理的responsespider (Spider 對象)– response所對應的spider

3 案例

創建

middlewares.py文件Scrapy代理IP、Uesr-Agent的切換都是通過

DOWNLOADER_MIDDLEWARES進行控制,我們在settings.py同級目錄下創建middlewares.py文件,包裝所有請求。

# middlewares.py

import random

from settings import USER_AGENTS

from settings import PROXIES

# 隨機的User-Agent

class RandomUserAgent(object):

def process_request(self, request, spider):

useragent = random.choice(USER_AGENTS)

request.headers.setdefault("User-Agent", useragent)

# 隨機代理IP

class RandomProxy(object):

def process_request(self, request, spider):

proxy = random.choice(PROXIES)

request.meta['proxy'] = "http://" + proxy['ip_port']- 修改settings.py配置USER_AGENTS和PROXIES

添加USER_AGENTS

USER_AGENTS = [

"Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; Win64; x64; Trident/5.0; .NET CLR 3.5.30729; .NET CLR 3.0.30729; .NET CLR 2.0.50727; Media Center PC 6.0)",

"Mozilla/5.0 (compatible; MSIE 8.0; Windows NT 6.0; Trident/4.0; WOW64; Trident/4.0; SLCC2; .NET CLR 2.0.50727; .NET CLR 3.5.30729; .NET CLR 3.0.30729; .NET CLR 1.0.3705; .NET CLR 1.1.4322)"]添加代理IP設置PROXIES:

PROXIES = [

{'ip_port': '111.8.60.9:8123'},

{'ip_port': '101.71.27.120:80'},

{'ip_port': '122.96.59.104:80'},

{'ip_port': '122.224.249.122:8088'},

]除非特殊需要,禁用cookies,防止某些網站根據Cookie來封鎖爬蟲。

COOKIES_ENABLED = False設置延遲

DOWNLOAD_DELAY = 3最後設置setting.py里的DOWNLOADER_MIDDLEWARES,添加自己編寫的下載中間件類

DOWNLOADER_MIDDLEWARES = {

#'mySpider.middlewares.MyCustomDownloaderMiddleware': 543,

'mySpider.middlewares.RandomUserAgent': 81,

'mySpider.middlewares.ProxyMiddleware': 100

}