分享嘉賓:張政 京東 演算法工程師 編輯整理:AMS 周金星 出品平臺:DataFunTalk 導讀: 內容生態建設是近幾年互聯網快速發展的關鍵動因,也是AI化的重點方向之一。本文主要分享在京東廣告業務下內容理解體系的建設情況,從標簽化、內容準入、質量美學評價等多個角度探討內容理解能力的應用;同時整體 ...

分享嘉賓:張政 京東 演算法工程師

編輯整理:AMS 周金星

出品平臺:DataFunTalk

導讀: 內容生態建設是近幾年互聯網快速發展的關鍵動因,也是AI化的重點方向之一。本文主要分享在京東廣告業務下內容理解體系的建設情況,從標簽化、內容準入、質量美學評價等多個角度探討內容理解能力的應用;同時整體介紹智能創意助力廣告內容生態建設,從內容理解到內容生成(視頻、圖片、文案),再到內容分發,並穿插OCR、智能摳圖、多模態等相關的基礎前沿演算法能力。

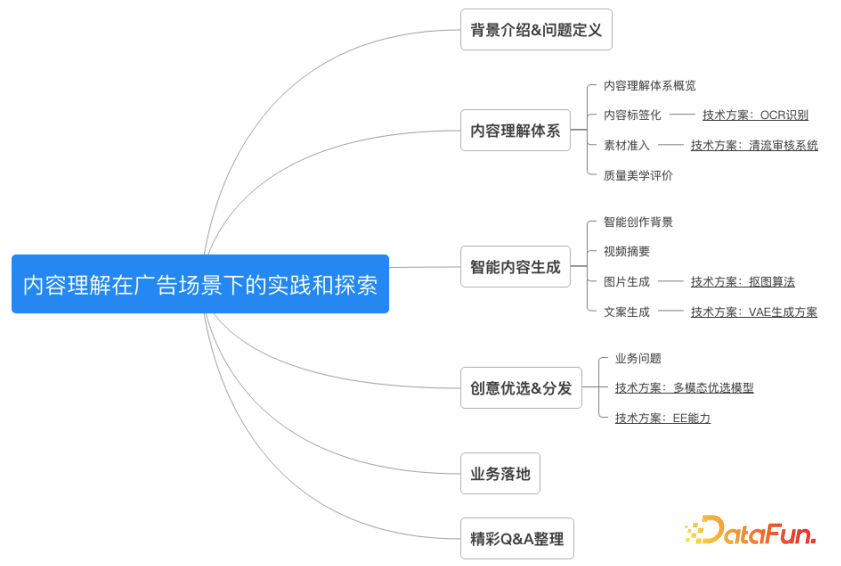

本文將圍繞以下幾部分進行展開:

- 背景介紹

- 內容理解體系

- 智能內容生成

- 創意優選&分發

- 業務落地

--

01 背景介紹&問題定義

為什麼要做智能創意?由圖可見,從04年開始內容化生態逐步崛起,帶動了互聯網的新一波發展,特別是短視頻,涌現出瞭如抖音、快手等一系列新媒體,目前已擁有大量受眾。另外,像京東、阿裡這類電商平臺也在做內容化,直播、視頻、互動等新玩法,加速了內容化的能力建設。因此總結兩點:

- 流量的內容化成就了互聯網的增量

- 內容的電商化開始引領主流趨勢

針對龐雜的信息,如何更好地理解並推薦給用戶,是智能創意要解決的問題。同時在內容化建設的大背景下,平臺方也承擔了廣告內容生態建設的關鍵職責。

對智能創意的定義是:通過AI對商品內容進行理解,在感知學習的基礎上構建規劃和推理能力,基於實時的生成引擎和素材挖掘來構建視頻、圖片、文案的創意,並通過創意優選來實現精準的用戶匹配。可以簡單歸納為三個階段:內容的理解、生成和分發。

上圖呈現了智能創意的全過程,也是本次分享內容的主要框架:

1. 內容理解

最左邊是商品信息,京東站內擁有數以億計的商品,每個商品的內容信息包括了標題、主圖、商品詳情圖、用戶評論等。基於這些數據,可以做很多事情,比如藉助NLP,可以通過標題壓縮來生成短標題或者新標題,通過主顏色識別或者商品識別來建立圖片內容的標簽,從而判斷圖片是否足夠優質,是否適合作為廣告露出。

2. 創意生成

藉助CV能力,可以通過佈局理解或素材挖掘,對商品詳情圖進行結構化的分析,藉助智能裁剪生成新圖片來更突出商品的主體或者賣點等。藉助視頻分析,可以通過人的檢測或行為識別,對視頻里的優質片段或精彩點進行摘要,再提取更優質的內容讓用戶更容易get到商品賣點。在這些基礎上,構建的就是內容的標簽化,在內容標簽化構建完成後可以藉助智能搭配能力來進行創意生成。

3. 創意分發

創意內容存在多樣性,如何更好地體現賣點,就要藉助創意優選,創意優選是一個內容的分發階段,分發階段需要解決的問題是如何基於優選模型來實現生成內容和用戶的個性化匹配,後文會講到多模態演算法的應用。在京東的電商體系下,內容是一個天然的多模態場景,它包含文字、視頻、圖像、語音等各種多模態數據,如何對這些數據進行更好地融合和表徵,是做好內容分發的關鍵點。

--

02 內容理解體系

1. 內容理解體系概覽

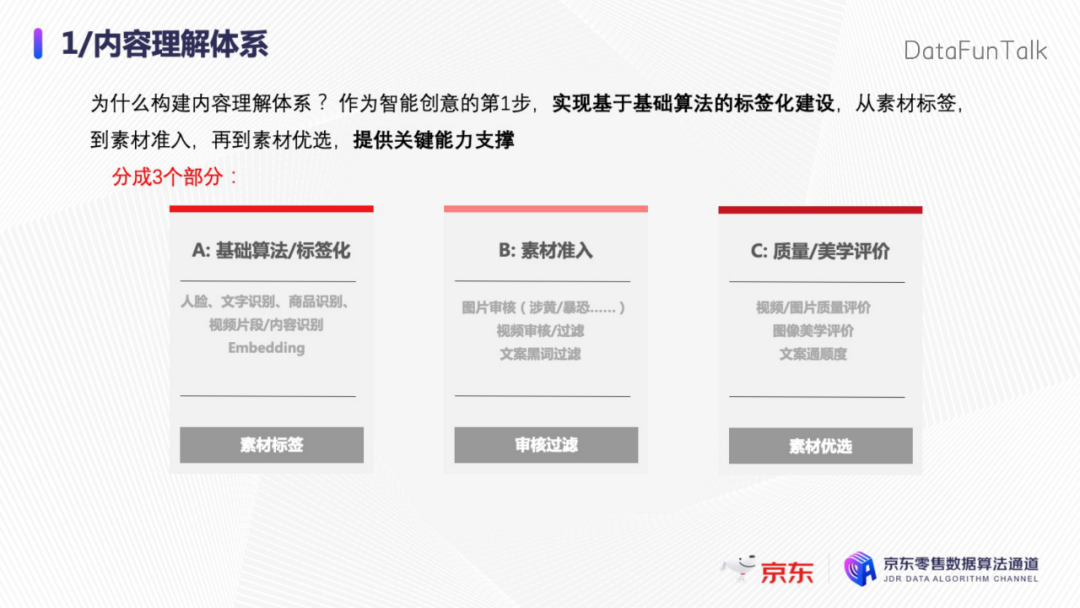

為什麼要構建內容體系?作為智能創意的第一步,它用於實現基礎演算法的標簽化,從素材標簽到素材準入,再到素材優選,都可以提供關鍵的能力支撐。內容體系分為三個部分:

- 第一部分是基礎演算法以及內容標簽化,底層用到了大量的基礎演算法;

- 第二部分是素材準入,是指通過審核解決數據篩選和過濾問題;

- 第三部分是質量和美學的評價,即如何去從眾多內容中篩選優質的素材或者創意。

2. 內容標簽化

如上圖,先通過場景分類或者語義分割提取圖片的背景,是天空還是草地。同時,藉助商品檢測去檢測裡面的人,或者他背的包,藉助商品分割,可以精確地分割商品的邊緣。有了邊緣信息後,對商品的細節特征進行分析,比如得到商品屬性:黑色的女包。商品屬性可以用於後續的商品檢索,通過找到類似的商品進行內容的召回和推薦。關於商品標題,可以從標題去做基礎解析,比如抽取產品詞、屬性詞、修飾詞等。

對於整個圖片,能通過美學的質量評價給圖片打分,比如畫面是否足夠清晰,亮度是否正常等,以及基於logo檢測,檢測圖片上有沒有商品logo等。

演算法角度,對於圖片,有大量圖像演算法可以去做分析,但因為內容理解本身會受限於基礎演算法的準確度,在實際業務上可能會面臨非常大的挑戰。比如我們基於MS COCO的數據集,在做檢測的時候AP0.5只能做到78%,同樣每個底層演算法都會面臨準確度的問題。在電商場景下,因為商品類型更具有多樣性,所以面臨的挑戰會更大。

龐大的商品體系會導致面臨商品類別的多樣、類別相似、內間樣本不均衡等問題。同時和自然場景不一樣,電商場景因為存在大量的handmade,比如圖片上加的牛皮癬等。為瞭解決這些問題,我們前期進行了大量的數據集標註、數據集的模擬和增強,同時也構建了一套底層的基礎演算法服務,可以保障整體的服務效率,對模型進行了輕量化的TensorRT加速等等工作。最終形成了一套基礎的商品結構化的素材庫, cover了億級別的SKU,通過對這些商品內容進行結構化的提取,應用於各業務線。

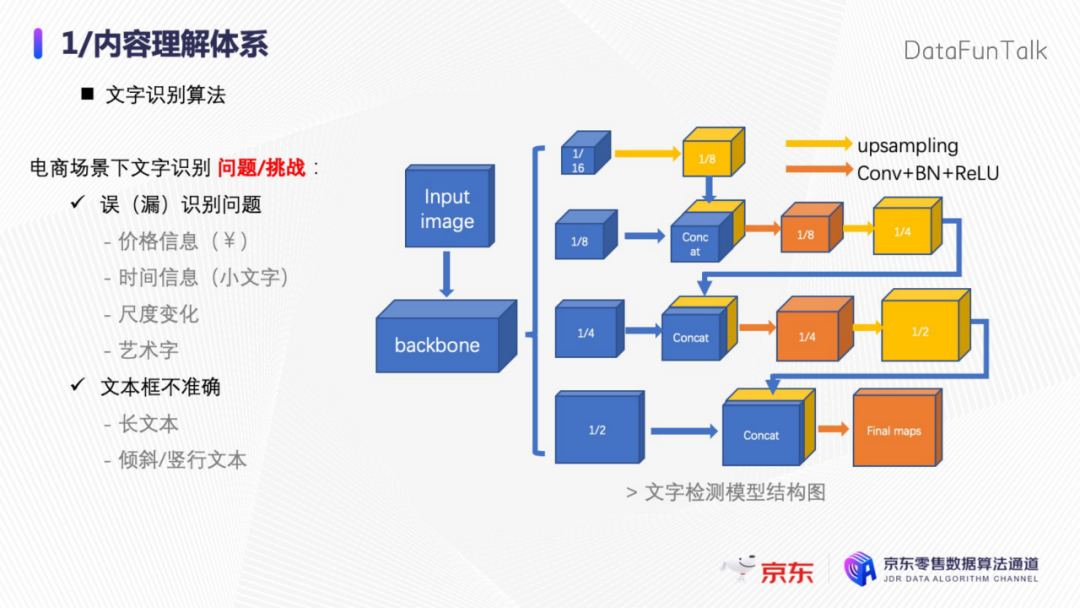

基礎演算法以OCR識別為例展開講解。OCR現在的應用非常廣泛,比如安防監控領域的車輛識別,金融領域的票據識別,線上教育的考題識別等。雖然文字識別演算法經歷了長期的發展,基於深度學習效果上也取得了非常大的進步,但目前仍存在很多挑戰,比如背景的干擾、不規則的文字等,這些都成為制約演算法效果的典型問題。同時針對多尺度、不同語言、密集文本行等問題,也對演算法的準確性和魯棒性提出了更高的要求和挑戰。

對於電商場景同樣如此,作為內容理解和生成中調用最多的演算法,OCR在智能創意的體系中扮演關鍵的角色。我們面臨的問題有誤檢或者漏檢:內容包含價格信息、時間信息、尺度的變化、藝術字等;對文本框檢測不准確:可能會遇到特別長的文本,或者是傾斜的、豎版文本等。

面對這些問題,我們從數據標註、數據模擬、模型設計以及模型加速等幾個方面建立了一套專門的體系。上圖右邊是一個典型的檢測模型結構圖。

文字識別演算法分為檢測和識別兩部分,表格模型對比展示了我們檢測演算法的檢測效果。主流的文字檢測演算法分為三種:

- 第一種是Anchor-based的方法,最早的fast R-CNN就是基於Anchor-based去做的

- 第二種是基於Anchor-free的回歸方法

- 第三種是基於分割的方法

Anchor-based的回歸方法是從傳統的目標檢測演算法發展而來,通過調整Anchor的寬高比來適應文字檢測中寬高比過大的問題,經典的演算法有Textboxes等,這類方法比較簡單直接容易理解,但問題是有了Anchor以後,召回比較高,但是精度較差,而且它會受限於Anchor的配比,例如要檢測寬高比為 3:1 的Anchor,對於寬高比為 10:1 的長文本檢測能力就會比較差。

還有一些問題比如傾斜,對於傾斜問題也有一些新演算法,比如RRCNN來通過預測一個旋轉角來解決。隨著網路表達能力的提升,一些Anchor-free的方法也取得了比較不錯的效果,且速度上也有明顯優勢,其中比較有代表性的是East演算法,它可以預測每個點到文本框或者文本框頂點的距離,通過這種方式來回歸矩形框,該方法在工業界得到了很好的落地,我們前期也用過。

第三種方法,比如近些年大家都在研究基於彎曲的檢測等方法,都是基於分割的方法,也就是通過判別圖像中每個像素是否屬於某個文本框,這樣可以檢測出任意形狀的文本框,比較經典的有一些PSEnet或者DBnet等,基於分割的方法主要挑戰在於如何分離不同的文本實例,上述方法都提出了自己的解決方案,尤其是DBnet,可以大大縮短後處理的時間。

對於檢測模型的優化,我們在實際的商品詳情頁上,基於大量的商品數據統計了其中具體的文本分佈,包括文字、字體、字型大小、顏色、方向等,並結合這個數據標註以及樣本模擬來構建了一個十萬量級的數據集。雖然效果上已經很不錯了,但是對於一些特別小的字體,仍然有很大的提升空間。目前我們的線上OCR模型每天調用上億次,面對如此龐大的應用,我們也通過輕量級的模型包括TensorRT加速來實現高吞吐率和TP99的性能。另外對於數據集,我們目前準備增加一些多模態的數據標註,比如商品的類目、品牌等信息,後面有合適的機會我們也會將該數據集開源。

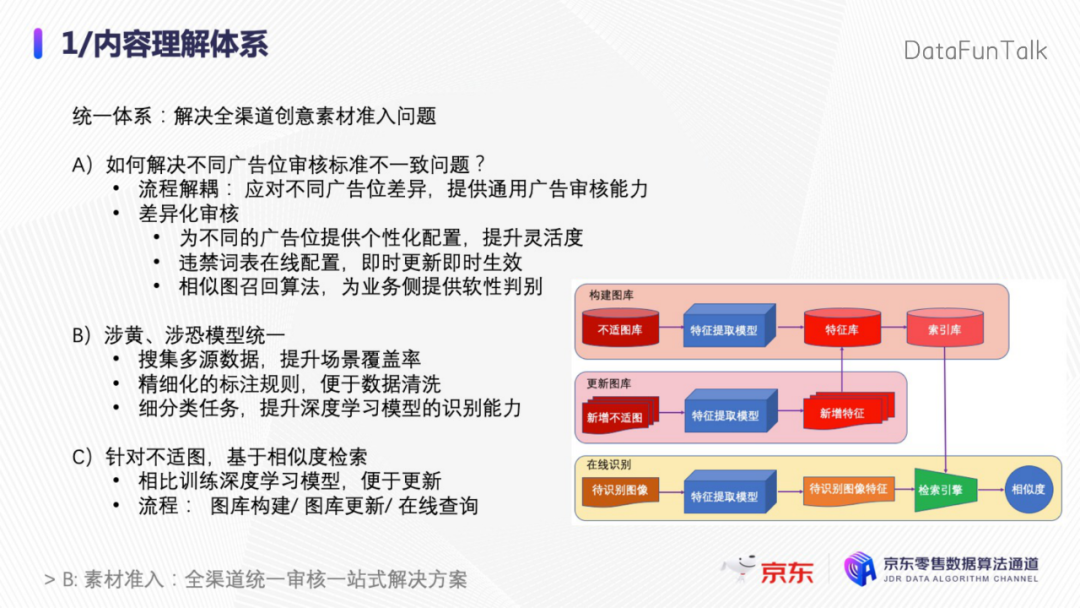

3. 素材準入

內容理解的第二部分主要解決的是素材的準入問題。為什麼要解決這個問題比較好理解,比如你在逛京東的時候,不希望突然看到一個恐怖的商品圖,或者一張帶牛皮癬的不適圖,或者是一張過於性感暴露的美女圖。當然也有很多人喜歡看美女圖,所以可能會面臨標準界定的問題:有人覺得OK的圖片在某些媒體就有投訴風險。如何去解決分級的問題?

一方面,為不同的廣告位提供不同的配置,通過Score得分閾值來提供給業務方進行控制。

另一方面,針對比如涉黃涉恐不同的模型,我們是統一為一個大模型進行訓練,通過這種方法來提升整體的識別能力。

對於不適圖,由於其標准定義不夠清晰、內容變化、差異較大等問題,是很難通過一個有效的數據進行標註的,為此我們建立了一套基於相似度檢索的不適圖識別演算法。首先通過圖片的embedding來提取特征,通過特征加入特征索引庫,以相似度召回的方式來召回與特征相似的一些圖片。我們認為如果相似,它是不適圖的概率就會比較大。基於這種方法,可以對不適圖庫進行定期更新和調整,可以有效解決線上case快速響應的問題。

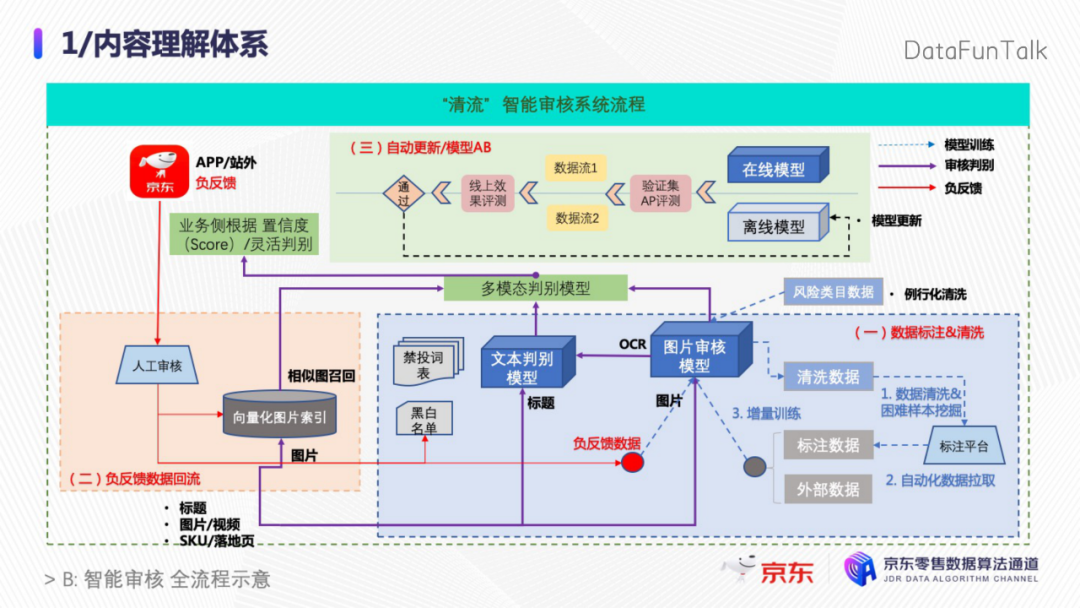

為了應對整個京東廣告體系下的素材準入和審核問題,我們構建了一套清流的智能審核系統。如上流程圖,整個系統分為三個部分。

第一部分是建立數據標註和清洗的規則,然後藉助數據清洗和困難樣本挖掘,結合自動化的數據拉取,可以為標註平臺提供充足的標準數據。

第二部分是針對APP的負反饋建立了數據迴流機制,通過建立向量圖片庫,藉助人工審核的基礎提供給訓練模型更具有時效性的訓練數據,同時結合文本分類、圖片的審核模型,形成一個多模態的判別模型,可以大大提升模型的整體準確度。

第三是通過自動更新和模型的ABtest來保證線上模型在實際業務中的識別效果。目前我們審核系統已經對億級的廣告商品進行審核,可以覆蓋標題、圖片、視頻以及落地頁等,已經成為智能創意裡面不可或缺的一個關鍵部分。

4. 質量/美學評價

接下來是內容理解體系的第三部分,美學和質量評價體系的建立。在素材準入的基礎上,如何篩選出更優質的素材,產出更優質的創意,這就是評價體系要解決的問題。評價體系的建立並不像人的直觀判別這麼簡單,首先是數據標註問題,每個人衡量美醜的標準是不一樣的。其次需要有效地解決各個維度之間的對齊和配比問題,針對這個問題,我們的方案是建立一個模型化端到端的解決方案,這樣做的優勢有兩個:

- 第一是可以讓模型去學習各個維度之間的權重和耦合關係;

- 第二是可以發掘除了現有維度之外的特征,還可以結合我們的希望讓模型學到一些額外特征,比如點擊率的影響等。

以上就是我們內容理解體系要解決的問題。

--

03 智能內容生成

1. 智能創作背景

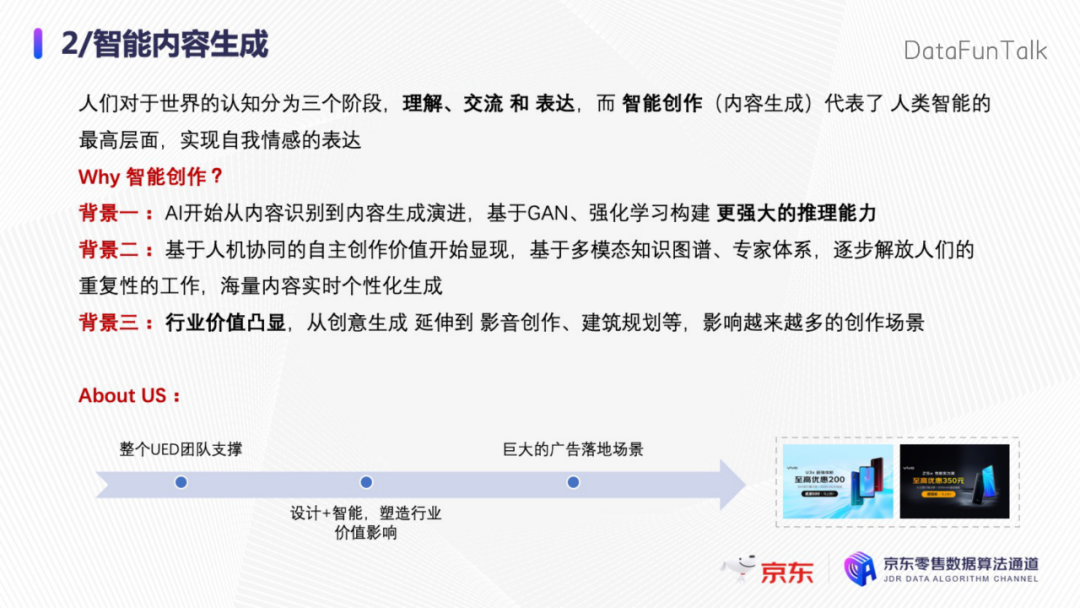

人們對於世界的認知可以分為三個階段:對這個世界進行理解,然後在理解的基礎上,可以進行交流,最後在理解和交流的能力建立以後,會通過智能創作來進行自我情感的表達。

- 第一個階段:AI已經開始從內容識別到內容生成的演進,可以基於GAN和強化學習來構建更強大的推理能力。

- 第二個階段:基於人機協同的自主創作價值開始顯現,基於多模態的知識圖譜、專家體系可以逐步解放人們的重覆性工作,來實現海量內容的實時個性化生成。

- 第三個階段:行業價值開始凸顯,從創業生成衍生到影音創作、建築規劃等,會影響越來越多的創作場景。

在智能創作上,我們會有整個UED團隊作為支撐,然後通過設計+智能來塑造行業的價值影響,同時基於巨大的廣告落地場景,致力於AI創作的不斷迭代和實踐。下麵我分幾個具體的任務場景來簡單介紹。

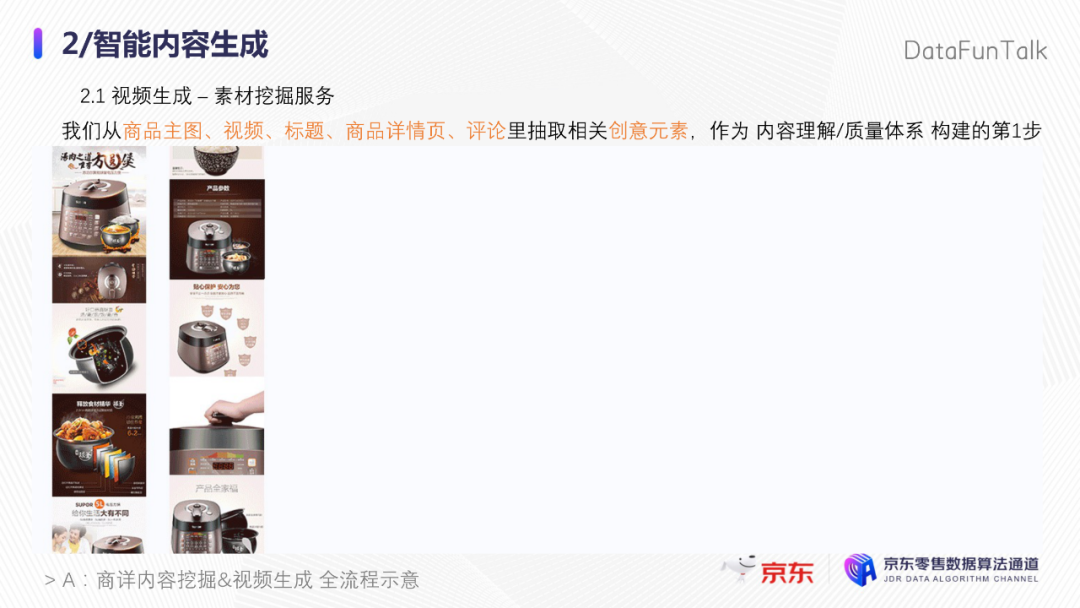

上圖呈現的從商詳內容挖掘到視頻生成的整個過程。其中用到的演算法比較多,比如文字識別、智能裁剪、顯著性判斷、語音等。商詳頁作為一個典型的場景,包含了大量有價值的商品圖片,首先基於佈局分析來對圖片里的有效內容進行裁剪,然後在這個基礎上通過商品識別來提取有價值的商品圖,並通過相似度的匹配來進行圖片過濾,這樣可以兼顧內容的有效性和多樣性,同一個商品我們不希望同樣的圖出現多次。然後基於文字識別和NER模型分別提取圖片和商品標題里的關鍵賣點,同時通過TTS的演算法將字幕轉化成語音。最後結合背景音樂或者特效來生成最終視頻,這就是從商詳挖掘到視頻生成的整個過程。這是我們早期的方案,現在我們更多是從視頻的拍攝角度、視頻摘要、視頻片段之間的組合去做視頻生成。

2. 視頻摘要生成

第一個任務場景是視頻摘要,即基於商家上傳的長視頻提取精彩片段,通過重新組合來形成情節更加緊湊,賣點更加突出的短視頻,因為現在短視頻的應用場景非常多。

如何生成視頻摘要?

首先是鏡頭切分,對視頻中每一幀的特征進行分析,提取相鄰幀之間的特征相似度從而判斷視頻中每一個鏡頭的邊界,基於傳統的演算法或深度學習的方式都可以實現。

第二部分是藉助前面提到的視頻標簽化能力,建立商品檢測、人臉、人體的檢測、文字或者視頻質量、動作這些標簽,在此基礎上建立標簽化表示。

第三部分是會引入文本特征,主要包括品牌詞、產品詞,以及完整的標題等,可以建立文本特征的統一表示。

第四部分是在建立特征表示以後,會去計算特征間的相關性,比如根據商品主圖或者文案信息的特征來得到商品特征或文本特征,可以匹配視頻中與該特征相關的一些片段,同時可以考慮對視頻中其他識別結果的作用,比如突出商品或突出視頻的多樣性,這都是不同的生成目標,我們可以在不同的目標基礎上去調整不同的權重,來生成不同的短視頻。

最後是目標鏡頭的識別,是綜合視覺的相關性和文本的相關性來識別視頻中的目標鏡頭,可以採用加權融合,也可以直接讓模型按照你的配比去進行學習。

目前摘要演算法已經廣泛應用於站內外的各個場景,同時也為自動化的生成及其工具化提供了能力。

可以看以上兩個演算法實例,它們是通過摘要演算法對商品的關鍵片段進行了抽取,對商品的關鍵細節特征以及圖文相結合的內容進行了選取,主要是突出質感、攝像功能等一些賣點,左邊是原始視頻,右邊是摘要生成的視頻,更突出商品以及商品的圖文相關性。短視頻的優勢是可以在最短的時間內去吸引用戶關註,所以會更多地去突出一些典型的、精彩的點。以上是我們視頻摘要演算法的過程。

3. 圖片創意生成

第二個任務場景是圖片的創意生成,圖片創意生成是在創意元素基礎上進行智能的衍生和加工,再結合組件化、序列化或者模型化的方式來進行生成。

圖片生成有四個典型的部分:原生/場景化、分層/組件化、微動效、實時的圖片生成引擎。左邊的圖是原生場景化的生成方案,通過對商品背景進行提取,然後結合GAN進行背景生成,得到和商品背景顏色、調性一致的圖片。右邊的圖是序列化的生成方案,是將創意拆解成背景層、裝飾層、商品層、遮罩層,還有文字組件層,並通過智能搭配、智能佈局來進行實時的生成。

這裡要強調下我們打造的一個基於用戶特征的實時優選和生成的引擎,引擎可以實現創意到用戶的實時個性化的解決方案。假設每個創意包含十組文案、十個背景和十個裝飾層,就可以得到1000種組合關係,實際的情況可能比這個還要多。線上目前採取的是先優選再生成的思路,通過優選模型,先選擇好的創意元素,再藉助實時生成引擎來進行元素的組合渲染,整個過程可以控制在20毫秒以內,該引擎已經成為我們智能圖片生成的核心支撐。

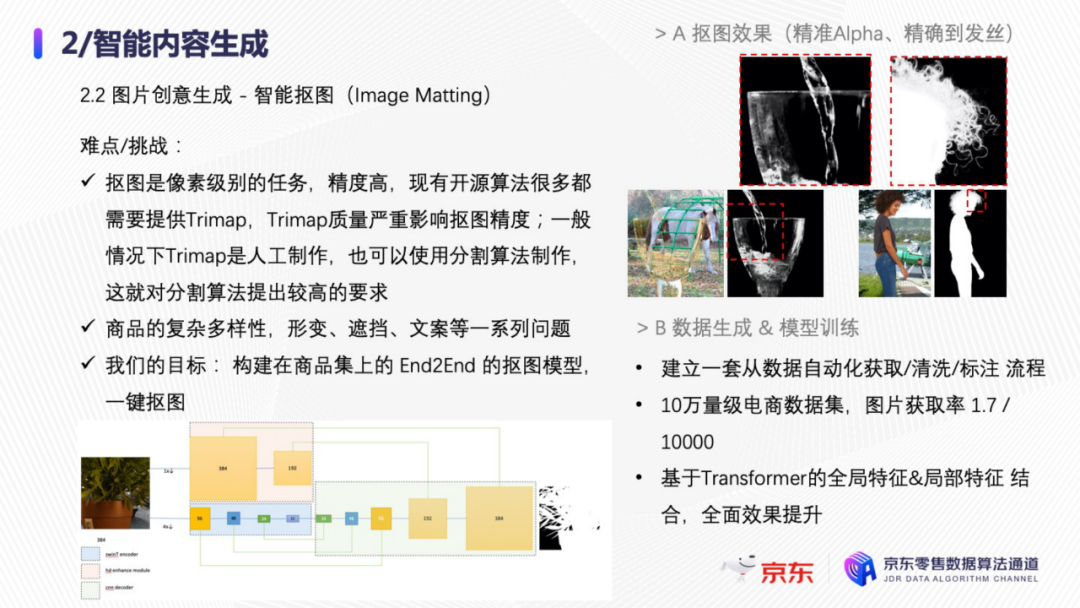

與之對應,介紹智能摳圖演算法,摳圖在業務上已經大量使用了,為內容生成提供了大量的透底圖素材,作為後續序列化生成的基礎。語義分割或者實例分割演算法中,物體的邊緣定位或對於邊緣像素的分類是一個比較難解決的問題,而摳圖演算法在這個基礎上面臨的挑戰更大:

- 第一是作為像素級的任務,如何對邊緣進行更好的定位,包括邊緣像素的Alpha值提取,這是更難的。

- 第二是商品的多樣性,京東站內的商品種類上億,同時還會面臨諸如形變、遮擋、或者圖上有文字等一系列問題,都會影響識別或者摳圖的效果。

針對這些挑戰,我們的目標是構建一個基於商品集的端到端的摳圖模型,通過這種方式實現一鍵摳圖。右上方是我們的扣圖效果,目前看還是不錯的。

針對訓練數據生成和模型訓練,我們做了一些優化:

在數據上,建立一套從數據獲取到清洗、標註、訓練的自動化流程。其中用到了很多輔助演算法,包括相似度識別、圖像校正、質量清晰的判別過濾等。在此基礎上,構建了一個十萬量級的電商數據集,目前數據獲取率只有1.7/10000。

在演算法上,我們採用了Transformer來對商品和背景的特征進行提取。這種方法可以對全局特征和局部特征進行比較好的結合,既能保證全局語義的完整性,又保留了待摳圖商品部分的邊緣細節,同時加入了Attention的方式,可以對商品的邊緣和背景之間的聯通區域做有效的判別和分類,以此更好地區分背景,整體上我們的控制效果已經達到了業界領先的水平。技術成果正在進行論文撰寫,數據集也希望後續可以開源。

4. 文案創意生成

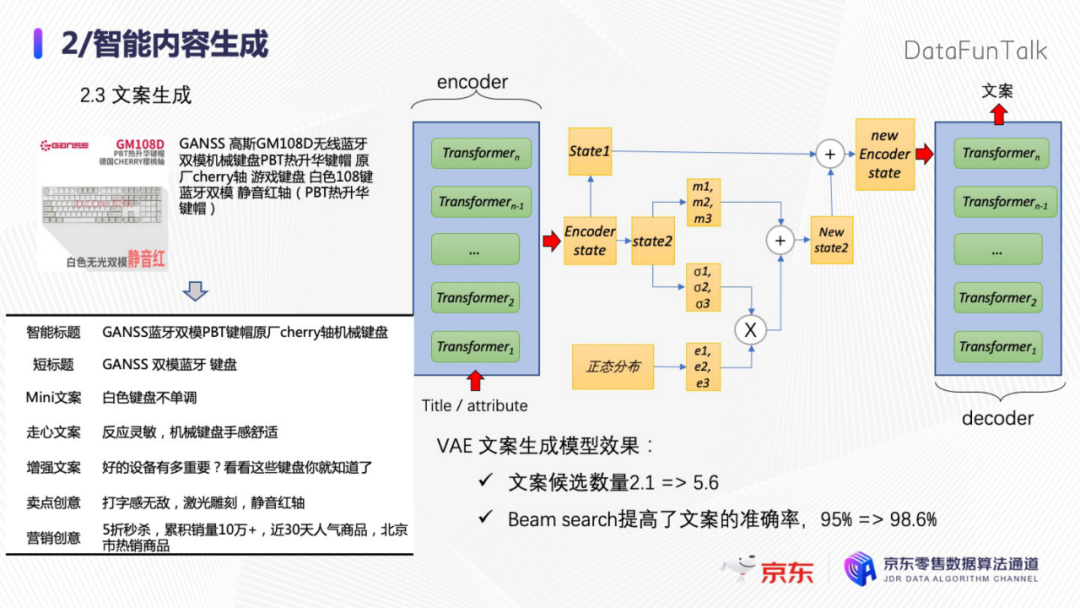

第三個任務場景是文案生成,文案的種類有很多,比如智能標題、短文案、賣點文案、走心文案等,包括使用標題壓縮進行標記生成,也包括基於主圖或商詳進行賣點文案的識別和挖掘後基於圖文結合多模態的方式來進行生成。

主要介紹基於VAE的生成方案,是通過學習達人撰寫的優質文案來對不同的SKU生成個性化的文案信息。在傳統Sequence to sequence模型的架構下,為了獲取更強的特征提取能力,將編碼和解碼的LSTM和Attention轉化為了Transformer,也借鑒了VAE的方案,在encoder上加入了VAE能力,可以增加文案的多樣性。同時在decoder端,我們是由之前的核採樣轉化成了Beam search,在多樣性上有一些提升。業務應用例如生成的Mini文案,在推薦位上也取得了顯著的效果提升。

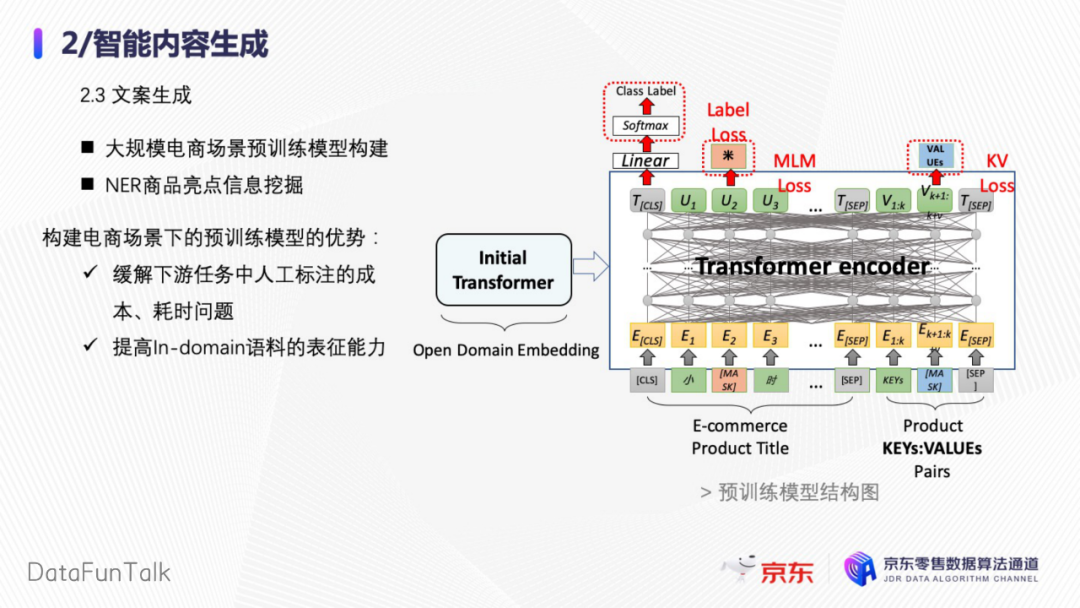

為了支持文案生成能力,我們做了大量的底層工作,包括大規模電商場景下的預訓練模型構建,以及基於NER的商品亮點信息挖掘等。重點介紹預訓練模型,基於兩億規模的數據進行了預訓練,可以更好地對商品進行表示,用於支持模型優選和各類下游任務。其中改進點有幾個:

- 第一,在Bert原本的預訓練任務中去除了效果不太好的NSP的任務;

- 第二,加入了商品自帶的類目信息;

- 第三,加入了一些Weak Label,就是一些結構化的信息作為loss判別。

效果是在下游的NER任務中,以原始的Bert作為baseline,準確度提高了1.5%,達到同樣的一個效果每個類目需要的標註數據量也由原來的10000降低到了6000。

--

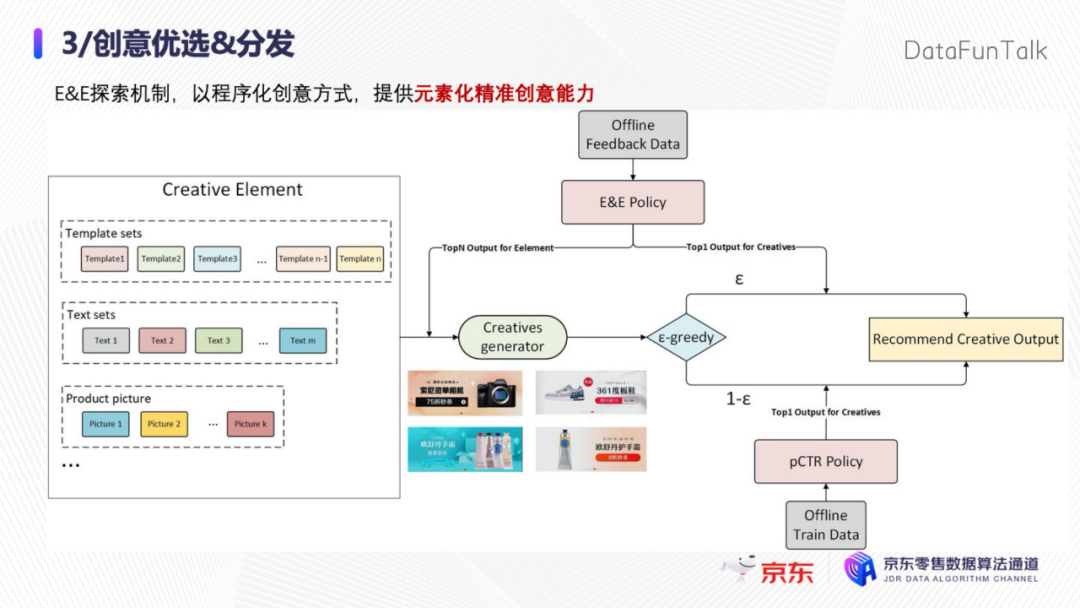

04 創意優選&分發

前面簡單提到了優選模型,優選模型要解決什麼問題?

- 第一是精準匹配的問題

- 第二是解決長尾和多樣性

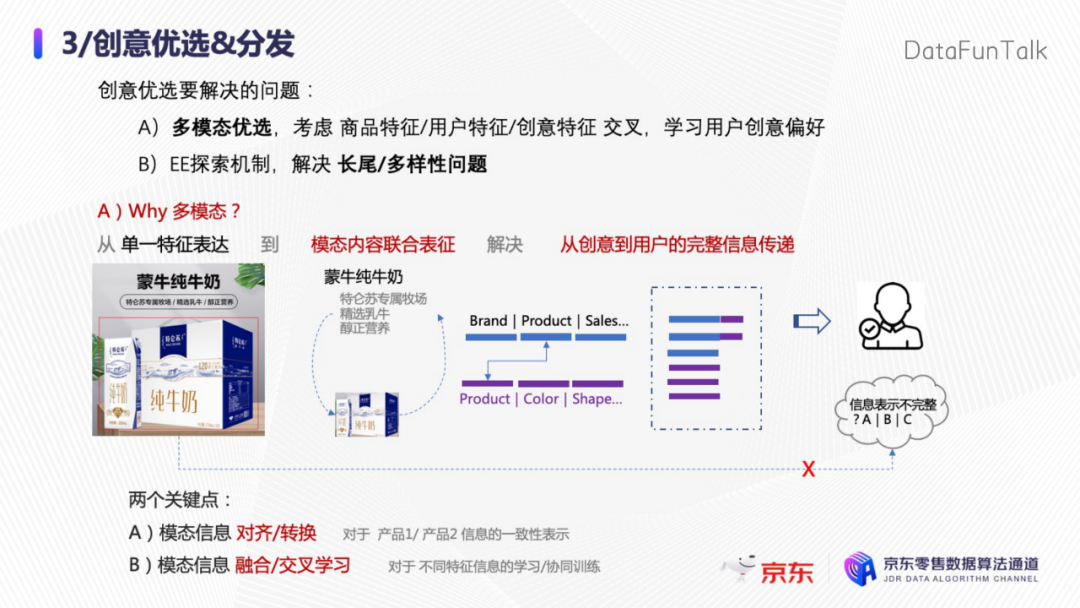

如何解決個性化匹配的問題,我們用到的是多模態的優選,因為優選模型可以充分學習商品特征、用戶特征和創意特征之間的交叉,從而學習到用戶對於創意的偏好,解決多樣性,我們採用了一個EE的探索機制的方案。

1. 多模態優選模型

為什麼要在電商場景下去做多模態?如上圖,智能創意本身是一個多模態的場景,基於單一的圖片表示很難對用戶形成完整的信息傳遞,也就是說模型對於創意信息的理解是不完整的,比如只看文案,就無法get到商品的外觀信息,只看圖片也很難get到它的具體賣點。通過兩個模態間的對齊和校準,可以形成模態內容的聯合表示,可以有效實現從創意到用戶完整的信息傳遞路徑。有兩個關鍵點:

- 第一是對於模態的對齊和轉換;

- 第二是如何對模態信息進行融合和交叉學習,將不同模態的特征做交叉組合來統一,便於進行後續的訓練。

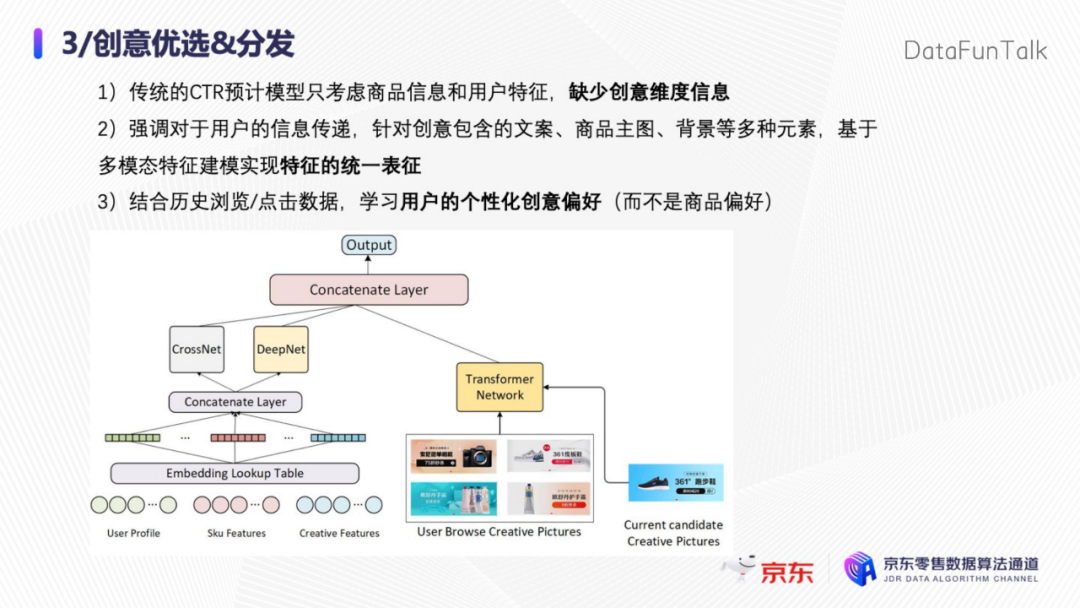

上圖是我們構建的優選模型,在建模的時候,首先考慮的是如何基於用戶的歷史行為建立用戶對於創意的偏好,體現為以下幾點:

- 第一是傳統的CTR預估模型,只考慮了商品和用戶的特征,並沒有考慮創意維度的信息;

- 第二是要強調對於用戶的信息傳遞,針對創意包含文案、圖片、背景等多種元素的情況,可以基於多模態特征建模來實現特征的統一;

- 第三是結合歷史的瀏覽和點擊數據,去學慣用戶個性化的創意偏好,而不是僅僅學慣用戶對於商品的偏好。

結構圖左邊是一個簡單的DCN模型,是大家熟悉的Widedeep表示,右邊是加入了Transformer的網路來對於創意特征進行表徵,然後在此基礎上和原來的信息做Content。

2. 模型的EE能力

優選模型的第二部分體現的是EE能力,EE是指探索(explore)和利用(exploit)。針對創意元素的組合EE模型分為兩部分,第一部分是按照ξ做按比例的探索,被稱為探索流量,探索流量保證了創意元素集的充分曝光。下麵1-ξ這部分是按照pCTR預估的方式進行優選,在前面元素充分曝光的基礎上,可以得到更置信的元素的CTR預估,在這個基礎上可以將創意特征加入優選模型來實現模型到用戶的個性化匹配能力。所以說上面主要是探索的部分,下麵主要是效果呈現的部分。

--

05 業務落地

最後是業務落地的情況,目前創意內容生成及優選已經線上上進行了長期運行。

第一,我們現在的內容生成和分發已經全面覆蓋了像首焦、搜推、站外等核心廣告位,每天智能生成的視頻、圖片、文案創意已經超過了數億條,可以觸達千萬級的用戶,並且我們獲得了京東技術金項獎-技術創新獎。

第二,構建了視頻標簽化為基礎的視頻廣告生態,智能創意在視頻上也影響了大量廣告收入,包含了站內的搜索、推薦,站外的抖音、快手等,在站外也有大量的廣告投放。

第三,關於效果,以站內的首焦業務為例,我們建立的創意內容和優選體系近一年點擊率提升已經超過了30%。

最後是智能創意的產品化、工具化和平臺化建設,已經全面融入了京東廣告的生態,持續賦能電商業務。

--

06 精彩問答

Q:美學評估具體是怎麼實現的?

A:傳統意義上,大家理解圖片的美醜是通過比較主觀的判別去給一個label標註的。比如一張圖片,A打到八分,B能打到十分,基於多人的打分歸集到一塊,在這個基礎上通過標註數據做分佈的預估來判斷標註的置信度,比如80%的人都認為圖片的美學在五到六分之間,這個數據其實就是我們用於後續訓練的一個數據集。這是關於數據建立的過程,評價體系分為多個方面,一個是Hamony值評估顏色的和諧度,看幾個顏色放在一起是不是協調,得到一個和諧分。其次是基於規則的佈局合理性得分,最後有線上特征feature的加入,例如可以把CTR的數據引入進來,加入到整體的質量判別中。

Q:文案生成是直接用於投放嗎?如何保證不會出現生成的文案賣點與商品不一致?

A:我們整個內容生成都是直接用於投放的。不管是文案生成或是圖片、視頻生成,可能都會面臨你說的問題,也就是badcase,同時還有商家自己上傳圖片或者填文件出錯的情況,所以準確率本身是很難去避免的。我們在生成文案時的準確率能達到98%甚至99%,它本身的badcase率很小;其次在這個解決方案,我們會通過線上實時反饋等方式,實現實時的禁播,把這個部分的文案卡掉。

Q:組件化的圖片生成是完全靠UED提供組合規則嗎?

A:組件化的方式生成,我們肯定會把UED同學給引入進來。為什麼要做文字組件這個事情?一是方便我們把圖片序列化分成N個部分,文字組件可以通過智能佈局的調整,智能顏色搭配去適應不同的場景。但不是針對每一類創意,都需要UED同學去生成一套模板,這樣效率是非常難以保證的。我們加入智能搭配,智能佈局,或者智能文案形式的調整後,UED只需給到我們一個最簡單的小組件,我們可以把它擴展成更多的組件,可以適應更多的文案形式,可以更多在元素之間做佈局,整體上是為了提升方案的多樣性。

Q:對於類似場景分類這樣的應用,標簽體系是業務同學直接提供的,還是由演算法使用了什麼方法來進行歸納總結的?如果是後者,那麼如何權衡使用什麼樣的標簽體系?

A:標簽體系特別複雜,標簽體系cover的角度會比較多,比如說圖片里,要去判斷圖片的場景,比如說它是在街上還是家裡。這個場景的定義是我們演算法自己去定義的,因為電商場景下有大量的視頻和圖片,我們會在收集這些視頻和圖片內容後,通過標註同學去做場景的標註,然後標註的內容,我們會和相關同學做by case的前期的一些溝通來建立,所以這個過程的前期有非常龐大和繁瑣的工作。

Q:可以詳細介紹一下多模態在精排模型中的應用細節嗎?

A:我們現在做的多模態部分主要是在優選過程中使用,現在還沒有在精排模型中去做。具體原因,對於我們來講,優選模型是對每一個商品,它會選擇一個對於當前用戶最好的創意或者最好的內容。精排模型,它要解決的是怎麼樣去選擇用戶最感興趣的一個SKU,現在我們的思路是這兩個過程並行,就是優選創意內容和優選商品其實是獨立的。我們的實時生成、優選引擎,過程可以控制在20毫秒以內,精排模型本身對耗時的要求也比較高,比如你再增加20毫秒,這會有很大的挑戰,所以這個過程我們更傾向於通過並行的方式去做。

Q:創意優選的離線評估指標是什麼?

A:和精排模型的評估指標一致,我們用AUC去評估它的效果增益,比如加入創意內容的一個特征後,或者加入文案、圖片的一個embedding信息後,評估AUC能得到多大的增益。然後在這個基礎上,評估對生意提升超過5‰或者多少,然後我們就會放到線上去做實際的線上ABtest。

Q:請問在商戶選擇上是白盒還是黑盒,能否規模化使用?

A:現在做的是自動化的智能創意投放場景,對於商家來講其實是無感知的,他們能感知到的就是效果變好了,不知道他選擇了智能創意。但是後面我們會有一個產品化的思考,就是讓商家去選擇我們的智能創意,在選擇使用後看到效果變好。目前對於大多數的商家來講,它是無感知的,是在純智能投放的一個場景下,自動選擇商品,自動選擇用戶進行匹配的全智能的pipeline。但是該能力主要覆蓋的是中小商家,對於頭部KA商家,他們有足夠的素材製作能力,所以對於他們主要使用的是其中創意分發的能力。

Q:創意優選和分發做到創意維度,這麼大量的創意如何有足夠的流量意義?用了EE的方法,那麼ξ是如何選取的?如果意義流量足夠了,是否能把ξ設置為零?

A:創意的特征和商品的特征其實有很大差異。創意特征,比如一個商品裡面有特別多的賣點,它有特別多的圖片,比如一個相機,它的正面或者背面,要展現的內容包含它的攝像效果、顏值等等,針對這些信息,怎麼保證每一個效果的充分展現和置信度?我們要按照ξ去進行展示,但這個展示保留了比如說10%或者20%,是為了保證有效展現,但是我們即使在這個模型預估完成以後,也不會把ξ系統調整為零,因為創意優選的過程中,創意和商品的信息會變化,這是從商品層面去看,它會有更新,然後從用戶層面看,其實也會有創意衰減的問題,比如每個人都有不同的喜好,而且比如我今天喜歡看綠色的創意,明天也會審美疲勞。所以探索就是要匹配用戶的興趣度變化,去不斷迭代探索。所以EE探索是一個長期的過程,它是和CTR預估分支一起發生作用的。

Q:做創意優選的目的是什麼,實際的線上效果如何?

A:做優選的核心目的肯定是提升創意的效果,通過和用戶喜好的匹配來實現這種個性化也就是千人千面的對比映射,最終能夠體現給商家看到的就是點擊率,或者轉化效果的提升。對於用戶則是看到的他比較喜歡的創意展現,提升他對於這個平臺的喜好,他覺得推給他的很好,他會在這個平臺上花更多時間去看去逛,這會提升平臺整體的用戶活躍度,或者是用戶停留時長。所以我們通過創意生態要構建這兩方面的目的,一個是對於商家的,一個是對於用戶的。

今天的分享就到這裡,謝謝大家。

分享嘉賓:

本文首發於微信公眾號“DataFunTalk”。