一、安裝JDK8 【溫馨提示】這裡使用jdk8,這裡不要用其他jdk了,可能會出現一些其他問題的,我用jdk11有些包就找不到,好像jdk9都不行 1)JDK下載地址 http://www.oracle.com/technetwork/java/javase/downloads/index.html ...

目錄

- 一、安裝JDK8

- 二、Hadoop安裝(window10環境)

- 三、Hive安裝(window10環境)

一、安裝JDK8

【溫馨提示】這裡使用jdk8,這裡不要用其他jdk了,可能會出現一些其他問題的,我用jdk11有些包就找不到,好像jdk9都不行

1)JDK下載地址

http://www.oracle.com/technetwork/java/javase/downloads/index.html

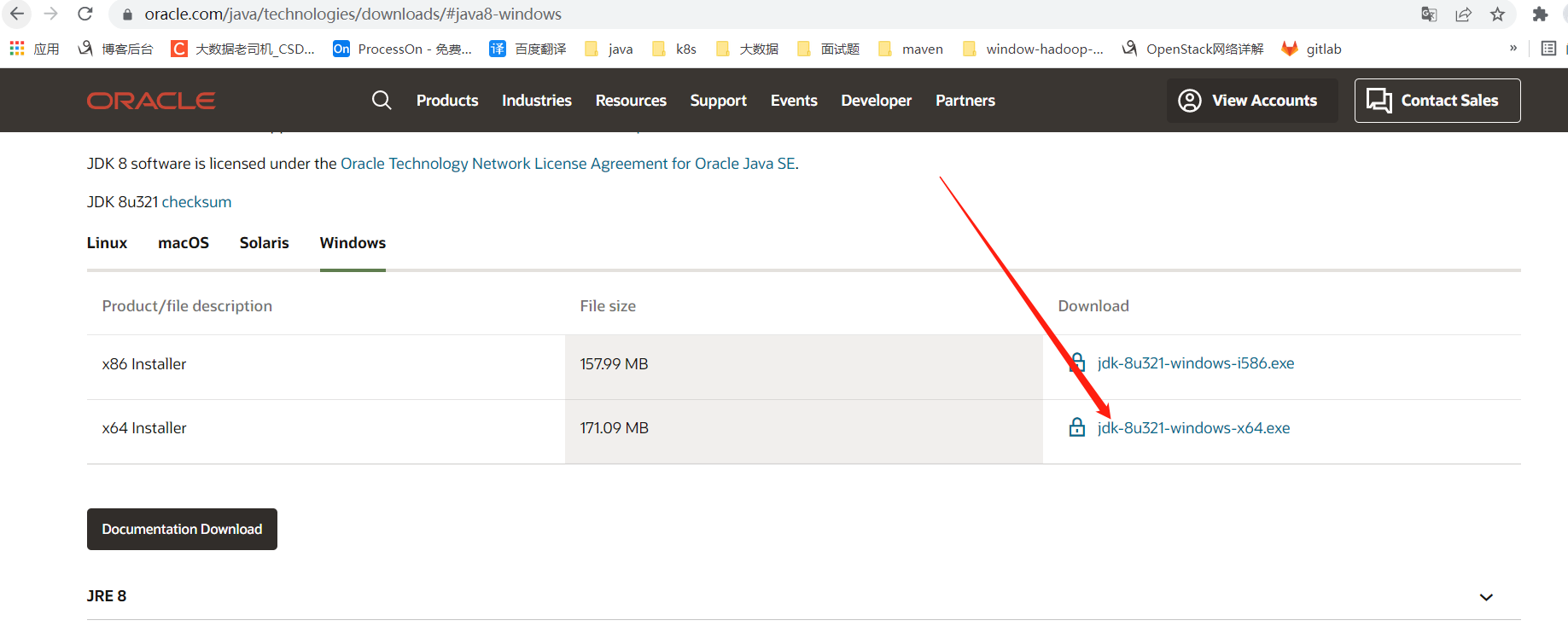

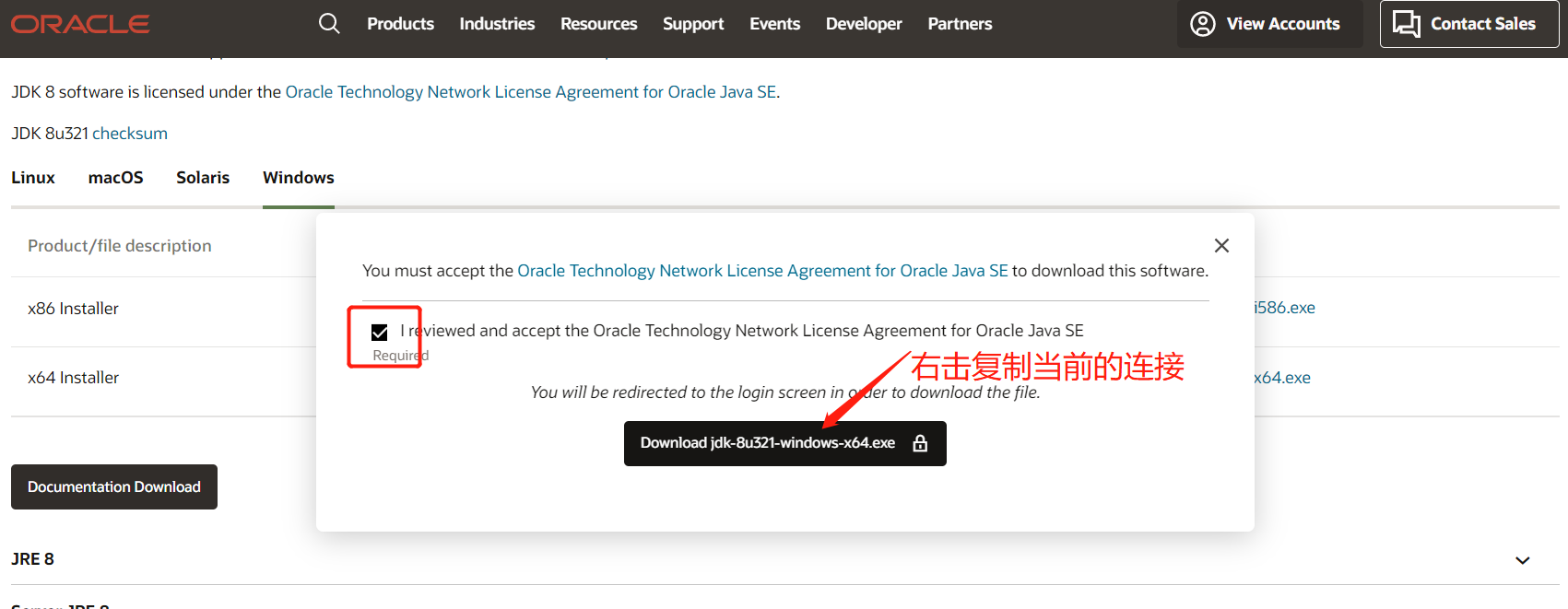

按正常下載是需要先登錄的,這裡提供一個不用登錄下載的方法

連接如下:https://www.oracle.com/webapps/redirect/signon?nexturl=https://download.oracle.com/

otn/java/jdk/8u321-b07/df5ad55fdd604472a86a45a217032c7d/jdk-8u321-windows-x64.exe

其實只要後半部分,再把標紅的otn換成otn-pub就可以直接下載了

下載完後就是傻瓜式安裝了

2)設置環境變數

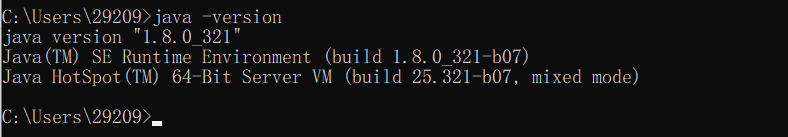

3)驗證

$ java -version

二、Hadoop安裝(window10環境)

1)下載Hadoop3.1.3

官網下載:https://hadoop.apache.org/release/3.1.3.html

下載各種版本地址入口:https://hadoop.apache.org/release.html

下載地址:https://archive.apache.org/dist/hadoop/common/hadoop-3.1.3/hadoop-3.1.3.tar.gz

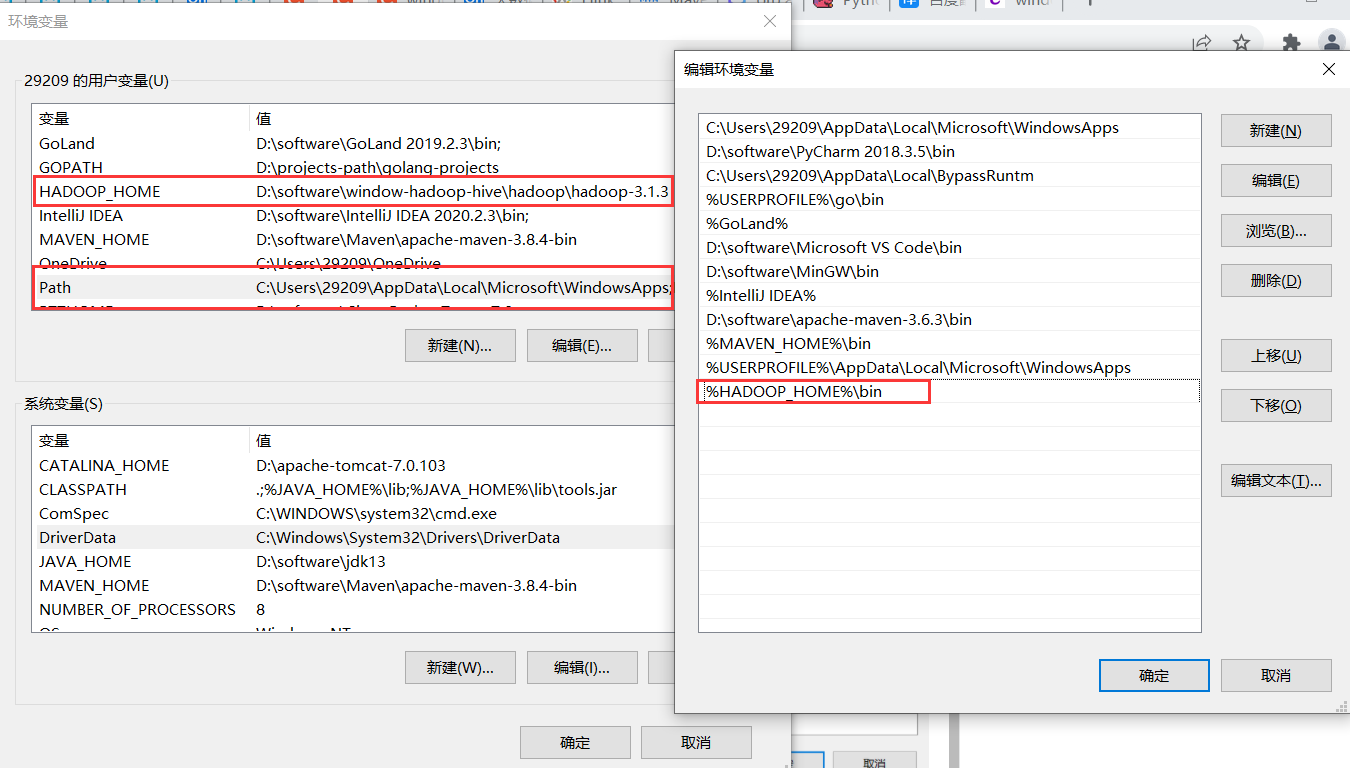

2)Hadoop配置環境變數

- HADOOP_HOME

驗證

$ hadoop --version

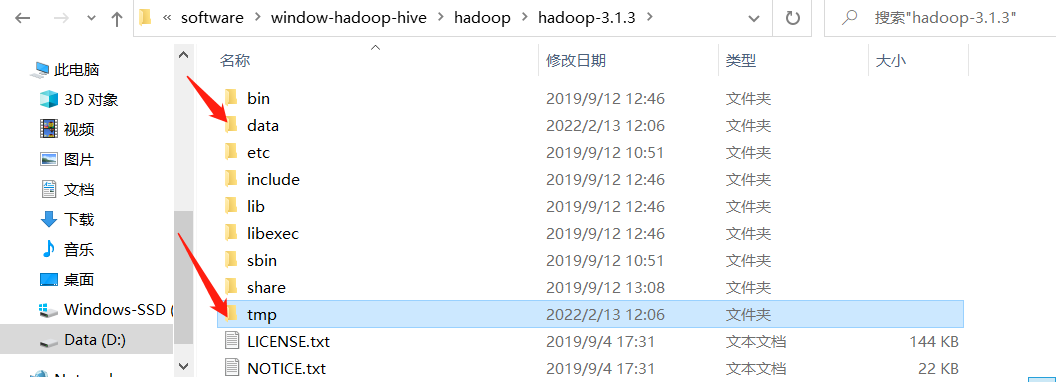

3)在hadoop解壓目錄下創建相關目錄

- 創建

data和tmp目錄

- 然後在

data文件夾下麵再創建namenode和datanode目錄

4)修改Hadoop配置文件

配置文件目錄:$HADOOP_HOME\etc\hadoop

1、core-site.xml文件:添加以下配置

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

2、hdfs-site.xml文件:添加以下配置,路徑改成自己的安裝路徑

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/D:/software/window-hadoop-hive/hadoop/hadoop-3.1.3/data/namenode</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/D:/software/window-hadoop-hive/hadoop/hadoop-3.1.3/data/datanode</value>

</property>

</configuration>

3、mapred-site.xml文件:添加以下配置

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

4、yarn-site.xml文件:添加以下配置

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>1024</value>

</property>

<property>

<name>yarn.nodemanager.resource.cpu-vcores</name>

<value>1</value>

</property>

</configuration>

5)格式化節點

$ hdfs namenode -format

6)替換文件

1、替換bin目錄下文件(winutils)

打開winutils文件,把裡面的bin文件複製到hadoop的安裝路徑,替換掉原來的bin文件

下載:apache-hadoop-3.1.0-winutils

也可以去GitHub上下載其它對應版本

當然如果自己有時間也有興趣的話,可以自己去編譯

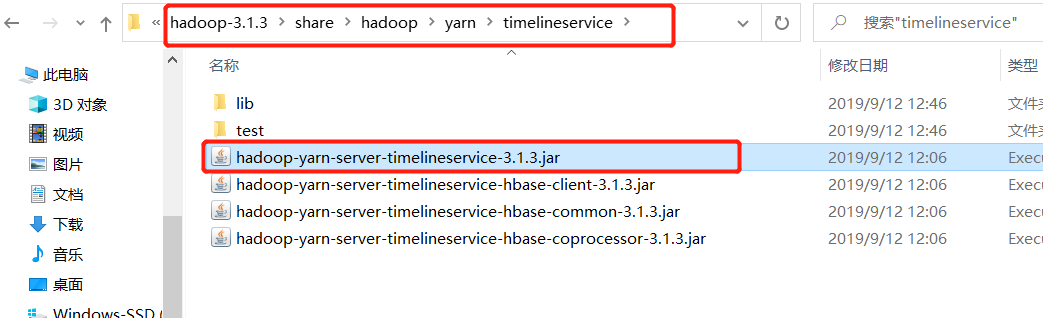

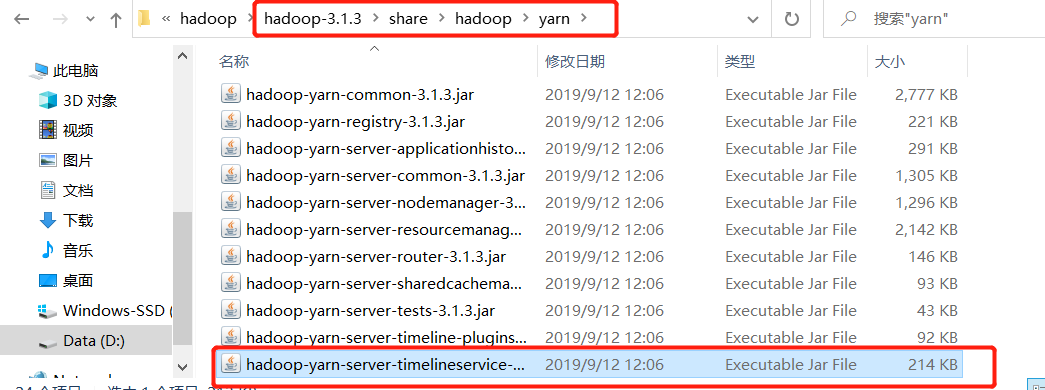

2、按照路徑找到圖中該文件

把它複製到上一級目錄,即

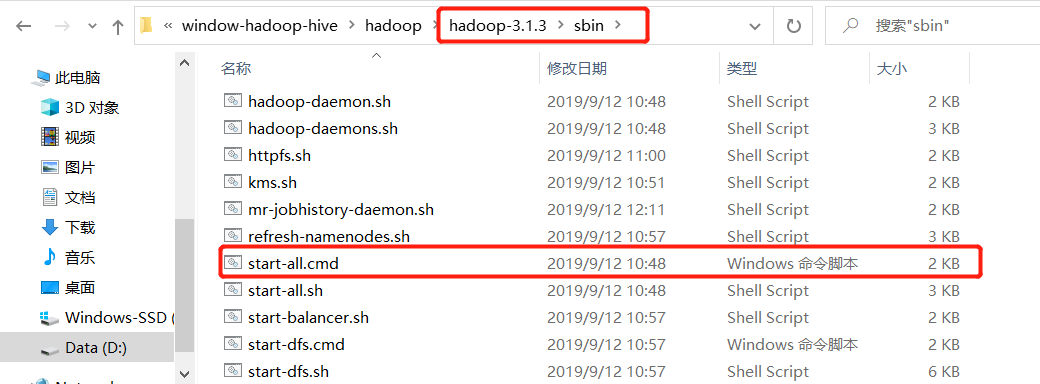

7)運行

【溫馨提示】回到hadoop安裝bin目錄下,右擊

以管理員的身份運行start-all.cmd文件,要不然會報許可權問題

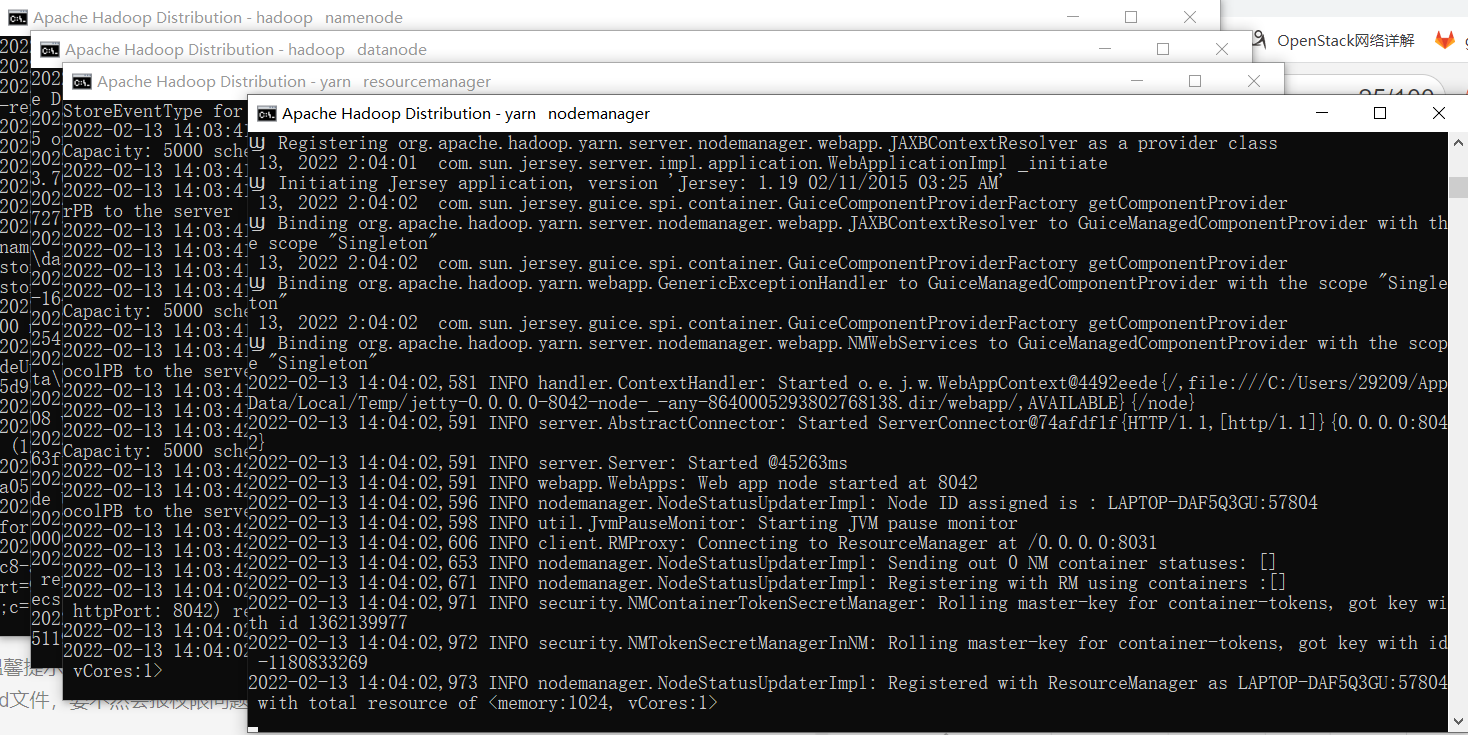

出現下麵四個視窗就是 成功了,註意每個視窗標題的後面的名稱,比如yarn nodemanager,如果沒有出現則是失敗

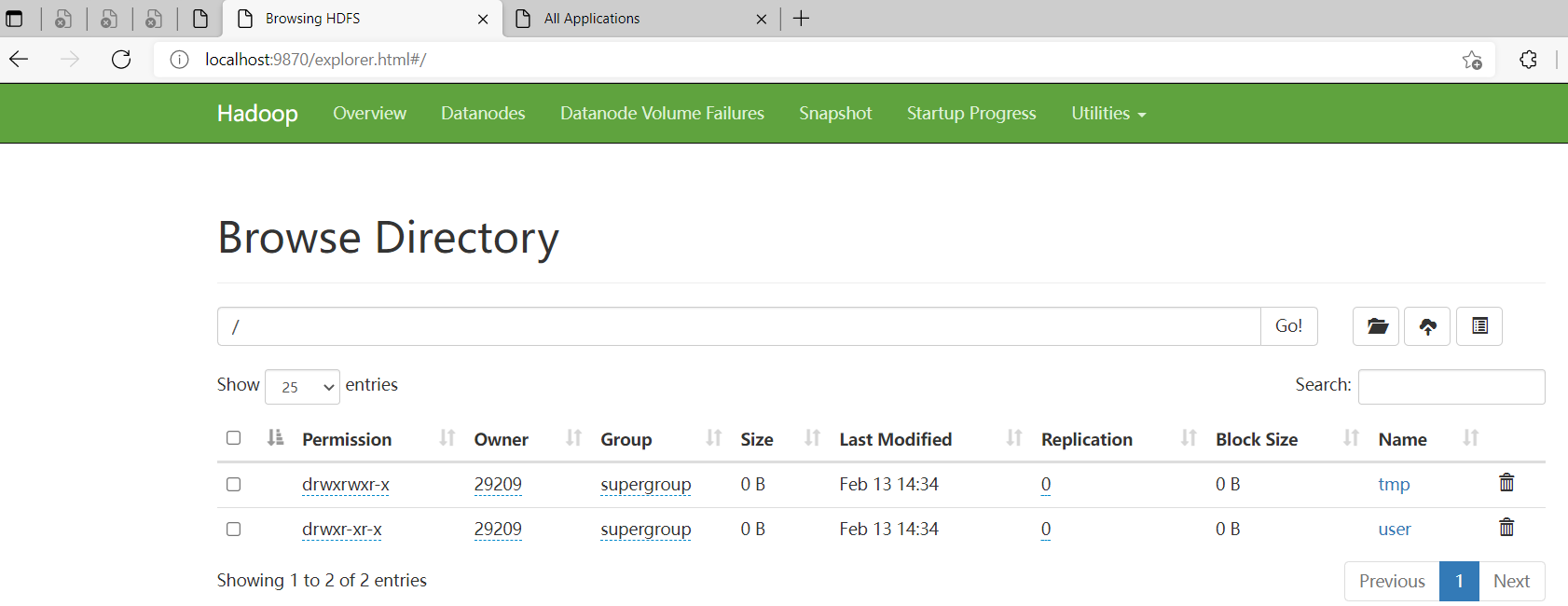

8)驗證

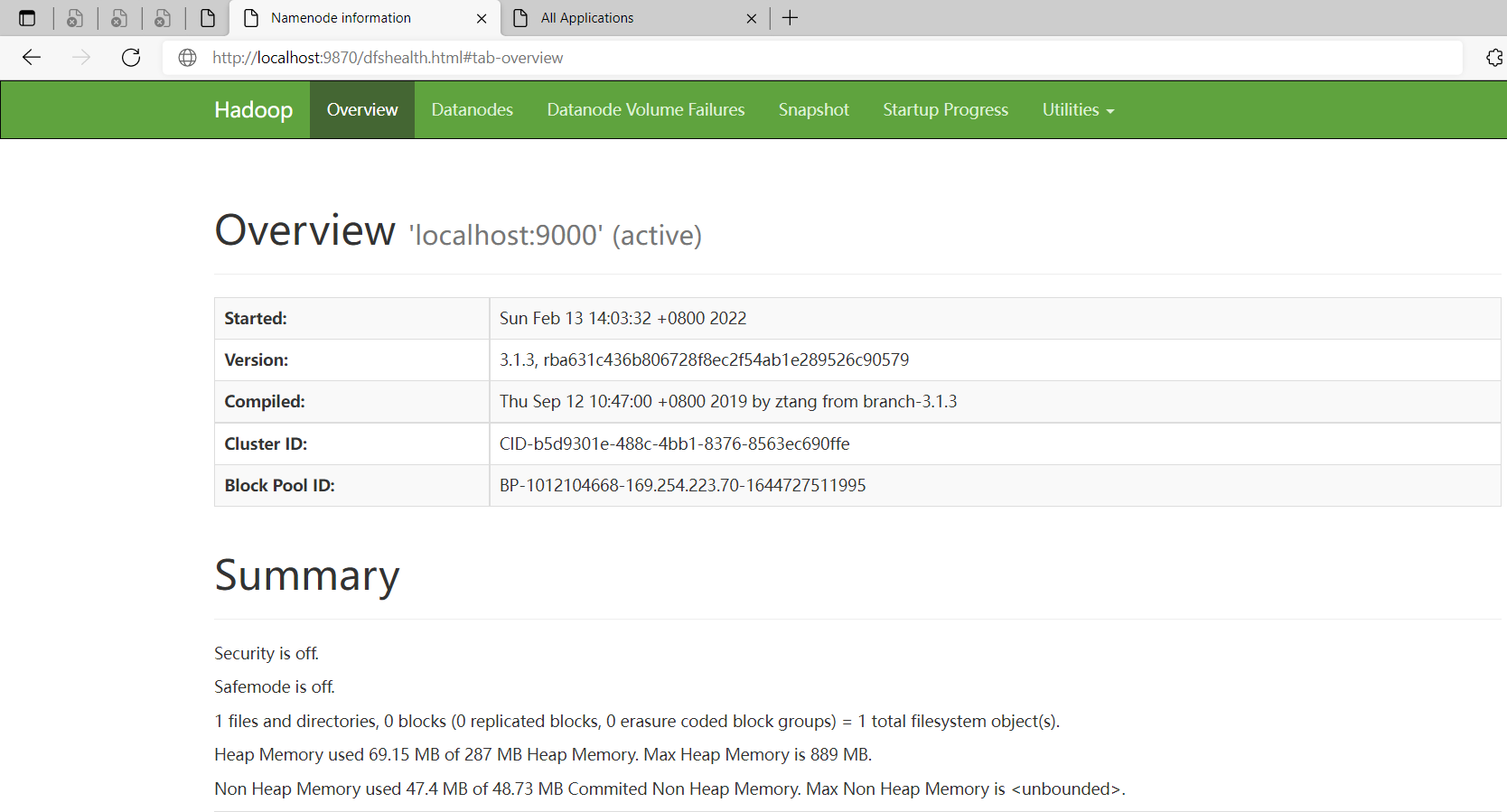

hdfs web 地址:http://localhost:9870/

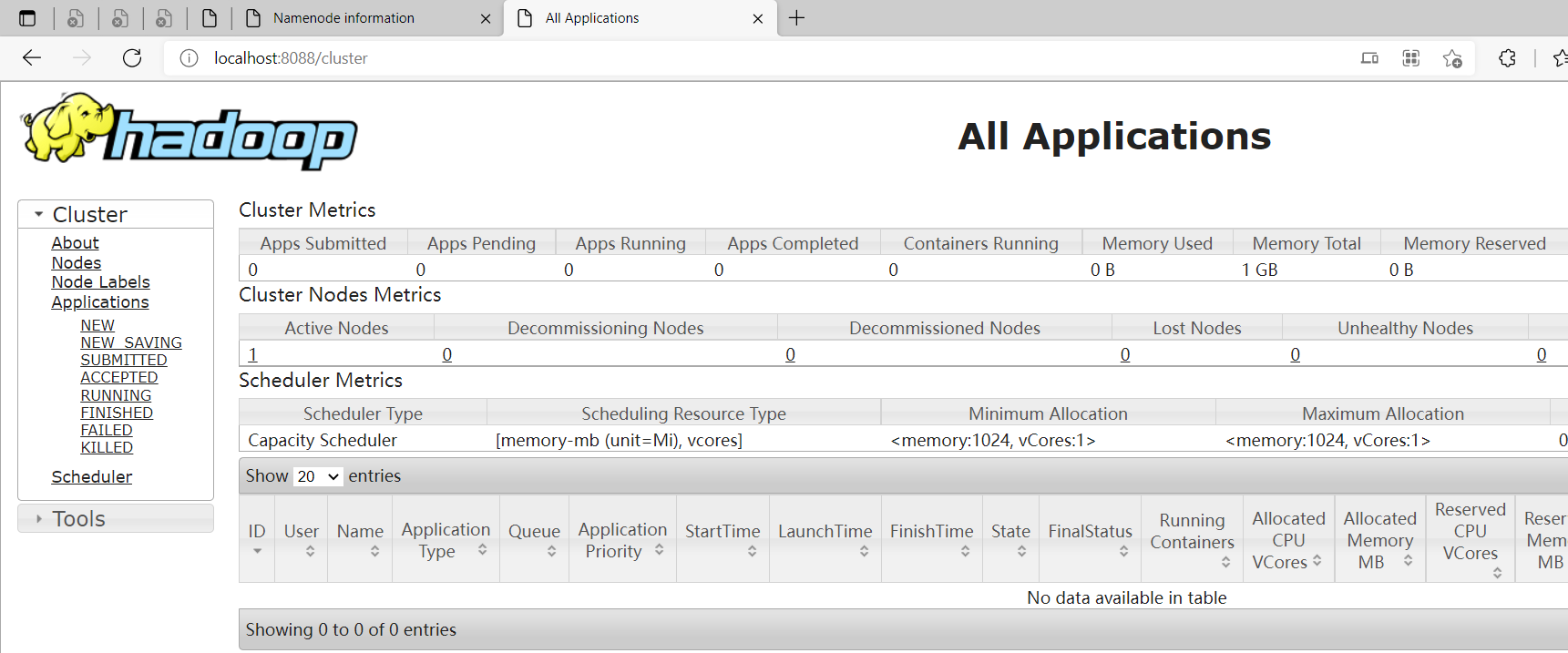

yarn web 地址:http://localhost:8088/

到此為止window版本的hadoop就安裝成功了

三、Hive安裝(window10環境)

1)下載Hive

各版本下載地址:http://archive.apache.org/dist/hive

這選擇最新版本

hive 3.1.2版本下載地址:http://archive.apache.org/dist/hive/hive-3.1.2/apache-hive-3.1.2-bin.tar.gz

2)Hive配置環境變數

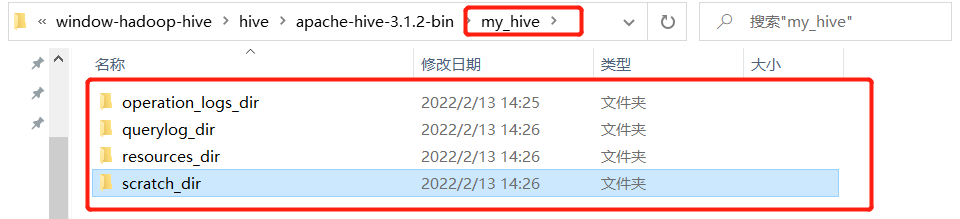

3)新建本地目錄(後面配置文件會用到)

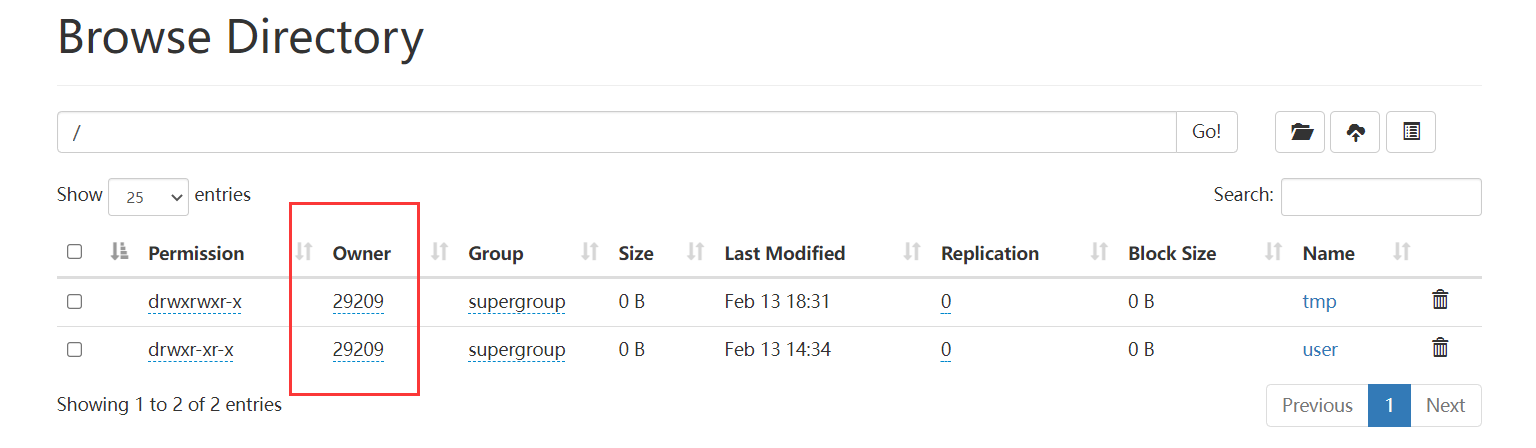

4)在hadoop上創建hdfs目錄(後面配置文件會用到)

$ hadoop fs -mkdir /tmp

$ hadoop fs -mkdir /user/

$ hadoop fs -mkdir /user/hive/

$ hadoop fs -mkdir /user/hive/warehouse

$ hadoop fs -chmod g+w /tmp

$ hadoop fs -chmod g+w /user/hive/warehouse

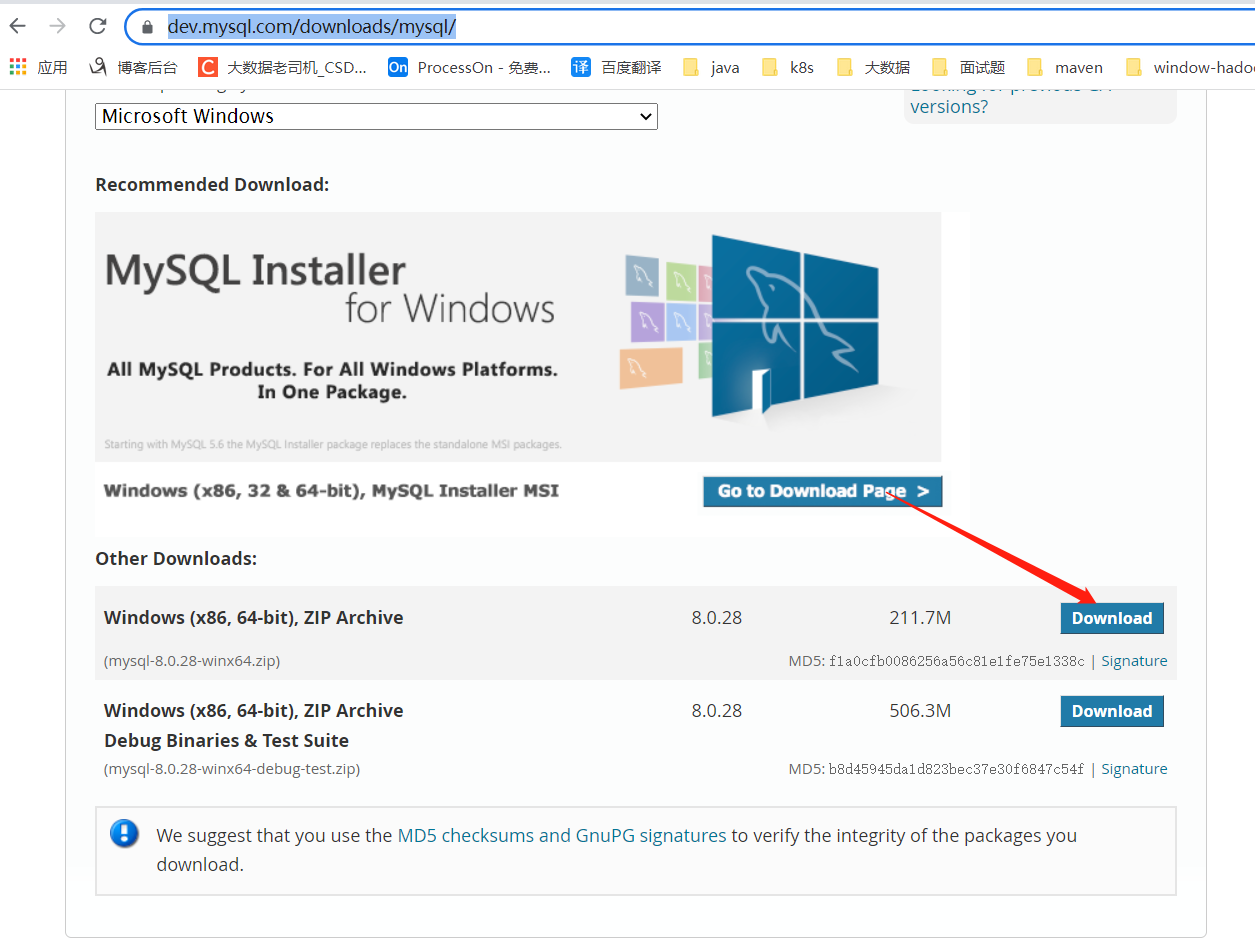

5)安裝mysql8.x

1、下載mysql

官網下載:https://dev.mysql.com/downloads/mysql/

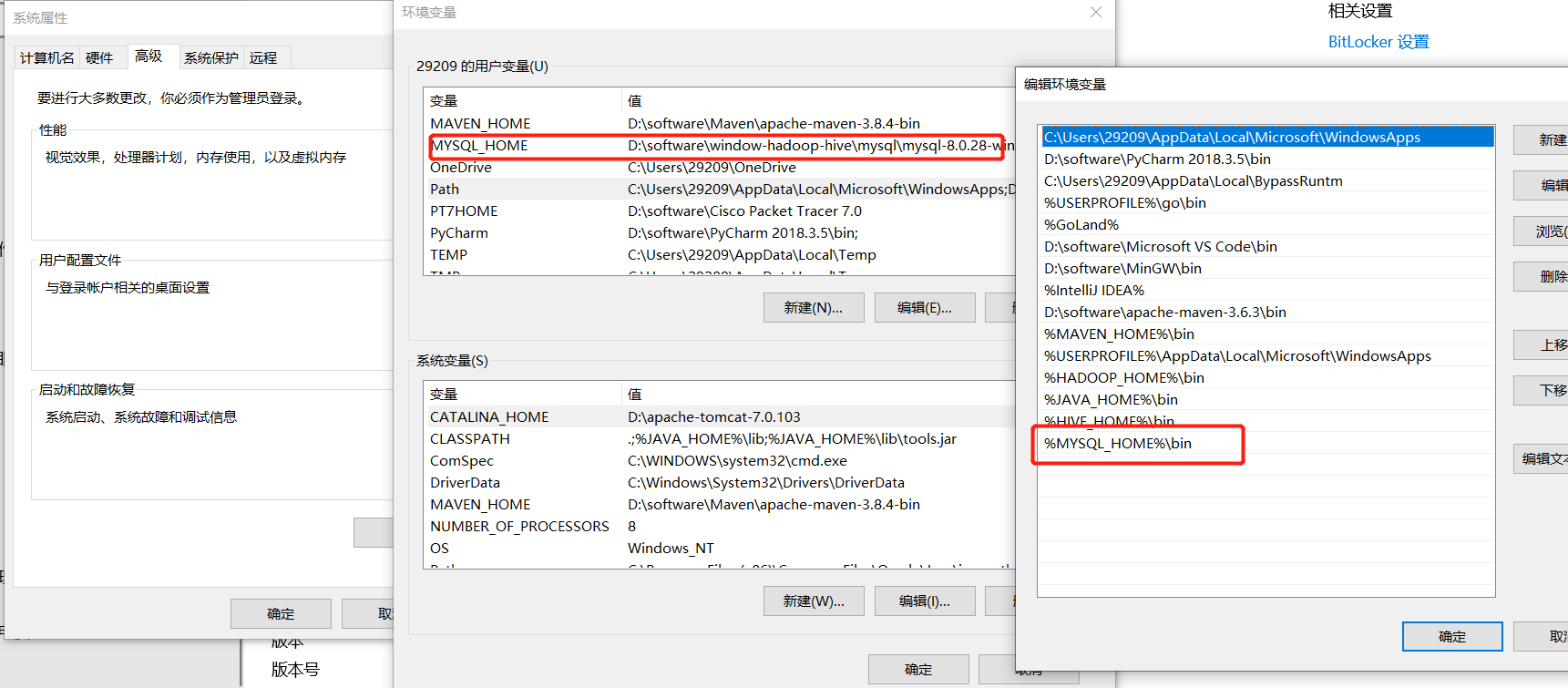

2、配置mysql環境變數

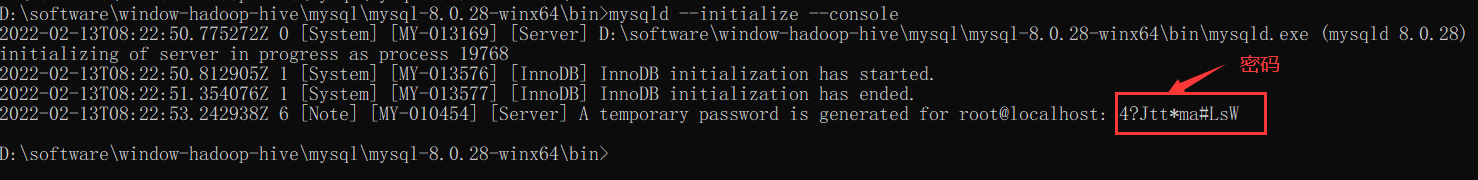

3、初始化mysql

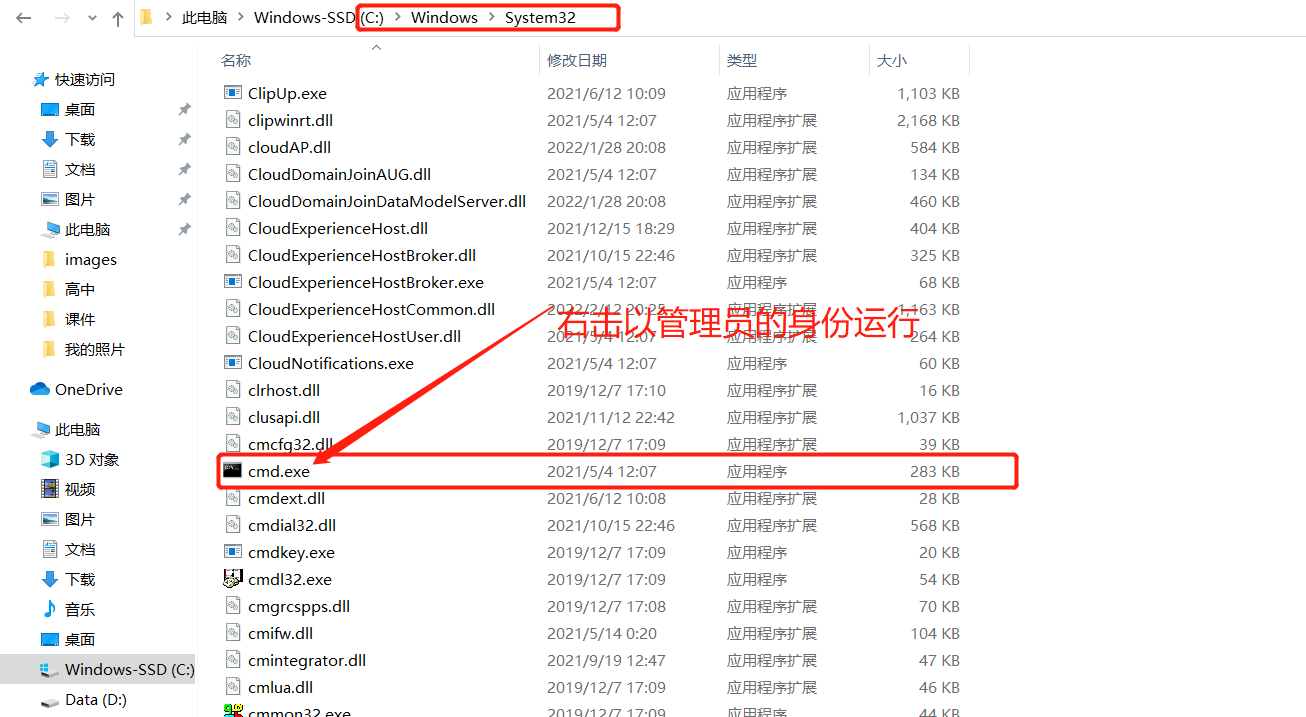

【溫馨提示】右鍵以管理員身份運行cmd,否則在安裝時會報許可權的錯,會導致安裝失敗的情況。

# 切換到mysql bin目錄下執行

# cd D:\software\window-hadoop-hive\mysql\mysql-8.0.28-winx64\bin

# d:

$ mysqld --initialize --console

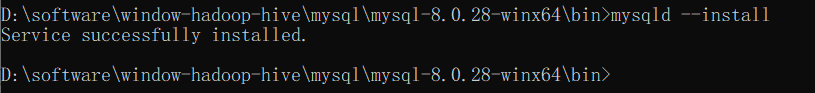

4、安裝mysql服務

$ mysqld --install mysql

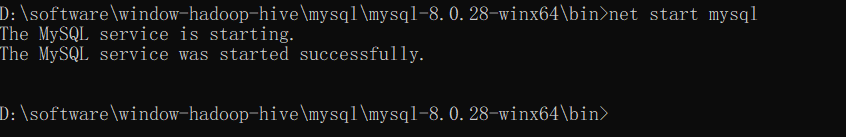

6、通過命令啟動服務

$ net start mysql

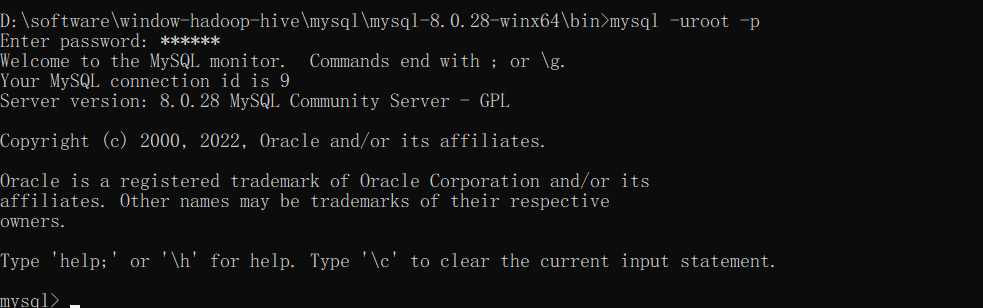

7、通過mysql客戶端登錄驗證並修改root密碼

$ mysql -uroot -p

#輸入上面初始化的密碼

8、重置mysql root密碼(命令行都要以管理員運行 )

- 停止mysql服務

$ net stop mysql

- 啟動MySQL服務的時候跳過許可權表認證

$ mysqld --console --skip-grant-tables --shared-memory

- 在新開的命令行中執行

mysql

【溫馨提示】由於上面的命令行被mysql的服務給占用,我們得重新開啟一個新的命令行

$ mysql

- 將root用戶的密碼清空

$ update user set authentication_string = '' where user='root' ;

- quit 退出,然後在之前的命令行將我們開啟的mysql服務停止掉(Ctrl+C或者關閉命令行),然後執行

net start mysql重新啟動mysql服務

$ net start mysql

- 在我們之後開啟的命令行中輸入

mysql -uroot -p然後按enter鍵,輸入密碼繼續按enter鍵(這裡密碼已經被清空)

$ mysql -uroot -p

- 修改密碼

ALTER USER 'root'@'localhost' IDENTIFIED BY '123456';

FLUSH PRIVILEGES;

【問題】如果mysql工具出現錯誤:

Authentication plugin 'caching_sha2_password' cannot be loaded

【原因】

很多用戶在使用Navicat Premium 12連接MySQL資料庫時會出現Authentication plugin 'caching_sha2_password' cannot be loaded的錯誤。

出現這個原因是mysql8 之前的版本中加密規則是mysql_native_password,而在mysql8之後,加密規則是caching_sha2_password, 解決問題方法有兩種,一種是升級navicat驅動,一種是把mysql用戶登錄密碼加密規則還原成mysql_native_password.

【解決】

# 管理員許可權運行命令

ALTER USER 'root'@'localhost' IDENTIFIED BY '123456';

ALTER USER 'root'@'localhost' IDENTIFIED WITH mysql_native_password BY '123456';

FLUSH PRIVILEGES;

- 退出後,使用新密碼登錄

$ mysql -uroot -p

6)修改Hive 配置文件

配置文件目錄D:\software\window-hadoop-hive\hive\apache-hive-3.1.2-bin\conf有4個預設的配置文件模板拷貝成新的文件名

hive-default.xml.template----->hive-site.xml

hive-env.sh.template----->hive-env.sh

hive-exec-log4j.properties.template----->hive-exec-log4j2.properties

hive-log4j.properties.template----->hive-log4j2.properties

1、hive-site.xml 文件:配置文件內容如下

<?xml version="1.0" encoding="UTF-8" standalone="no"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?><!--

Licensed to the Apache Software Foundation (ASF) under one or more

contributor license agreements. See the NOTICE file distributed with

this work for additional information regarding copyright ownership.

The ASF licenses this file to You under the Apache License, Version 2.0

(the "License"); you may not use this file except in compliance with

the License. You may obtain a copy of the License at

http://www.apache.org/licenses/LICENSE-2.0

Unless required by applicable law or agreed to in writing, software

distributed under the License is distributed on an "AS IS" BASIS,

WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

See the License for the specific language governing permissions and

limitations under the License.

--><configuration>

<!--hive的臨時數據目錄,指定的位置在hdfs上的目錄-->

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/user/hive/warehouse</value>

<description>location of default database for the warehouse</description>

</property>

<!--hive的臨時數據目錄,指定的位置在hdfs上的目錄-->

<property>

<name>hive.exec.scratchdir</name>

<value>/tmp/hive</value>

<description>HDFS root scratch dir for Hive jobs which gets created with write all (733) permission. For each connecting user, an HDFS scratch dir: ${hive.exec.scratchdir}/<username> is created, with ${hive.scratch.dir.permission}.</description>

</property>

<!-- scratchdir 本地目錄 -->

<property>

<name>hive.exec.local.scratchdir</name>

<value>D:/software/window-hadoop-hive/hive/apache-hive-3.1.2-bin/my_hive/scratch_dir</value>

<description>Local scratch space for Hive jobs</description>

</property>

<!-- resources_dir 本地目錄 -->

<property>

<name>hive.downloaded.resources.dir</name>

<value>D:/software/window-hadoop-hive/hive/apache-hive-3.1.2-bin/my_hive/resources_dir/${hive.session.id}_resources</value>

<description>Temporary local directory for added resources in the remote file system.</description>

</property>

<!-- querylog 本地目錄 -->

<property>

<name>hive.querylog.location</name>

<value>D:/software/window-hadoop-hive/hive/apache-hive-3.1.2-bin/my_hive/querylog_dir</value>

<description>Location of Hive run time structured log file</description>

</property>

<!-- operation_logs 本地目錄 -->

<property>

<name>hive.server2.logging.operation.log.location</name>

<value>D:/software/window-hadoop-hive/hive/apache-hive-3.1.2-bin/my_hive/operation_logs_dir</value>

<description>Top level directory where operation logs are stored if logging functionality is enabled</description>

</property>

<!-- 資料庫連接地址配置 -->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/hive?serverTimezone=UTC&useSSL=false&allowPublicKeyRetrieval=true</value>

<description>

JDBC connect string for a JDBC metastore.

</description>

</property>

<!-- 資料庫驅動配置 -->

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.cj.jdbc.Driver</value>

<description>Driver class name for a JDBC metastore</description>

</property>

<!-- 資料庫用戶名 -->

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description>Username to use against metastore database</description>

</property>

<!-- 資料庫訪問密碼 -->

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>123456</value>

<description>password to use against metastore database</description>

</property>

<!-- 解決 Caused by: MetaException(message:Version information not found in metastore. ) -->

<property>

<name>hive.metastore.schema.verification</name>

<value>false</value>

<description>

Enforce metastore schema version consistency.

True: Verify that version information stored in is compatible with one from Hive jars. Also disable automatic

schema migration attempt. Users are required to manually migrate schema after Hive upgrade which ensures

proper metastore schema migration. (Default)

False: Warn if the version information stored in metastore doesn't match with one from in Hive jars.

</description>

</property>

<!-- 自動創建全部 -->

<!-- hive Required table missing : "DBS" in Catalog""Schema" 錯誤 -->

<property>

<name>datanucleus.schema.autoCreateAll</name>

<value>true</value>

<description>Auto creates necessary schema on a startup if one doesn't exist. Set this to false, after creating it once.To enable auto create also set hive.metastore.schema.verification=false. Auto creation is not recommended for production use cases, run schematool command instead.</description>

</property>

</configuration>

2、hive-env.sh 文件:配置文件內容如下

# Set HADOOP_HOME to point to a specific hadoop install directory

export HADOOP_HOME=D:\software\window-hadoop-hive\hadoop\hadoop-3.1.3

# Hive Configuration Directory can be controlled by:

export HIVE_CONF_DIR=D:\software\window-hadoop-hive\hive\apache-hive-3.1.2-bin\conf

# Folder containing extra libraries required for hive compilation/execution can be controlled by:

export HIVE_AUX_JARS_PATH=D:\software\window-hadoop-hive\hive\apache-hive-3.1.2-bin\lib

7)替換bin目錄

【溫馨提示】2.2.0版本之後就不提供cmd相關文件了,所以得去下載apache-hive-2.2.0-src.tar.gz,把這個版本里的bin目錄文件替換到hive安裝bin目錄下。

8)下載mysql-connector-java-*.jar

這裡將mysql-connector-java-*.jar拷貝到安裝目錄lib下

下載地址:https://repo1.maven.org/maven2/mysql/mysql-connector-java/8.0.28/mysql-connector-java-8.0.28.jar

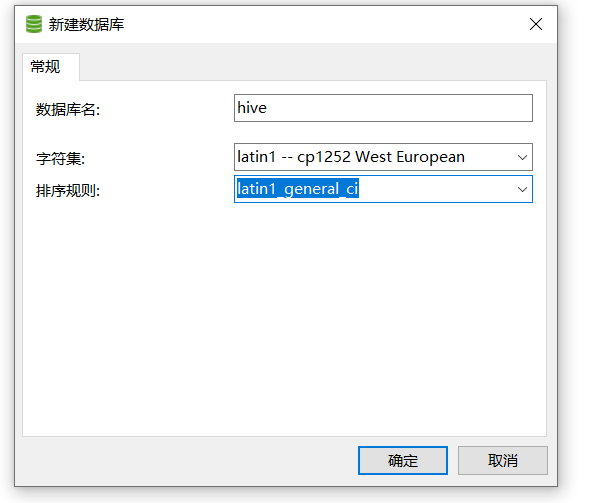

9)創建Hive 初始化依賴的資料庫hive,註意編碼格式:latin1

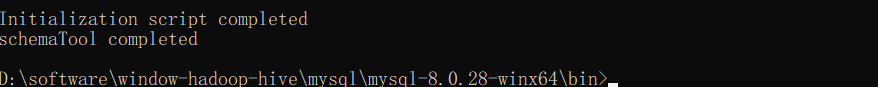

10)Hive 初始化數據

$ hive --service schematool -dbType mysql -initSchema

11)啟動Hive 服務

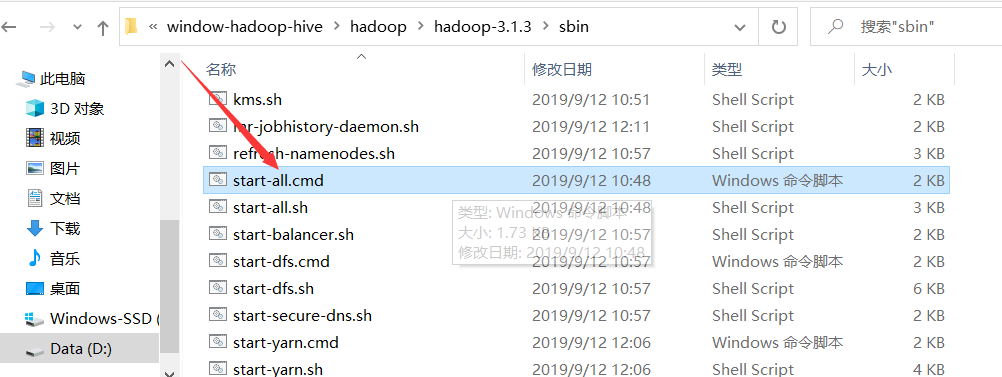

1、首先啟動Hadoop

執行指令:stall-all.cmd,上面其實已經驗證過了,啟動是沒問題的

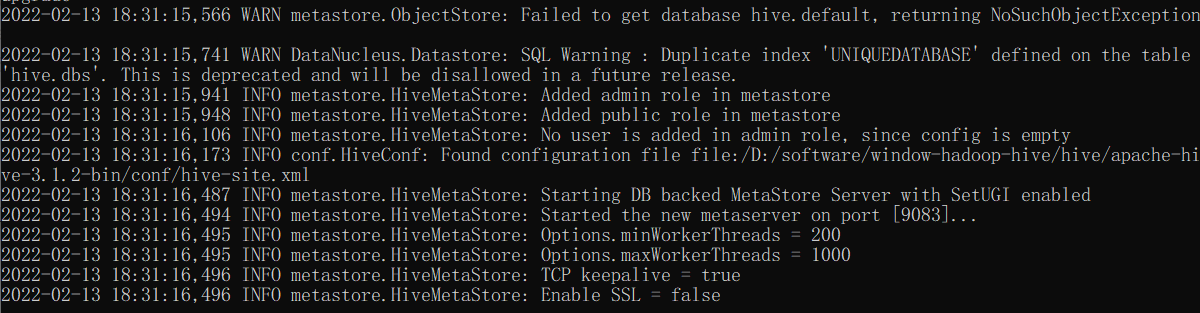

2、再啟動Hive 服務

$ hive --service metastore

3、驗證

另起一個cmd視窗驗證

$ hive

create databases test;

show databases;

12)配置beeline

1、添加beeline配置

【溫馨提示】hive命令會慢慢不再使用了,以後就用beeline,如果對hive不瞭解的,可以看我之前的文章:大數據Hadoop之——數據倉庫Hive

在Hive服務安裝目錄的%HIVE_HOME%\conf\hive-site.xml配置文件中添加以下配置:

<!-- host -->

<property>

<name>hive.server2.thrift.bind.host</name>

<value>localhost</value>

<description>Bind host on which to run the HiveServer2 Thrift service.</description>

</property>

<!-- hs2埠 預設是10000,為了區別,我這裡不使用預設埠-->

<property>

<name>hive.server2.thrift.port</name>

<value>10001</value>

</property>

在Hadoop服務安裝目錄的%HADOOP_HOME%\etc\hadoop\core-site.xml配置文件中添加以下配置:

<property>

<name>hadoop.proxyuser.29209.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.29209.groups</name>

<value>*</value>

</property>

【註意】hadoop.proxyuser.29209.hosts和hadoop.proxyuser.29209.hosts,其中

29209是連接beeline的用戶,將29209替換成自己的用戶名即可,其實這裡的用戶就是我本機的用戶,也是上面創建文件夾的用戶,這個用戶是什麼不重要,它就是個超級代理。

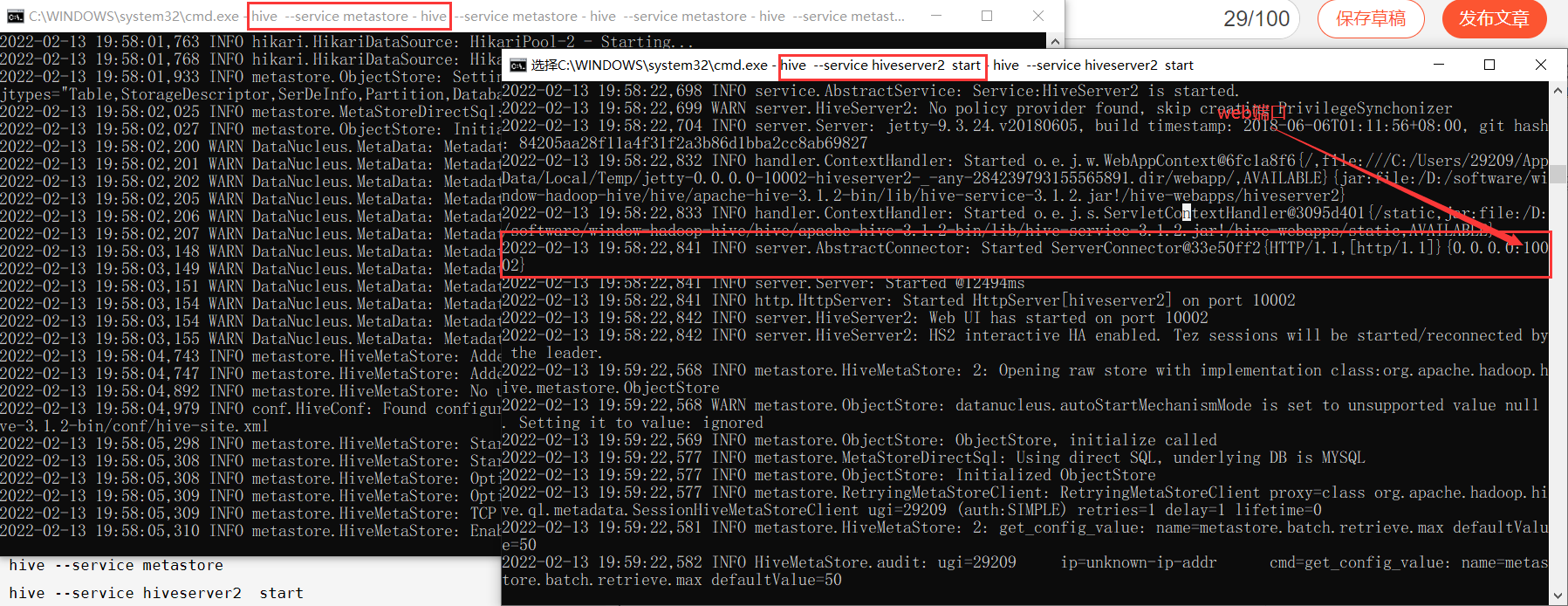

2、啟動hiveserver2

啟動hiveserver2 之前必須重啟hive服務

$ hive --service metastore

$ hive --service hiveserver2

【問題】java.lang.NoClassDefFoundError: org/apache/tez/dag/api/SessionNotRunning

【解決】在hive 配置文件hive-site.xml添加如下配置:

<property>

<name>hive.server2.active.passive.ha.enable</name>

<value>true</value>

<description>Whether HiveServer2 Active/Passive High Availability be enabled when Hive Interactive sessions are enabled.This will also require hive.server2.support.dynamic.service.discovery to be enabled.</description>

</property>

重啟hiveserver2

$ hive --service metastore

$ hive --service hiveserver2

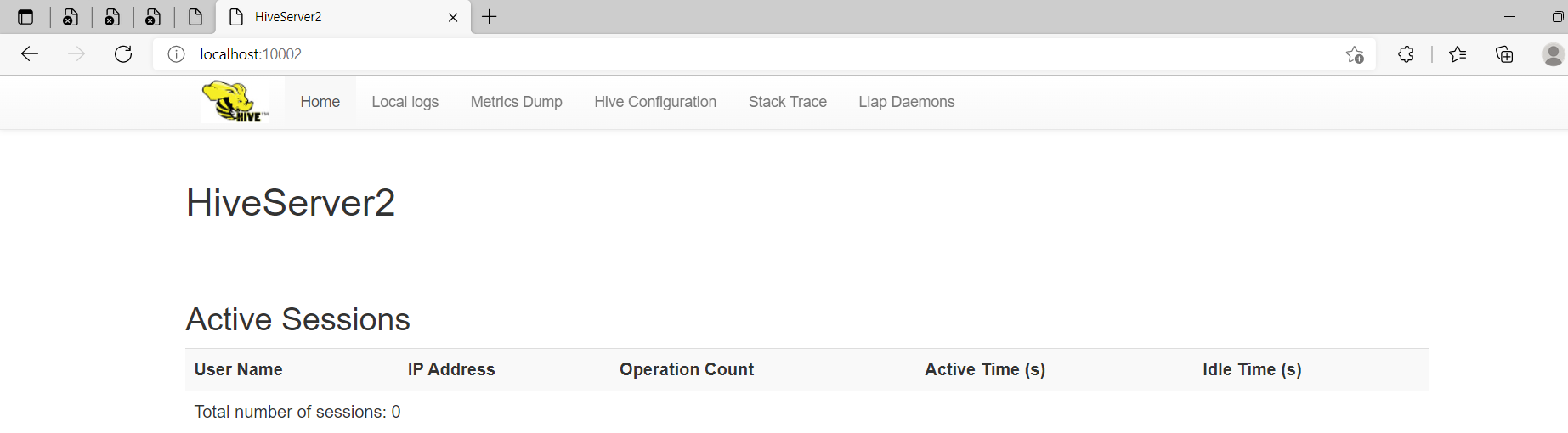

HiveServer2 web:http://localhost:10002/

2、beeline客戶端登錄

$ beeline

【問題一】Exception in thread "main" java.lang.NoClassDefFoundError: org/apache/hive/jdbc/JdbcUriParseException

【解決】Hadoop缺少hive-jdbc-***.jar,將Hive安裝目錄下的lib文件夾中的hive-jdbc-3.1.2.jar包複製到Hadoop安裝目錄\share\hadoop\common\lib下

【問題二】Exception in thread "main" java.lang.NoClassDefFoundError: org/apache/hadoop/hive/conf/HiveConf

【解決】Hive安裝目錄下,將hive-common-3.1.2.jar複製到Hadoop安裝目錄的\share\hadoop\common\lib下

$ beeline

!connect jdbc:hive2://localhost:10001

29209

# 下麵這句跟上面等價,都可以登錄

$ %HIVE_HOME%\bin\beeline.cmd -u jdbc:hive2://localhost:10001 -n 29209

【問題三】Exception in thread "main" java.lang.NoClassDefFoundError: org/apache/hive/service/cli/HiveSQLException。

【解決】把Hive安裝目錄下,將hive-service-3.1.2.jar複製到Hadoop安裝目錄的\share\hadoop\common\lib下。

再重啟登錄

$ hive --service metastore

$ hive --service hiveserver2

$ %HIVE_HOME%\bin\beeline.cmd -u jdbc:hive2://localhost:10001 -n 29209

正常登錄,一切OK,更多關於大數據的知識,請耐心等待~