一、Spark on Hive 和 Hive on Spark的區別 1)Spark on Hive Spark on Hive 是Hive只作為存儲角色,Spark負責sql解析優化,執行。這裡可以理解為Spark 通過Spark SQL 使用Hive 語句操作Hive表 ,底層運行的還是 Spa ...

目錄

一、Spark on Hive 和 Hive on Spark的區別

1)Spark on Hive

Spark on Hive 是Hive只作為存儲角色,Spark負責sql解析優化,執行。這裡可以理解為Spark 通過Spark SQL 使用Hive 語句操作Hive表 ,底層運行的還是 Spark RDD。具體步驟如下:

- 通過SparkSQL,載入Hive的配置文件,獲取到Hive的元數據信息;

- 獲取到Hive的元數據信息之後可以拿到Hive表的數據;

- 通過SparkSQL來操作Hive表中的數據。

具體實現在我之前的博文中已經講過,在這裡就不再重覆了,實現很簡單,可以參考:大數據Hadoop之——Spark SQL+Spark Streaming

【總結】Spark使用Hive來提供表的metadata信息。

2)Hive on Spark(本章實現)

Hive on Spark是Hive既作為存儲又負責sql的解析優化,Spark負責執行。這裡Hive的執行引擎變成了Spark,不再是MR,這個要實現比Spark on Hive麻煩很多, 必須重新編譯你的spark和導入jar包,不過目前大部分使用的確實是spark on hive。

- Hive預設使用MapReduce作為執行引擎,即Hive on MapReduce。實際上,Hive還可以使用Tez和Spark作為其執行引擎,分別為Hive on Tez和Hive on Spark。由於MapReduce中間計算均需要寫入磁碟,而Spark是放在記憶體中,所以總體來講Spark比MapReduce快很多。因此,Hive on Spark也會比Hive on MapReduce快。由於Hive on MapReduce的缺陷,所以企業里基本上很少使用了。

【總結】hive on spark大體與spark on hive結構類似,只是SQL引擎不同,但是計算引擎都是spark!

參考文檔:

- https://cwiki.apache.org/confluence/display/Hive/Hive+on+Spark

- https://cwiki.apache.org/confluence/display/Hive/Hive+on+Spark:+Getting+Started#HiveonSpark:GettingStarted-VersionCompatibility

- https://cwiki.apache.org/confluence/display/Hive/HiveDeveloperFAQ#HiveDeveloperFAQ-HowdoIimportintoEclipse?

二、Hive on Spark實現

編譯Spark源碼

要使用Hive on Spark,所用的Spark版本必須不包含Hive的相關jar包,hive on spark 的官網上說“Note that you must have a version of Spark which does not include the Hive jars”。在spark官網下載的編譯的Spark都是有集成Hive的,因此需要自己下載源碼來編譯,並且編譯的時候不指定Hive。最終版本:Hadoop3.3.1+Spark2.3.0+Hive3.1.2,其實主要是spark和hive版本對應上就行,hadoop版本好像沒那麼嚴格,所以這裡hadoop版本我使用當前最新版本,但是還是建議使用hive的pom.xml配置文件里配置的版本。

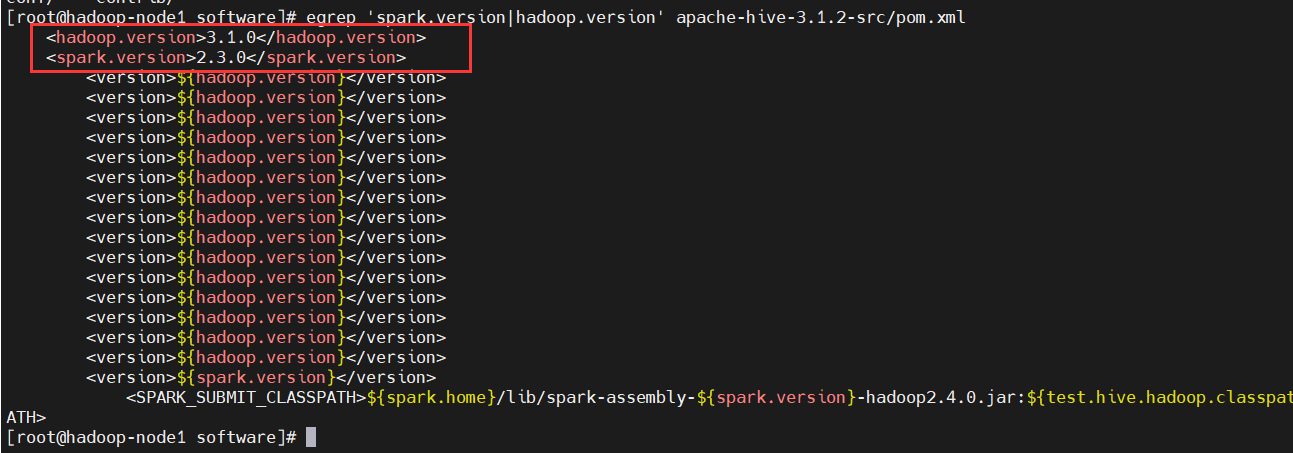

1)先下載hive源碼包查看spark版本

$ cd /opt/bigdata/hadoop/software

$ wget http://archive.apache.org/dist/hive/hive-3.1.2/apache-hive-3.1.2-src.tar.gz

$ tar -zxvf apache-hive-3.1.2-src.tar.gz

$ egrep 'spark.version|hadoop.version' apache-hive-3.1.2-src/pom.xml

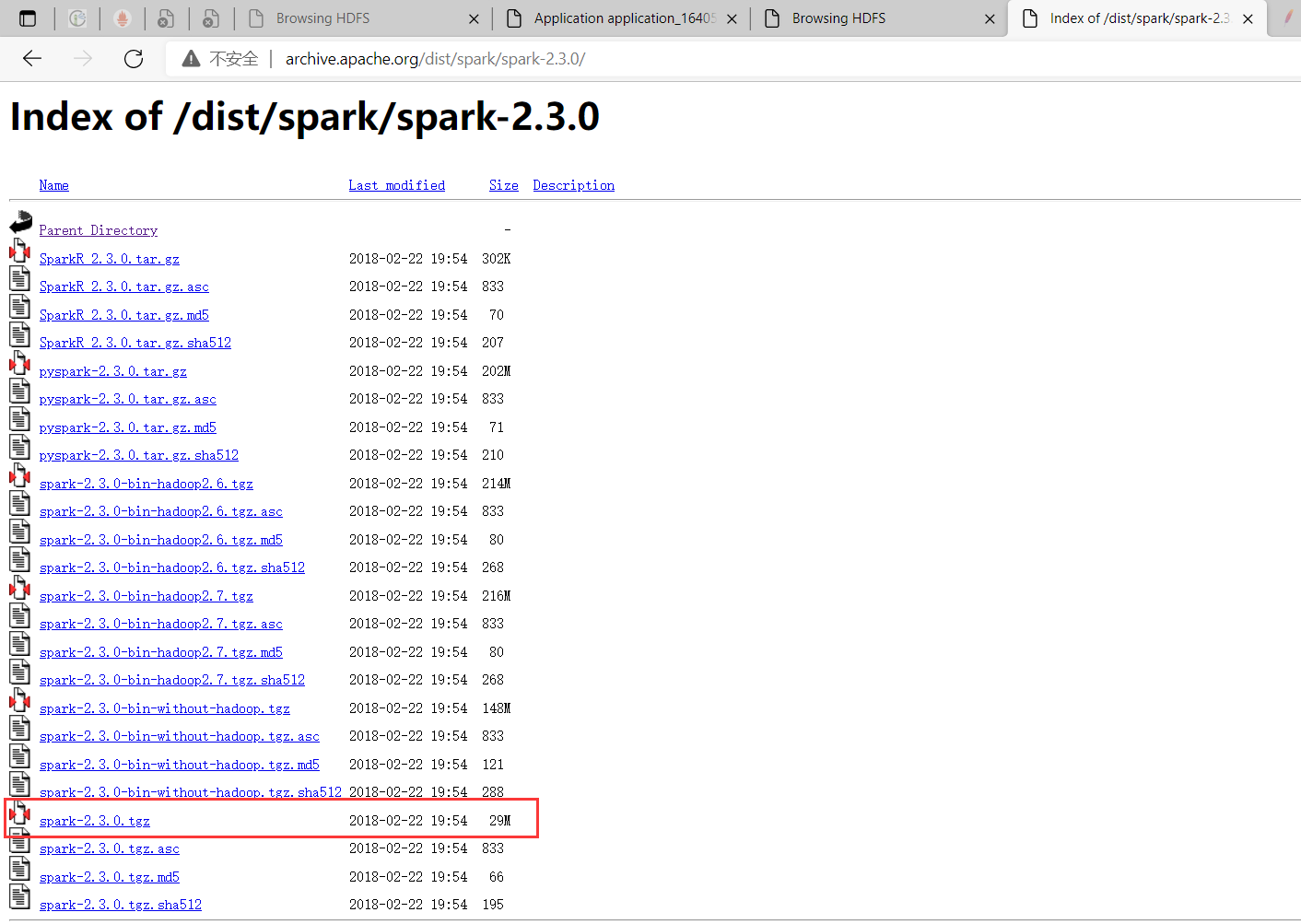

2)下載spark

下載地址:https://archive.apache.org/dist/spark/spark-2.3.0/

$ cd /opt/bigdata/hadoop/software

# 下載

$ wget http://archive.apache.org/dist/spark/spark-2.3.0/spark-2.3.0.tgz

3)解壓編譯

# 解壓

$ tar -zxvf spark-2.3.0.tgz

$ cd spark-2.3.0

# 開始編譯,註意hadoop版本

$ ./dev/make-distribution.sh --name without-hive --tgz -Pyarn -Phadoop-2.7 -Dhadoop.version=3.3.1 -Pparquet-provided -Porc-provided -Phadoop-provided

# 或者(這裡不執行下麵這句,因為跟上面等價)

$ ./dev/make-distribution.sh --name "without-hive" --tgz "-Pyarn,hadoop-provided,hadoop-2.7,parquet-provided,orc-provided"

命令解釋:

-Phadoop-3.3 \ -Dhadoop.version=3.3.1 \ ***指定hadoop版本為3.3.1

--name without-hive hive 是編譯文件的名字參數

--tgz ***壓縮成tgz格式

-Pyarn 是支持yarn

-Phadoop-2.7 是支持的hadoop版本,一開始使用的是3.3後來提示hadoop3.3不存在,只好改成2.7,編譯成功

-Dhadoop.version=3.3.1 運行環境

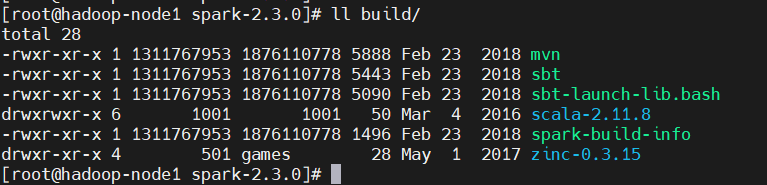

但是發現編譯卡住了,原來編譯會自動下載maven和scala,存放在build目錄下,如圖:

自動下載完maven和scala,就開始編譯了,編譯耗時還是比較久,慢慢等待編譯結束吧。

編譯花了半個小時左右,終於編譯完成了。編譯的時間太漫長,下麵我也會把我編譯好的spark包放在網盤上供大家下載使用。

在當前目錄下就有編譯好的spark包

$ ll

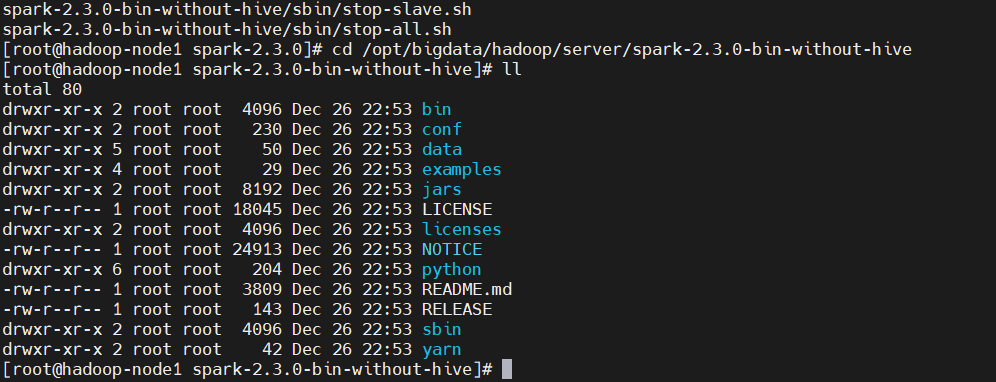

4)解壓

$ tar -zxvf spark-2.3.0-bin-without-hive.tgz -C /opt/bigdata/hadoop/server/

$ cd /opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive

$ ll

5)把spark jar包上傳到HDFS

【溫馨提示】hive-site.xml文件里配置需要。

$ cd /opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive/

### 創建日誌存放目錄

$ hadoop fs -mkdir -p hdfs://hadoop-node1:8082/tmp/spark

### 在hdfs上創建存放jar包目錄

$ hadoop fs -mkdir -p /spark/spark-2.4.5-jars

## 上傳jars到HDFS

$ hadoop fs -put ./jars/* /spark/spark-2.4.5-jars/

如果使用了打包好的jar包,hive操作時會報如下錯誤:

Failed to execute spark task, with exception 'org.apache.hadoop.hive.ql.metadata.HiveException(Failed to create Spark client for Spark session c8c46c14-4d2a-4f7e-9a12-0cd62bf097db)'

FAILED: Execution Error, return code 30041 from org.apache.hadoop.hive.ql.exec.spark.SparkTask. Failed to create Spark client for Spark session c8c46c14-4d2a-4f7e-9a12-0cd62bf097db

6)打包spark jar包並上傳到HDFS

【溫馨提示】spark-default.xml文件需要配置打包好的jar包,spark-submit會調用。

$ cd /opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive/

$ jar cv0f spark2.3.0-without-hive-libs.jar -C ./jars/ .

$ ll

### 在hdfs上創建存放jar包目錄

$ hadoop fs -mkdir -p /spark/jars

## 上傳jars到HDFS

$ hadoop fs -put spark2.3.0-without-hive-libs.jar /spark/jars/

如果不打包,則會報如下錯誤:

Exception in thread "main" java.io.FileNotFoundException: File does not exist: hdfs://hadoop-node1:8082/spark/spark-2.3.0-jars/*.jar

at org.apache.hadoop.hdfs.DistributedFileSystem$29.doCall(DistributedFileSystem.java:1756)

at org.apache.hadoop.hdfs.DistributedFileSystem$29.doCall(DistributedFileSystem.java:1749)

at org.apache.hadoop.fs.FileSystemLinkResolver.resolve(FileSystemLinkResolver.java:81)

at org.apache.hadoop.hdfs.DistributedFileSystem.getFileStatus(DistributedFileSystem.java:1764)

at org.apache.spark.deploy.yarn.ClientDistributedCacheManager$$anonfun$1.apply(ClientDistributedCacheManager.scala:71)

at org.apache.spark.deploy.yarn.ClientDistributedCacheManager$$anonfun$1.apply(ClientDistributedCacheManager.scala:71)

at scala.collection.MapLike$class.getOrElse(MapLike.scala:128)

at scala.collection.AbstractMap.getOrElse(Map.scala:59)

at org.apache.spark.deploy.yarn.ClientDistributedCacheManager.addResource(ClientDistributedCacheManager.scala:71)

at org.apache.spark.deploy.yarn.Client.org$apache$spark$deploy$yarn$Client$$distribute$1(Client.scala:480)

at org.apache.spark.deploy.yarn.Client.prepareLocalResources(Client.scala:517)

at org.apache.spark.deploy.yarn.Client.createContainerLaunchContext(Client.scala:863)

at org.apache.spark.deploy.yarn.Client.submitApplication(Client.scala:169)

at org.apache.spark.scheduler.cluster.YarnClientSchedulerBackend.start(YarnClientSchedulerBackend.scala:57)

at org.apache.spark.scheduler.TaskSchedulerImpl.start(TaskSchedulerImpl.scala:164)

at org.apache.spark.SparkContext.(SparkContext.scala:500)

at org.apache.spark.SparkContext$.getOrCreate(SparkContext.scala:2486)

at org.apache.spark.sql.SparkSession$Builder$$anonfun$7.apply(SparkSession.scala:930)

at org.apache.spark.sql.SparkSession$Builder$$anonfun$7.apply(SparkSession.scala:921)

at scala.Option.getOrElse(Option.scala:121)

at org.apache.spark.sql.SparkSession$Builder.getOrCreate(SparkSession.scala:921)

at org.apache.spark.examples.SparkPi$.main(SparkPi.scala:31)

at org.apache.spark.examples.SparkPi.main(SparkPi.scala)

at sun.reflect.NativeMethodAccessorImpl.invoke0(Native Method)

at sun.reflect.NativeMethodAccessorImpl.invoke(NativeMethodAccessorImpl.java:62)

at sun.reflect.DelegatingMethodAccessorImpl.invoke(DelegatingMethodAccessorImpl.java:43)

at java.lang.reflect.Method.invoke(Method.java:498)

at org.apache.spark.deploy.JavaMainApplication.start(SparkApplication.scala:52)

at org.apache.spark.deploy.SparkSubmit$.org$apache$spark$deploy$SparkSubmit$$runMain(SparkSubmit.scala:879)

at org.apache.spark.deploy.SparkSubmit$.doRunMain$1(SparkSubmit.scala:197)

at org.apache.spark.deploy.SparkSubmit$.submit(SparkSubmit.scala:227)

at org.apache.spark.deploy.SparkSubmit$.main(SparkSubmit.scala:136)

at org.apache.spark.deploy.SparkSubmit.main(SparkSubmit.scala)

7)配置

1、配置spark-defaults.conf

$ cd /opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive/conf

# copy一個配置文件

$ cp spark-defaults.conf.template spark-defaults.conf

spark-defaults.conf修改內容如下:

spark.master yarn

spark.home /opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive

spark.eventLog.enabled true

spark.eventLog.dir hdfs://hadoop-node1:8082/tmp/spark

spark.serializer org.apache.spark.serializer.KryoSerializer

spark.executor.memory 1g

spark.driver.memory 1g

spark.executor.extraJavaOptions -XX:+PrintGCDetails -Dkey=value -Dnumbers="one two three"

spark.yarn.archive hdfs:///spark/jars/spark2.3.0-without-hive-libs.jar

spark.yarn.jars hdfs:///spark/jars/spark2.3.0-without-hive-libs.jar

### 參數解釋,不用複製到配置文件中

# spark.master指定Spark運行模式,可以是yarn-client、yarn-cluster...

# spark.home指定SPARK_HOME路徑

# spark.eventLog.enabled需要設為true

# spark.eventLog.dir指定路徑,放在master節點的hdfs中,埠要跟hdfs設置的埠一致(預設為8020),否則會報錯

# spark.executor.memory和spark.driver.memory指定executor和dirver的記憶體,512m或1g,既不能太大也不能太小,因為太小運行不了,太大又會影響其他服務

2、配置spark-env.sh

$ cd /opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive/conf

$ cp spark-env.sh.template spark-env.sh

# 在spark-env.sh添加如下內容

$ vi spark-env.sh

export SPARK_DIST_CLASSPATH=$(hadoop classpath)

export HADOOP_CONF_DIR={HADOOP_HOME}/etc/hadoop/

# 載入

$ source spark-env.sh

在Yarn模式運行時,需要將以下三個包放在HIVE_HOME/lib下 :scala-library、spark-core、spark-network-common。

$ cd /opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive

# 先刪

$ rm -f ../apache-hive-3.1.2-bin/lib/scala-library-*.jar

$ rm -f ../apache-hive-3.1.2-bin/lib/spark-core_*.jar

$ rm -f ../apache-hive-3.1.2-bin/lib/spark-network-common_*.jar

# copy這三個jar到hive lib目錄下

$ cp jars/scala-library-*.jar ../apache-hive-3.1.2-bin/lib/

$ cp jars/spark-core_*.jar ../apache-hive-3.1.2-bin/lib/

$ cp jars/spark-network-common_*.jar ../apache-hive-3.1.2-bin/lib/

3、配置hive-site.xml

$ cd /opt/bigdata/hadoop/server/apache-hive-3.1.2-bin/conf/

#配置hive-site.xml,主要mysql資料庫

$ cat << EOF > hive-site.xml

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- 配置hdfs存儲目錄 -->

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/user/hive_remote/warehouse</value>

</property>

<!-- 所連接的 MySQL 資料庫的地址,hive_remote是資料庫,程式會自動創建,自定義就行 -->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://hadoop-node1:3306/hive_remote2?createDatabaseIfNotExist=true&useSSL=false&serverTimezone=Asia/Shanghai</value>

</property>

<!-- 本地模式

<property>

<name>hive.metastore.local</name>

<value>false</value>

</property>

-->

<!-- MySQL 驅動 -->

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<!-- mysql連接用戶 -->

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<!-- mysql連接密碼 -->

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>123456</value>

</property>

<!--元數據是否校驗-->

<property>

<name>hive.metastore.schema.verification</name>

<value>false</value>

</property>

<property>

<name>system:user.name</name>

<value>root</value>

<description>user name</description>

</property>

<!-- host -->

<property>

<name>hive.server2.thrift.bind.host</name>

<value>hadoop-node1</value>

<description>Bind host on which to run the HiveServer2 Thrift service.</description>

</property>

<!-- hs2埠 -->

<property>

<name>hive.server2.thrift.port</name>

<value>11000</value>

</property>

<property>

<name>hive.metastore.uris</name>

<value>thrift://hadoop-node1:9083</value>

</property>

<!--Spark依賴位置,上面上傳jar包的hdfs路徑-->

<property>

<name>spark.yarn.jars</name>

<value>hdfs:///spark/spark-2.3.0-jars/*.jar</value>

</property>

<!--Hive執行引擎,使用spark-->

<property>

<name>hive.execution.engine</name>

<value>spark</value>

</property>

<!--Hive和spark連接超時時間-->

<property>

<name>hive.spark.client.connect.timeout</name>

<value>10000ms</value>

</property>

</configuration>

EOF

8)設置環境變數

在/etc/profile添加如下配置:

export HIVE_HOME=/opt/bigdata/hadoop/server/apache-hive-3.1.2-bin

export PATH=$HIVE_HOME/bin:$PATH

export SPARK_HOME=/opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive

export PATH=$SPARK_HOME/bin:$PATH

載入

$ source /etc/profile

9)初始化資料庫(mysql)

不清楚的可以先看一下這篇文章 大數據Hadoop之——數據倉庫Hive

# 初始化,--verbose:查詢詳情,可以不加

$ schematool -initSchema -dbType mysql --verbose

10)啟動或者重啟hive的metstore服務

# 先查進程是否存在,存在則kill掉

$ ss -atnlp|grep 9083

# 啟動metstore服務

$ nohup hive --service metastore &

11)測試驗證

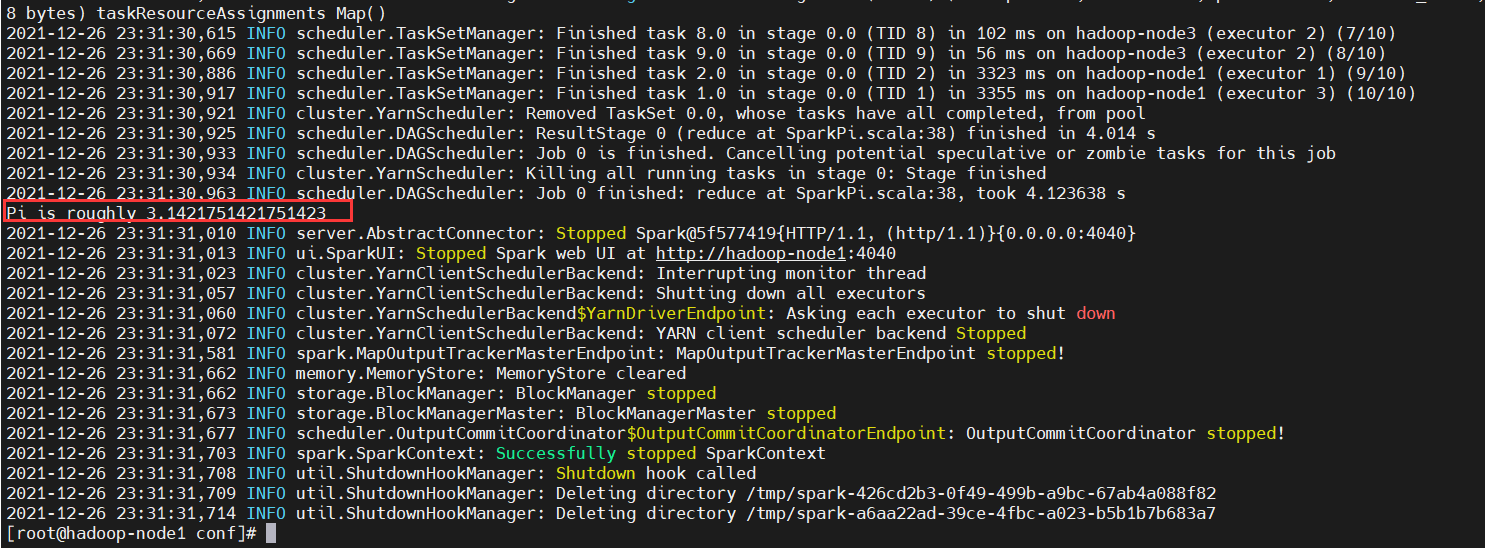

先驗證編譯好的spark是否ok,就用spark提供的示例:SparkPI

$ spark-submit \

--class org.apache.spark.examples.SparkPi \

--master yarn \

--deploy-mode client \

--driver-memory 1G \

--num-executors 3 \

--executor-memory 1G \

--executor-cores 1 \

/opt/bigdata/hadoop/server/spark-2.3.0-bin-without-hive/examples/jars/spark-examples_*.jar 10

從上圖發現編譯好的spark包是沒問題的,接下來就是驗證hive提交spark任務

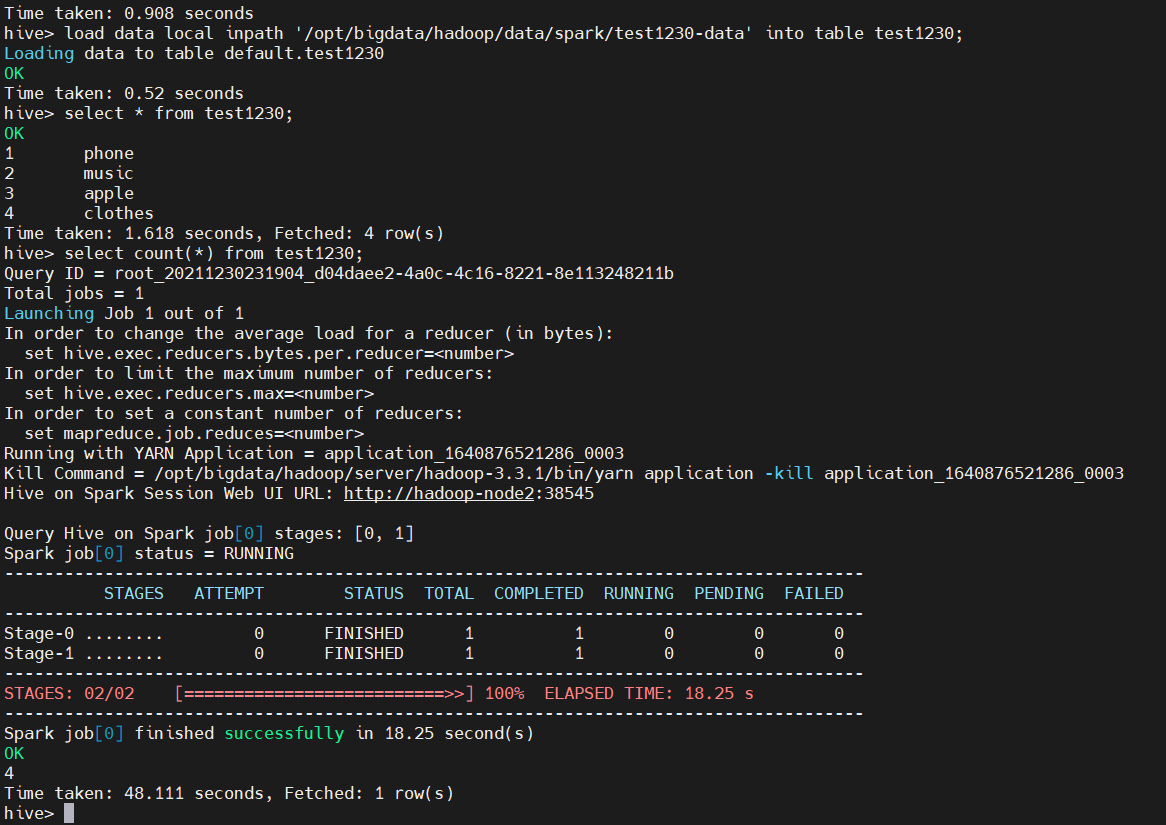

$ mkdir /opt/bigdata/hadoop/data/spark

$ cat << EOF > /opt/bigdata/hadoop/data/spark/test1230-data

1,phone

2,music

3,apple

4,clothes

EOF

# 啟動hive

$ hive

# 創建表,通過逗號分隔欄位

create table test1230(id string,shop string) row format delimited fields terminated by ',';

# 從local載入數據,這裡的local是指hs2服務所在機器的本地linux文件系統

load data local inpath '/opt/bigdata/hadoop/data/spark/test1230-data' into table test1230;

# 通過insert添加數據,會提交spark任務

select * from test1230;

select count(*) from test1230;

最後提供我上面編譯好的spark2.3.0版本的包,下載地址如下:

鏈接:https://pan.baidu.com/s/1OY_Mn8UdRkTiiMktjQ3wlQ

提取碼:8888