redis-sentinel主從複製高可用 主從複製架構 redis主從複製背景問題 Redis主從複製可將主節點數據同步給從節點,從節點此時有兩個作用: 一旦主節點宕機,從節點作為主節點的備份可以隨時頂上來。 擴展主節點的讀能力,分擔主節點讀壓力。 但是問題是: 一旦主節點宕機,從節點上位,那麼需 ...

redis-sentinel主從複製高可用

主從複製架構

redis主從複製背景問題

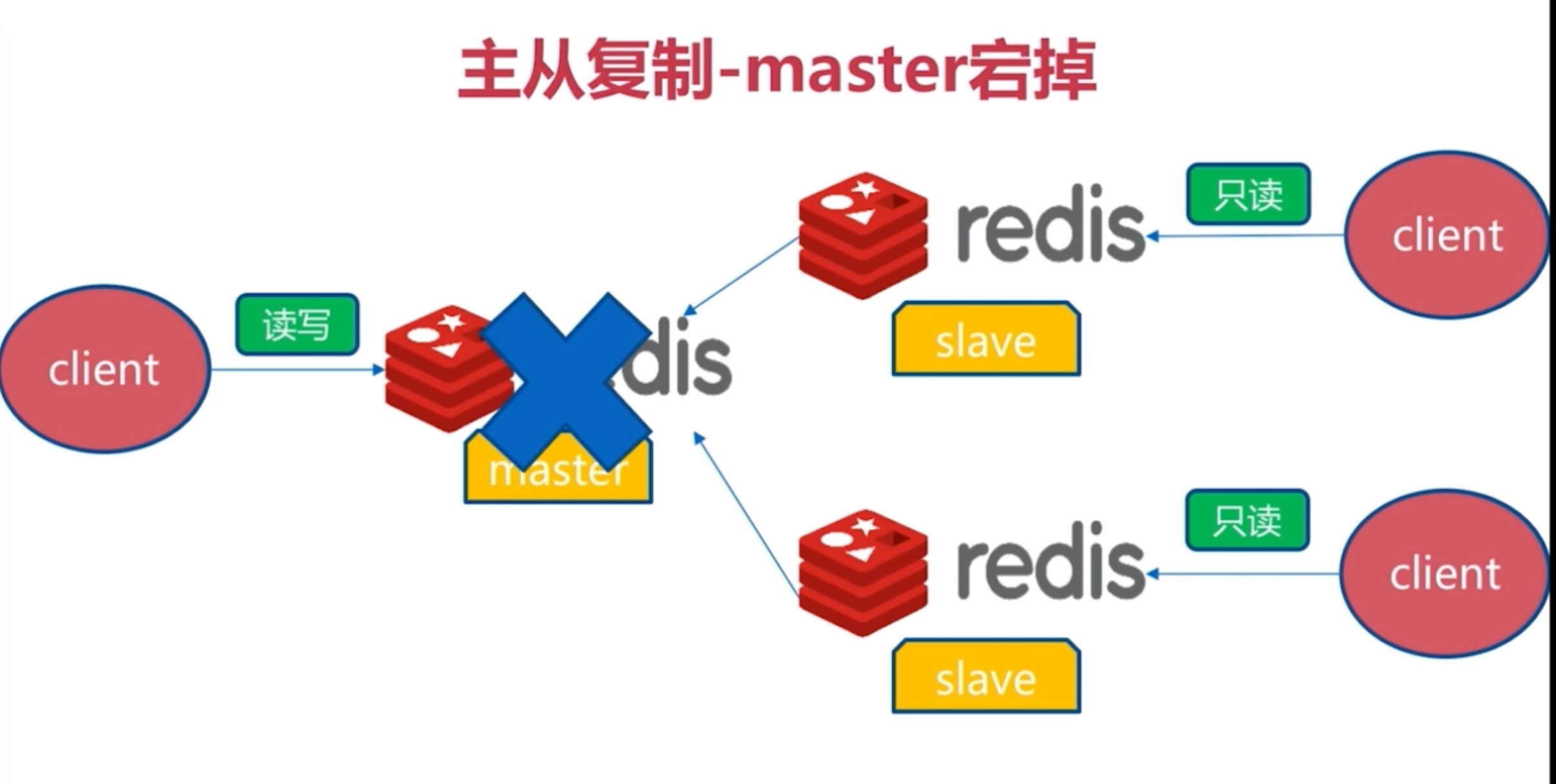

Redis主從複製可將主節點數據同步給從節點,從節點此時有兩個作用:

- 一旦主節點宕機,從節點作為主節點的備份可以隨時頂上來。

- 擴展主節點的讀能力,分擔主節點讀壓力。

但是問題是:

- 一旦主節點宕機,從節點上位,那麼需要人為修改所有應用方的主節點地址(改為新的master地址),還需要命令所有從節點複製新的主節點

那麼這個問題,redis-sentinel就可以解決了

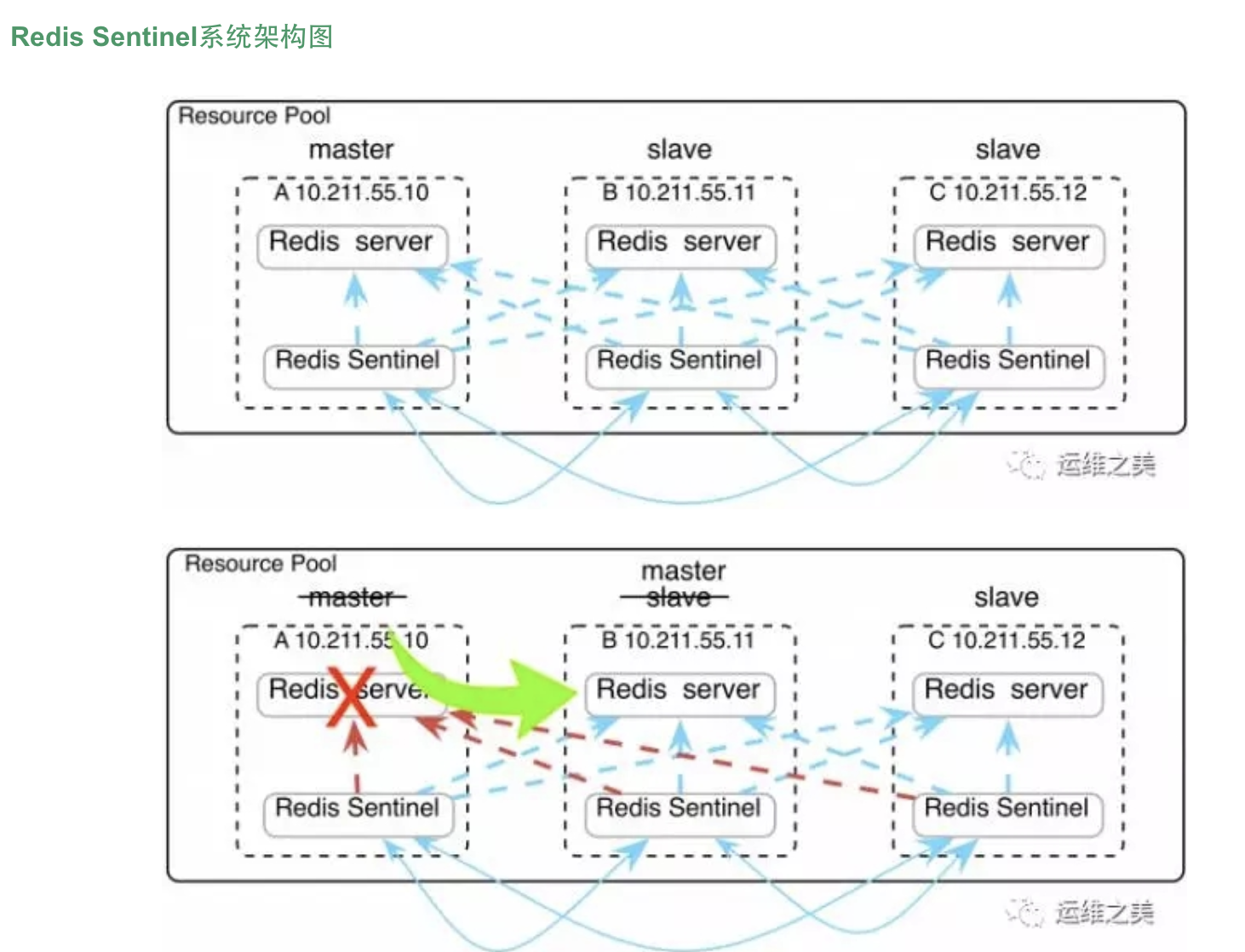

Redis-Sentinel

Redis-Sentinel是redis官方推薦的高可用性解決方案,

當用redis作master-slave的高可用時,如果master本身宕機,redis本身或者客戶端都沒有實現主從切換的功能。

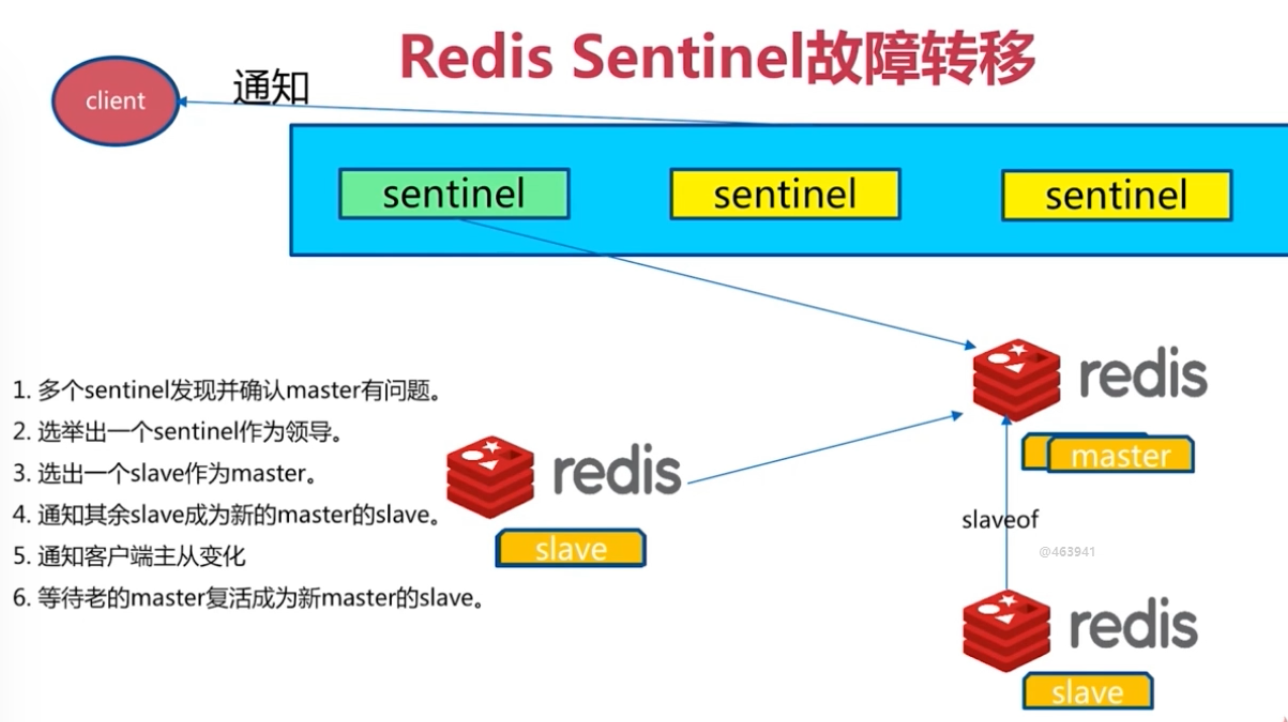

而redis-sentinel就是一個獨立運行的進程,用於監控多個master-slave集群,

自動發現master宕機,進行自動切換slave > master。

sentinel主要功能如下:

- 不時的監控redis是否良好運行,如果節點不可達就會對節點進行下線標識

- 如果被標識的是主節點,sentinel就會和其他的sentinel節點“協商”,如果其他節點也人為主節點不可達,就會選舉一個sentinel節點來完成自動故障轉義

- 在master-slave進行切換後,master_redis.conf、slave_redis.conf和sentinel.conf的內容都會發生改變,即master_redis.conf中會多一行slaveof的配置,sentinel.conf的監控目標會隨之調換

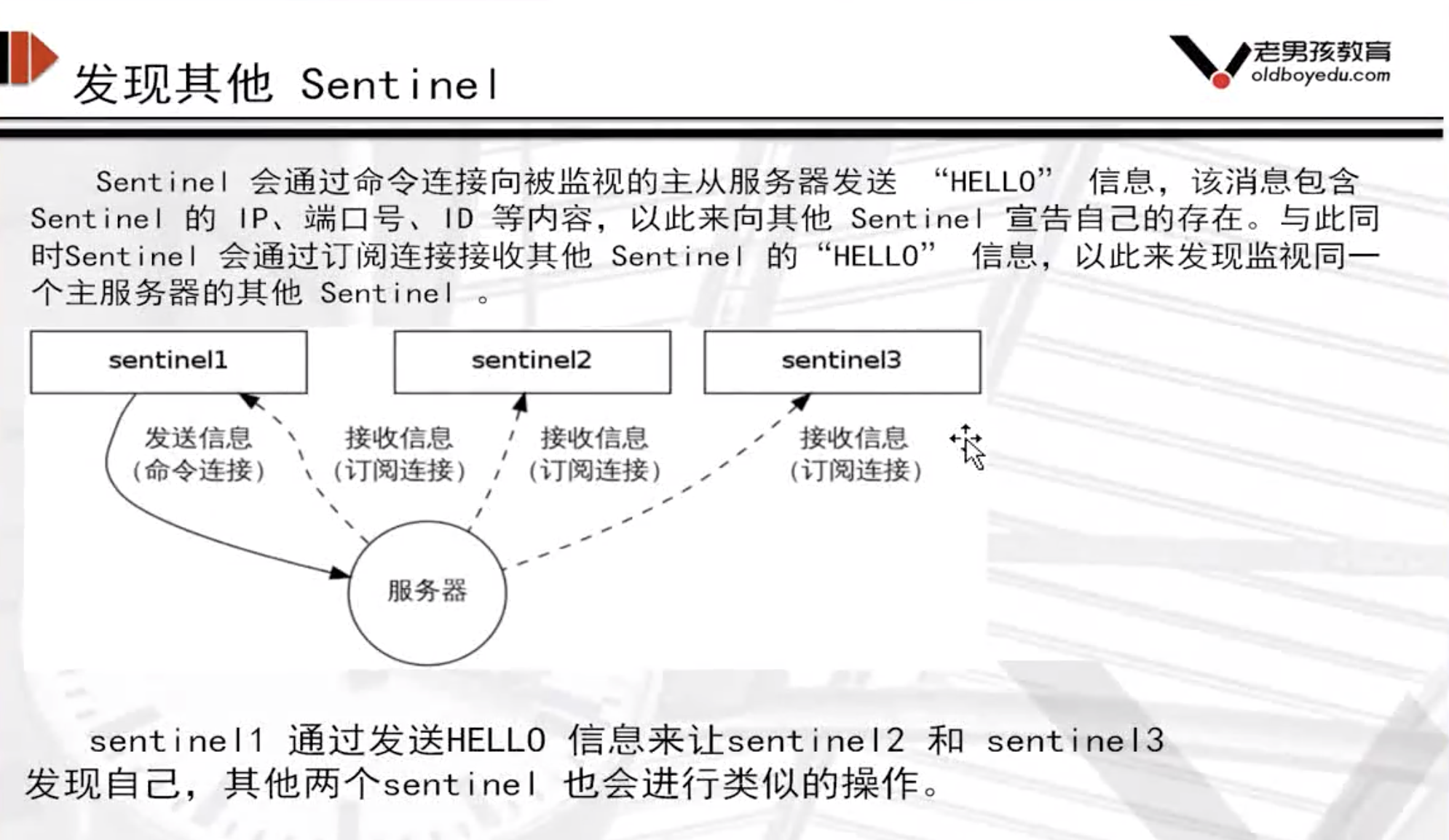

Sentinel的工作方式:

每個Sentinel以每秒鐘一次的頻率向它所知的Master,Slave以及其他 Sentinel 實例發送一個 PING 命令 如果一個實例(instance)距離最後一次有效回覆 PING 命令的時間超過 down-after-milliseconds 選項所指定的值, 則這個實例會被 Sentinel 標記為主觀下線。 如果一個Master被標記為主觀下線,則正在監視這個Master的所有 Sentinel 要以每秒一次的頻率確認Master的確進入了主觀下線狀態。 當有足夠數量的 Sentinel(大於等於配置文件指定的值)在指定的時間範圍內確認Master的確進入了主觀下線狀態, 則Master會被標記為客觀下線 在一般情況下, 每個 Sentinel 會以每 10 秒一次的頻率向它已知的所有Master,Slave發送 INFO 命令 當Master被 Sentinel 標記為客觀下線時,Sentinel 向下線的 Master 的所有 Slave 發送 INFO 命令的頻率會從 10 秒一次改為每秒一次 若沒有足夠數量的 Sentinel 同意 Master 已經下線, Master 的客觀下線狀態就會被移除。 若 Master 重新向 Sentinel 的 PING 命令返回有效回覆, Master 的主觀下線狀態就會被移除。 主觀下線和客觀下線 主觀下線:Subjectively Down,簡稱 SDOWN,指的是當前 Sentinel 實例對某個redis伺服器做出的下線判斷。 客觀下線:Objectively Down, 簡稱 ODOWN,指的是多個 Sentinel 實例在對Master Server做出 SDOWN 判斷,並且通過 SENTINEL is-master-down-by-addr 命令互相交流之後,得出的Master Server下線判斷,然後開啟failover. SDOWN適合於Master和Slave,只要一個 Sentinel 發現Master進入了ODOWN, 這個 Sentinel 就可能會被其他 Sentinel 推選出, 並對下線的主伺服器執行自動故障遷移操作。 ODOWN只適用於Master,對於Slave的 Redis 實例,Sentinel 在將它們判斷為下線前不需要進行協商, 所以Slave的 Sentinel 永遠不會達到ODOWN。sentinel工作方式

Redis Sentinel架構

redis的一個進程,但是不存儲數據,只是監控redis

redis命令整理

官網地址:http://redisdoc.com/ redis-cli info #查看redis資料庫信息 redis-cli info replication #查看redis的複製授權信息

redis-cli info sentinel #查看redis的哨兵信息

安裝與配置

註意: 本實驗是在測試環境下,考慮到學生機器較弱,因此只准備一臺linux伺服器用作環境!!

伺服器環境,一臺即可完成操作

master 10.0.0.5

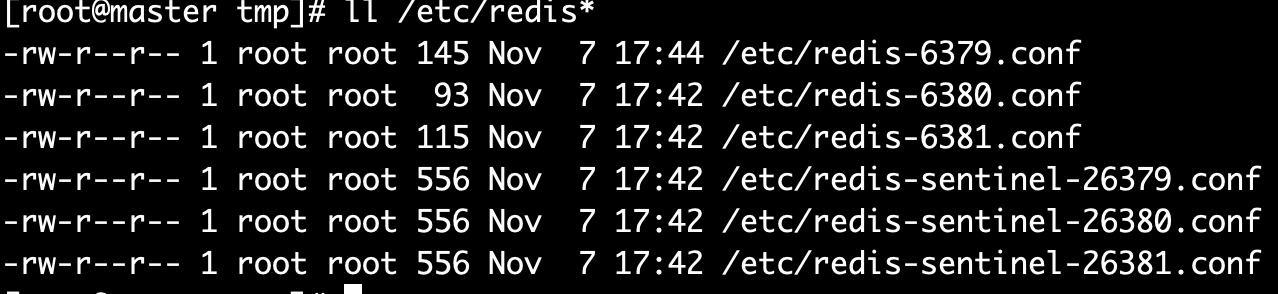

所有配置文件如下

主節點master的redis-6379.conf

port 6379 daemonize yes logfile "/var/redis/logs/6379.log" dbfilename "dump-6379.rdb"

bind 127.0.0.1 dir "/var/redis/data/"

從節點slave的redis-6380.conf

port 6380 daemonize yes logfile "/var/redis/logs/6380.log" dbfilename "dump-6380.rdb" dir "/var/redis/data/"

bind 127.0.0.1 slaveof 127.0.0.1 6379 // 從屬主節點

從節點slave的redis-6381.conf

port 6381 daemonize yes logfile "/var/redis/logs/6381.log" dbfilename "dump-6381.rdb" dir "/var/redis/data/"

bind 127.0.0.1 slaveof 127.0.0.1 6379 // 從屬主節點

啟動redis主節點

redis-server /etc/redis-6379.conf

測試redis主節點是否通信

redis-cli ping

啟動兩slave節點

還記得上面的截圖嗎?總體redis配置文件如下,6379為master,6380和6381為slave

-rw-r--r-- 1 root root 145 Nov 7 17:44 /etc/redis-6379.conf #這個為主,port是6379 -rw-r--r-- 1 root root 93 Nov 7 17:42 /etc/redis-6380.conf # 這個是從,port6380,並且得加上新的參數slaveof -rw-r--r-- 1 root root 115 Nov 7 17:42 /etc/redis-6381.conf # 這個是從,port6381,並且得加上新的參數slaveof

redis-6380.conf slave配置文件詳解,6381埠的配置文件,僅僅和6380埠不一樣

port 6380 daemonize yes logfile "6379.log" dbfilename "dump-6379.rdb" dir "/var/redis/data"

bind 127.0.0.1 # Generated by CONFIG REWRITE slaveof 127.0.0.1 6379

# Redis 配置文件 # 當配置中需要配置記憶體大小時,可以使用 1k, 5GB, 4M 等類似的格式,其轉換方式如下(不區分大小寫) # # 1k => 1000 bytes # 1kb => 1024 bytes # 1m => 1000000 bytes # 1mb => 1024*1024 bytes # 1g => 1000000000 bytes # 1gb => 1024*1024*1024 bytes # # 記憶體配置大小寫是一樣的.比如 1gb 1Gb 1GB 1gB # daemonize no 預設情況下,redis不是在後臺運行的,如果需要在後臺運行,把該項的值更改為yes daemonize yes # 當redis在後臺運行的時候,Redis預設會把pid文件放在/var/run/redis.pid,你可以配置到其他地址。 # 當運行多個redis服務時,需要指定不同的pid文件和埠 pidfile /var/run/redis.pid # 指定redis運行的埠,預設是6379 port 6379 # 指定redis只接收來自於該IP地址的請求,如果不進行設置,那麼將處理所有請求, # 在生產環境中最好設置該項 # bind 127.0.0.1 # Specify the path for the unix socket that will be used to listen for # incoming connections. There is no default, so Redis will not listen # on a unix socket when not specified. # # unixsocket /tmp/redis.sock # unixsocketperm 755 # 設置客戶端連接時的超時時間,單位為秒。當客戶端在這段時間內沒有發出任何指令,那麼關閉該連接 # 0是關閉此設置 timeout 0 # 指定日誌記錄級別 # Redis總共支持四個級別:debug、verbose、notice、warning,預設為verbose # debug 記錄很多信息,用於開發和測試 # varbose 有用的信息,不像debug會記錄那麼多 # notice 普通的verbose,常用於生產環境 # warning 只有非常重要或者嚴重的信息會記錄到日誌 loglevel debug # 配置log文件地址 # 預設值為stdout,標準輸出,若後臺模式會輸出到/dev/null #logfile stdout logfile /var/log/redis/redis.log # To enable logging to the system logger, just set 'syslog-enabled' to yes, # and optionally update the other syslog parameters to suit your needs. # syslog-enabled no # Specify the syslog identity. # syslog-ident redis # Specify the syslog facility. Must be USER or between LOCAL0-LOCAL7. # syslog-facility local0 # 可用資料庫數 # 預設值為16,預設資料庫為0,資料庫範圍在0-(database-1)之間 databases 16 ################################ 快照 ################################# # # 保存數據到磁碟,格式如下: # # save <seconds> <changes> # # 指出在多長時間內,有多少次更新操作,就將數據同步到數據文件rdb。 # 相當於條件觸發抓取快照,這個可以多個條件配合 # # 比如預設配置文件中的設置,就設置了三個條件 # # save 900 1 900秒內至少有1個key被改變 # save 300 10 300秒內至少有300個key被改變 # save 60 10000 60秒內至少有10000個key被改變 save 900 1 save 300 10 save 60 10000 # 存儲至本地資料庫時(持久化到rdb文件)是否壓縮數據,預設為yes rdbcompression yes # 本地持久化資料庫文件名,預設值為dump.rdb dbfilename dump.rdb # 工作目錄 # # 資料庫鏡像備份的文件放置的路徑。 # 這裡的路徑跟文件名要分開配置是因為redis在進行備份時,先會將當前資料庫的狀態寫入到一個臨時文件中,等備份完成時, # 再把該該臨時文件替換為上面所指定的文件,而這裡的臨時文件和上面所配置的備份文件都會放在這個指定的路徑當中。 # # AOF文件也會存放在這個目錄下麵 # # 註意這裡必須制定一個目錄而不是文件 dir ./ ################################# 複製 ################################# # 主從複製. 設置該資料庫為其他資料庫的從資料庫. # 設置當本機為slav服務時,設置master服務的IP地址及埠,在Redis啟動時,它會自動從master進行數據同步 # # slaveof <masterip> <masterport> # 當master服務設置了密碼保護時(用requirepass制定的密碼) # slav服務連接master的密碼 # # masterauth <master-password> # 當從庫同主機失去連接或者複製正在進行,從機庫有兩種運行方式: # # 1) 如果slave-serve-stale-data設置為yes(預設設置),從庫會繼續相應客戶端的請求 # # 2) 如果slave-serve-stale-data是指為no,出去INFO和SLAVOF命令之外的任何請求都會返回一個 # 錯誤"SYNC with master in progress" # slave-serve-stale-data yes # 從庫會按照一個時間間隔向主庫發送PINGs.可以通過repl-ping-slave-period設置這個時間間隔,預設是10秒 # # repl-ping-slave-period 10 # repl-timeout 設置主庫批量數據傳輸時間或者ping回覆時間間隔,預設值是60秒 # 一定要確保repl-timeout大於repl-ping-slave-period # repl-timeout 60 ################################## 安全 ################################### # 設置客戶端連接後進行任何其他指定前需要使用的密碼。 # 警告:因為redis速度相當快,所以在一臺比較好的伺服器下,一個外部的用戶可以在一秒鐘進行150K次的密碼嘗試,這意味著你需要指定非常非常強大的密碼來防止暴力破解 # # requirepass foobared # 命令重命名. # # 在一個共用環境下可以重命名相對危險的命令。比如把CONFIG重名為一個不容易猜測的字元。 # # 舉例: # # rename-command CONFIG b840fc02d524045429941cc15f59e41cb7be6c52 # # 如果想刪除一個命令,直接把它重命名為一個空字元""即可,如下: # # rename-command CONFIG "" ################################### 約束 #################################### # 設置同一時間最大客戶端連接數,預設無限制,Redis可以同時打開的客戶端連接數為Redis進程可以打開的最大文件描述符數, # 如果設置 maxclients 0,表示不作限制。 # 當客戶端連接數到達限制時,Redis會關閉新的連接並向客戶端返回max number of clients reached錯誤信息 # # maxclients 128 # 指定Redis最大記憶體限制,Redis在啟動時會把數據載入到記憶體中,達到最大記憶體後,Redis會先嘗試清除已到期或即將到期的Key # Redis同時也會移除空的list對象 # # 當此方法處理後,仍然到達最大記憶體設置,將無法再進行寫入操作,但仍然可以進行讀取操作 # # 註意:Redis新的vm機制,會把Key存放記憶體,Value會存放在swap區 # # maxmemory的設置比較適合於把redis當作於類似memcached的緩存來使用,而不適合當做一個真實的DB。 # 當把Redis當做一個真實的資料庫使用的時候,記憶體使用將是一個很大的開銷 # maxmemory <bytes> # 當記憶體達到最大值的時候Redis會選擇刪除哪些數據?有五種方式可供選擇 # # volatile-lru -> 利用LRU演算法移除設置過過期時間的key (LRU:最近使用 Least Recently Used ) # allkeys-lru -> 利用LRU演算法移除任何key # volatile-random -> 移除設置過過期時間的隨機key # allkeys->random -> remove a random key, any key # volatile-ttl -> 移除即將過期的key(minor TTL) # noeviction -> 不移除任何可以,只是返回一個寫錯誤 # # 註意:對於上面的策略,如果沒有合適的key可以移除,當寫的時候Redis會返回一個錯誤 # # 寫命令包括: set setnx setex append # incr decr rpush lpush rpushx lpushx linsert lset rpoplpush sadd # sinter sinterstore sunion sunionstore sdiff sdiffstore zadd zincrby # zunionstore zinterstore hset hsetnx hmset hincrby incrby decrby # getset mset msetnx exec sort # # 預設是: # # maxmemory-policy volatile-lru # LRU 和 minimal TTL 演算法都不是精準的演算法,但是相對精確的演算法(為了節省記憶體),隨意你可以選擇樣本大小進行檢測。 # Redis預設的灰選擇3個樣本進行檢測,你可以通過maxmemory-samples進行設置 # # maxmemory-samples 3 ############################## AOF ############################### # 預設情況下,redis會在後臺非同步的把資料庫鏡像備份到磁碟,但是該備份是非常耗時的,而且備份也不能很頻繁,如果發生諸如拉閘限電、拔插頭等狀況,那麼將造成比較大範圍的數據丟失。 # 所以redis提供了另外一種更加高效的資料庫備份及災難恢復方式。 # 開啟append only模式之後,redis會把所接收到的每一次寫操作請求都追加到appendonly.aof文件中,當redis重新啟動時,會從該文件恢復出之前的狀態。 # 但是這樣會造成appendonly.aof文件過大,所以redis還支持了BGREWRITEAOF指令,對appendonly.aof 進行重新整理。 # 你可以同時開啟asynchronous dumps 和 AOF appendonly no # AOF文件名稱 (預設: "appendonly.aof") # appendfilename appendonly.aof # Redis支持三種同步AOF文件的策略: # # no: 不進行同步,系統去操作 . Faster. # always: always表示每次有寫操作都進行同步. Slow, Safest. # everysec: 表示對寫操作進行累積,每秒同步一次. Compromise. # # 預設是"everysec",按照速度和安全折中這是最好的。 # 如果想讓Redis能更高效的運行,你也可以設置為"no",讓操作系統決定什麼時候去執行 # 或者相反想讓數據更安全你也可以設置為"always" # # 如果不確定就用 "everysec". # appendfsync always appendfsync everysec # appendfsync no # AOF策略設置為always或者everysec時,後臺處理進程(後臺保存或者AOF日誌重寫)會執行大量的I/O操作 # 在某些Linux配置中會阻止過長的fsync()請求。註意現在沒有任何修複,即使fsync在另外一個線程進行處理 # # 為了減緩這個問題,可以設置下麵這個參數no-appendfsync-on-rewrite # # This means that while another child is saving the durability of Redis is # the same as "appendfsync none", that in pratical terms means that it is # possible to lost up to 30 seconds of log in the worst scenario (with the # default Linux settings). # # If you have latency problems turn this to "yes". Otherwise leave it as # "no" that is the safest pick from the point of view of durability. no-appendfsync-on-rewrite no # Automatic rewrite of the append only file. # AOF 自動重寫 # 當AOF文件增長到一定大小的時候Redis能夠調用 BGREWRITEAOF 對日誌文件進行重寫 # # 它是這樣工作的:Redis會記住上次進行些日誌後文件的大小(如果從開機以來還沒進行過重寫,那日子大小在開機的時候確定) # # 基礎大小會同現在的大小進行比較。如果現在的大小比基礎大小大制定的百分比,重寫功能將啟動 # 同時需要指定一個最小大小用於AOF重寫,這個用於阻止即使文件很小但是增長幅度很大也去重寫AOF文件的情況 # 設置 percentage 為0就關閉這個特性 auto-aof-rewrite-percentage 100 auto-aof-rewrite-min-size 64mb ################################## SLOW LOG ################################### # Redis Slow Log 記錄超過特定執行時間的命令。執行時間不包括I/O計算比如連接客戶端,返回結果等,只是命令執行時間 # # 可以通過兩個參數設置slow log:一個是告訴Redis執行超過多少時間被記錄的參數slowlog-log-slower-than(微妙), # 另一個是slow log 的長度。當一個新命令被記錄的時候最早的命令將被從隊列中移除 # 下麵的時間以微妙微單位,因此1000000代表一分鐘。 # 註意制定一個負數將關閉慢日誌,而設置為0將強制每個命令都會記錄 slowlog-log-slower-than 10000 # 對日誌長度沒有限制,只是要註意它會消耗記憶體 # 可以通過 SLOWLOG RESET 回收被慢日誌消耗的記憶體 slowlog-max-len 1024 ################################ VM ############################### ### WARNING! Virtual Memory is deprecated in Redis 2.4 ### The use of Virtual Memory is strongly discouraged. # Virtual Memory allows Redis to work with datasets bigger than the actual # amount of RAM needed to hold the whole dataset in memory. # In order to do so very used keys are taken in memory while the other keys # are swapped into a swap file, similarly to what operating systems do # with memory pages. # # To enable VM just set 'vm-enabled' to yes, and set the following three # VM parameters accordingly to your needs. vm-enabled no # vm-enabled yes # This is the path of the Redis swap file. As you can guess, swap files # can't be shared by different Redis instances, so make sure to use a swap # file for every redis process you are running. Redis will complain if the # swap file is already in use. # # The best kind of storage for the Redis swap file (that's accessed at random) # is a Solid State Disk (SSD). # # *** WARNING *** if you are using a shared hosting the default of putting # the swap file under /tmp is not secure. Create a dir with access granted # only to Redis user and configure Redis to create the swap file there. vm-swap-file /tmp/redis.swap # vm-max-memory configures the VM to use at max the specified amount of # RAM. Everything that deos not fit will be swapped on disk *if* possible, that # is, if there is still enough contiguous space in the swap file. # # With vm-max-memory 0 the system will swap everything it can. Not a good # default, just specify the max amount of RAM you can in bytes, but it's # better to leave some margin. For instance specify an amount of RAM # that's more or less between 60 and 80% of your free RAM. vm-max-memory 0 # Redis swap files is split into pages. An object can be saved using multiple # contiguous pages, but pages can't be shared between different objects. # So if your page is too big, small objects swapped out on disk will waste # a lot of space. If you page is too small, there is less space in the swap # file (assuming you configured the same number of total swap file pages). # # If you use a lot of small objects, use a page size of 64 or 32 bytes. # If you use a lot of big objects, use a bigger page size. # If unsure, use the default :) vm-page-size 32 # Number of total memory pages in the swap file. # Given that the page table (a bitmap of free/used pages) is taken in memory, # every 8 pages on disk will consume 1 byte of RAM. # # The total swap size is vm-page-size * vm-pages # # With the default of 32-bytes memory pages and 134217728 pages Redis will # use a 4 GB swap file, that will use 16 MB of RAM for the page table. # # It's better to use the smallest acceptable value for your application, # but the default is large in order to work in most conditions. vm-pages 134217728 # Max number of VM I/O threads running at the same time. # This threads are used to read/write data from/to swap file, since they # also encode and decode objects from disk to memory or the reverse, a bigger # number of threads can help with big objects even if they can't help with # I/O itself as the physical device may not be able to couple with many # reads/writes operations at the same time. # # The special value of 0 turn off threaded I/O and enables the blocking # Virtual Memory implementation. vm-max-threads 4 ############################### ADVANCED CONFIG ############################### # 當hash中包含超過指定元素個數並且最大的元素沒有超過臨界時, # hash將以一種特殊的編碼方式(大大減少記憶體使用)來存儲,這裡可以設置這兩個臨界值 # Redis Hash對應Value內部實際就是一個HashMap,實際這裡會有2種不同實現, # 這個Hash的成員比較少時Redis為了節省記憶體會採用類似一維數組的方式來緊湊存儲,而不會採用真正的HashMap結構,對應的value redisObject的encoding為zipmap, # 當成員數量增大時會自動轉成真正的HashMap,此時encoding為ht。 hash-max-zipmap-entries 512 hash-max-zipmap-value 64 # list數據類型多少節點以下會採用去指針的緊湊存儲格式。 # list數據類型節點值大小小於多少位元組會採用緊湊存儲格式。 list-max-ziplist-entries 512 list-max-ziplist-value 64 # set數據類型內部數據如果全部是數值型,且包含多少節點以下會採用緊湊格式存儲。 set-max-intset-entries 512 # zsort數據類型多少節點以下會採用去指針的緊湊存儲格式。 # zsort數據類型節點值大小小於多少位元組會採用緊湊存儲格式。 zset-max-ziplist-entries 128 zset-max-ziplist-value 64 # Redis將在每100毫秒時使用1毫秒的CPU時間來對redis的hash表進行重新hash,可以降低記憶體的使用 # # 當你的使用場景中,有非常嚴格的實時性需要,不能夠接受Redis時不時的對請求有2毫秒的延遲的話,把這項配置為no。 # # 如果沒有這麼嚴格的實時性要求,可以設置為yes,以便能夠儘可能快的釋放記憶體 activerehashing yes ################################## INCLUDES ################################### # 指定包含其它的配置文件,可以在同一主機上多個Redis實例之間使用同一份配置文件,而同時各個實例又擁有自己的特定配置文件 # include /path/to/local.conf # include /path/to/other.confredis.conf詳解--補充--

啟動slave從節點的redis服務

[root@master 10.0.0.5 ~]$redis-server /etc/redis-6380.conf [root@master 10.0.0.5 ~]$redis-server /etc/redis-6381.conf

驗證從節點的redis服務

[root@master ~]$redis-cli -p 6380 ping PONG [root@master ~]$redis-cli -p 6381 ping PONG

確定主從關係

在主節點上查看主從通信關係

[root@master ~]# redis-cli -p 6379 info replication

# Replication

role:master

connected_slaves:2

slave0:ip=127.0.0.1,port=6380,state=online,offset=407,lag=0

slave1:ip=127.0.0.1,port=6381,state=online,offset=407,lag=0

master_repl_offset:407

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:2

repl_backlog_histlen:406

在從節點上查看主從關係(6380、6379)

[root@slave 10.0.0.5 ~]$redis-cli -p 6380 info replication

# Replication

role:slave

master_host:127.0.0.1

master_port:6379

master_link_status:up

master_last_io_seconds_ago:3

master_sync_in_progress:0

slave_repl_offset:505

slave_priority:100

slave_read_only:1

connected_slaves:0

master_repl_offset:0

repl_backlog_active:0

repl_backlog_size:1048576

repl_backlog_first_byte_offset:0

repl_backlog_histlen:0

此時可以在master上寫入數據,在slave上查看數據,此時主從複製配置完成

開始配置Redis Sentinel

實驗的環境是單獨一臺linux,10.0.0.5

[root@master tmp]# ll /etc/redis-* -rw-r--r-- 1 root root 145 Nov 7 17:44 /etc/redis-6379.conf -rw-r--r-- 1 root root 93 Nov 7 17:42 /etc/redis-6380.conf -rw-r--r-- 1 root root 115 Nov 7 17:42 /etc/redis-6381.conf -rw-r--r-- 1 root root 556 Nov 7 17:42 /etc/redis-sentinel-26379.conf -rw-r--r-- 1 root root 556 Nov 7 17:42 /etc/redis-sentinel-26380.conf -rw-r--r-- 1 root root 556 Nov 7 17:42 /etc/redis-sentinel-26381.conf

redis-sentinel-26379.conf配置文件寫入如下信息

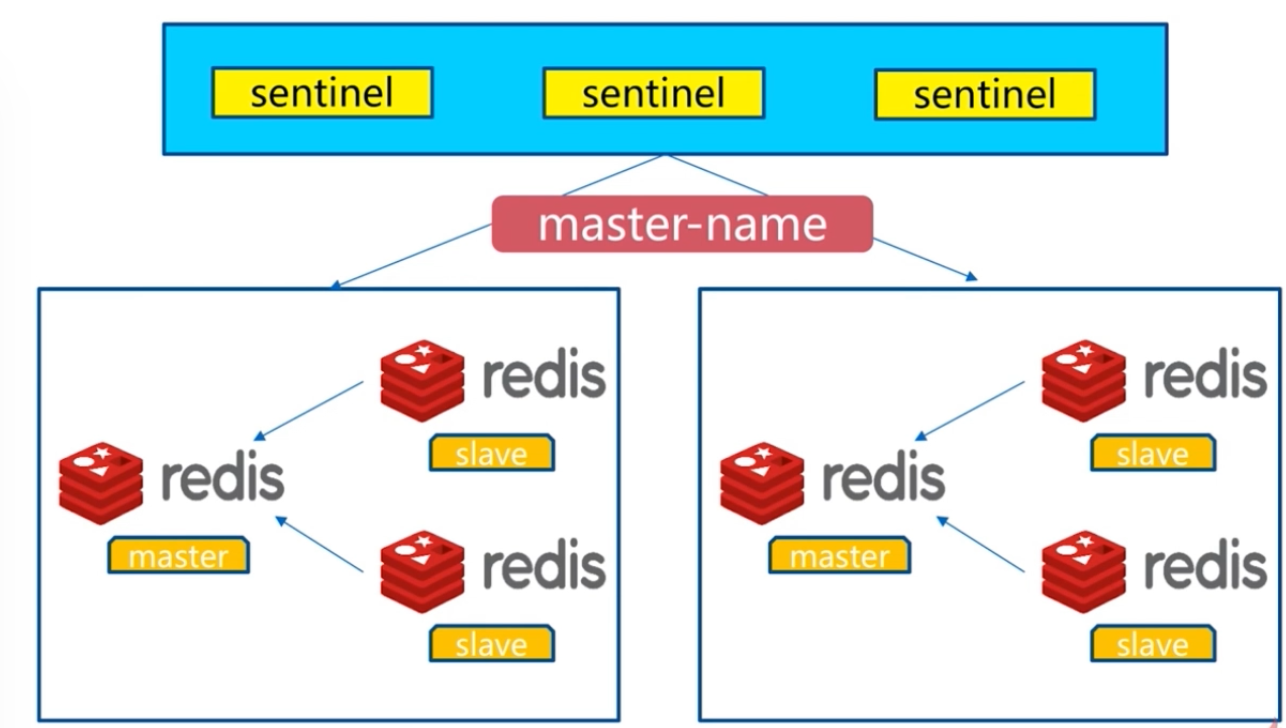

# Sentinel節點的埠 port 26379 dir /var/redis/data/ logfile "26379.log" # sentinel announce-ip 127.0.0.1 # 宣告哨兵IP, 此配置只有當使用非127.0.0.1的IP配置哨兵無法成功時加上,同時redis三個服務端也需要同步修改IP # 當前Sentinel節點監控 127.0.0.1:6379 這個主節點 # 2代表判斷主節點失敗至少需要2個Sentinel節點節點同意 # mymaster是主節點的別名 sentinel monitor mymaster 127.0.0.1 6379 2 # 每個Sentinel節點都要定期PING命令來判斷Redis數據節點和其餘Sentinel節點是否可達,如果超過30000毫秒30s且沒有回覆,則判定不可達 sentinel down-after-milliseconds mymaster 30000 # 當Sentinel節點集合對主節點故障判定達成一致時,Sentinel領導者節點會做故障轉移操作,選出新的主節點,原來的從節點會向新的主節點發起複制操作,限制每次向新的主節點發起複制操作的從節點個數為1 sentinel parallel-syncs mymaster 1 # 故障轉移超時時間為180000毫秒 sentinel failover-timeout mymaster 180000 daemonize yes

port 26379 dir /var/redis/data/ logfile "26379.log" sentinel monitor mymaster 127.0.0.1 6379 2 sentinel down-after-milliseconds mymaster 30000 sentinel parallel-syncs mymaster 1 sentinel failover-timeout mymaster 180000 daemonize yes簡潔配置

redis-sentinel-26380.conf和redis-sentinel-26381.conf的配置僅僅差異是port(埠)的不同。

然後啟動三個sentinel哨兵

redis-sentinel /etc/redis-sentinel-26379.conf redis-sentinel /etc/redis-sentinel-26380.conf redis-sentinel /etc/redis-sentinel-26381.conf

監控拓撲圖

此時查看哨兵是否成功通信

[root@master ~]# redis-cli -p 26379 info sentinel # Sentinel sentinel_masters:1 sentinel_tilt:0 sentinel_running_scripts:0 sentinel_scripts_queue_length:0 sentinel_simulate_failure_flags:0 master0:name=mymaster,status=ok,address=127.0.0.1:6379,slaves=2,sentinels=3 # 看到最後一條信息正確即成功了哨兵,哨兵主節點名字叫做mymaster,狀態ok,監控地址是127.0.0.1:6379,有兩個從節點,3個哨兵

如圖:

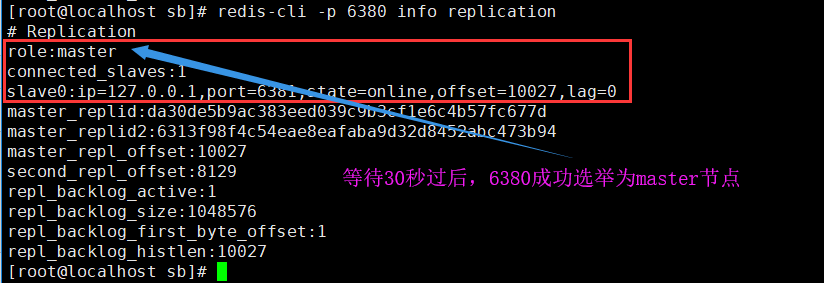

redis高可用故障實驗

大致思路

- 殺掉主節點的redis進程6379埠,觀察從節點是否會進行新的master選舉,進行切換

- 重新恢複舊的“master”節點,查看此時的redis身份

首先查看三個redis的進程狀態

ps -ef|grep redis

檢查三個節點的複製身份狀態

第一個

[root@master tmp]# redis-cli -p 6381 info replication # Replication role:slave master_host:127.0.0.1 master_port:6380

第二個

[root@master tmp]# redis-cli -p 6380 info replication # Replication role:master connected_slaves:2 slave0:ip=127.0.0.1,port=6381,state=online,offset=54386,lag=0 slave1:ip=127.0.0.1,port=6379,state=online,offset=54253,lag=0

第三個

[root@master tmp]# redis-cli -p 6379 info replication # Replication role:slave master_host:127.0.0.1 master_port:6380

此時,幹掉master!!!然後等待其他兩個節點是否能自動被哨兵sentienl,切換為master節點

ps -ef|grep 6380 #幹掉master進程

此時查看兩個slave的狀態

精髓就是查看一個參數

master_link_down_since_seconds:13

稍等片刻之後,發現slave節點成為master節點!!

[root@master tmp]# redis-cli -p 6379 info replication # Replication role:master connected_slaves:1 slave0:ip=127.0.0.1,port=6381,state=online,offset=41814,lag=1

大功告成!!開心!!!